Tesla se positionne au cœur d’une compétition intense entre les géants sud-coréens des semi-conducteurs, Samsung et SK Hynix. À la recherche de nouvelles puces HBM4, l’entreprise souhaite les intégrer dans son système Dojo, promettant ainsi d’améliorer ses capacités en matière d’intelligence artificielle et de conduite autonome.

Tesla se retrouve au cœur d’une lutte acharnée entre les géants sud-coréens des semi-conducteurs, Samsung et SK Hynix. Le constructeur de voitures électriques aurait contacté ces deux entreprises pour obtenir des exemplaires de leurs puces mémoire HBM4 de prochaine génération.

Tesla désire intégrer cette mémoire à large bande passante dans son système Dojo. Dojo est un supercalculateur conçu sur mesure pour entraîner les réseaux neuronaux liés à la fonctionnalité « Full Self-Driving » de l’entreprise. Selon des sources du secteur, Tesla pourrait déployer la mémoire améliorée non seulement dans Dojo, mais aussi dans ses centres de données et ses futurs véhicules autonomes.

Actuellement, le système Dojo utilise de vieilles puces HBM2e pour former les modèles IA complexes à la base des capacités de conduite autonome de Tesla. Toutefois, comme le souligne un rapport de TrendForce citant le Maeli Business Newspaper, l’entreprise souhaite tirer parti des gains de performance offerts par HBM4.

Pour ceux qui ne sont pas familiers avec le sujet, la mémoire à large bande passante comme HBM4 représente un type de RAM spécialisé conçu pour fournir un débit de données immense tout en fonctionnant avec une plus grande efficacité énergétique. Ces caractéristiques la rendent idéale pour la puissance de traitement nécessaire aux charges de travail IA de pointe.

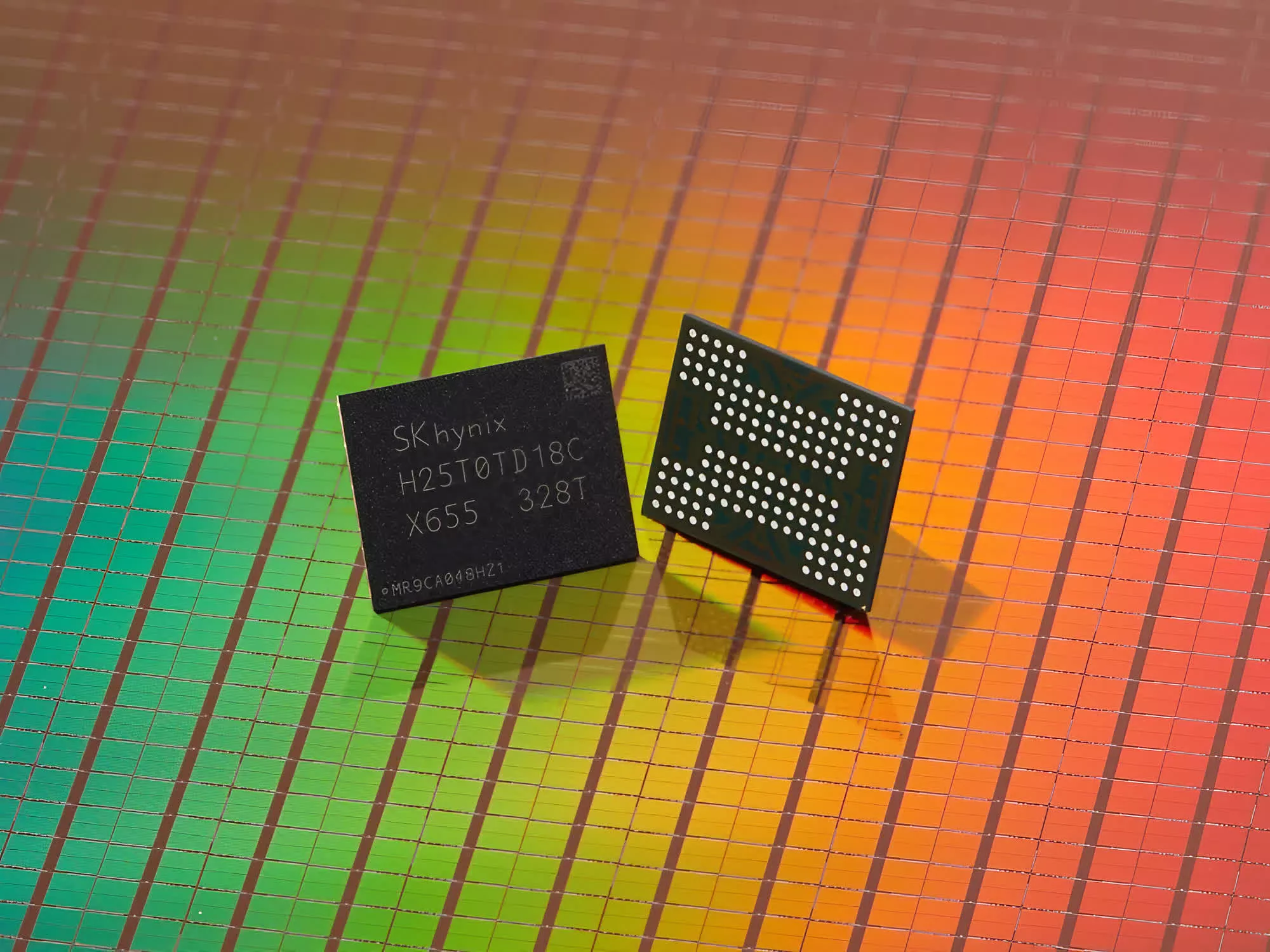

SK Hynix revendique que son chip offrira 1,4 fois la bande passante de la génération précédente HBM3e, tout en consommant 30 % d’énergie en moins. Si cela s’avère exact, cela indique une amélioration de la bande passante dépassant 1,65 To/s.

Une autre innovation attendue dans HBM4 est un die logique intégré agissant comme un contrôleur sous la pile de mémoire. Ce changement pourrait débloquer des optimisations supplémentaires en vitesse et en puissance, idéales pour le traitement des données IA.

SK Hynix et Samsung se trouvent dans une bataille féroce pour affirmer leur position sur le marché de HBM, qui devrait atteindre 33 milliards d’euros d’ici 2027. Les deux rivaux travaillent apparemment dur sur des prototypes HBM4 destinés à l’évaluation de Tesla et d’autres grands de la technologie américaine, y compris Microsoft, Meta et Google.

Actuellement, SK mène cette course en fournissant des puces à NVIDIA, et prévoit de démarrer la production d’HBM4 fin 2025. L’entreprise a également réussi à devancer en lançant d’abord sa mémoire flash NAND TLC à 321 couches. Cependant, Samsung semble déterminée à rattraper son retard en s’associant à TSMC pour produire des composants clés en s’appuyant sur son processus avancé de 4nm.