L’article annonce la sortie du modèle AI Stable Diffusion 3 Medium pour la génération d’images. Ce modèle, disponible en téléchargement, permet une génération d’images plus rapide et de meilleure qualité grâce à des optimisations pour les cartes graphiques NVIDIA et AMD. Il offre également une amélioration de la typographie et permet de générer des images basées sur des requêtes plus complexes.

Diffusion Stable 3 pour la génération d’images

Le dernier modèle open-weight disponible en téléchargement.

La Diffusion Stable est l’un des modèles open-weight d’IA pour la génération d’images. Contrairement à Midjourney ou DALL-E, qui sont disponibles via des API en ligne, ce modèle peut être téléchargé et exécuté localement en utilisant votre carte graphique. Une carte graphique plus performante avec une mémoire plus grande permet une génération d’image plus rapide et des sorties en haute résolution. Cependant, ce n’est pas toujours le cas, car les optimisations et l’accélération grâce aux bibliothèques d’apprentissage automatique avancées peuvent accélérer considérablement le processus.

En termes de stabilité, l’IA Stable Diffusion 3 Medium est l’un des modèles les plus avancés (et à ce stade le plus attendu) pour la génération de texte en image. Ce n’est ni le plus petit ni le plus grand modèle sur lequel travaille l’IA Stable, car il compte 2 milliards de paramètres (il est également prévu des versions de 800M et 8B), c’est pourquoi celui-ci est appelé Medium. Les utilisateurs peuvent désormais télécharger le modèle SD3 et l’utiliser à des fins non commerciales, tandis que ceux qui n’ont pas accès peuvent utiliser les outils en ligne de l’IA Stable.

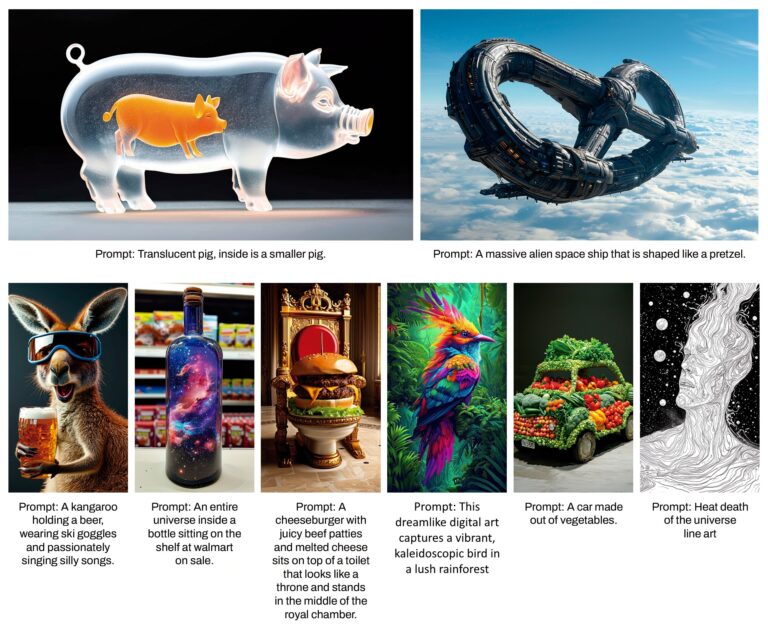

Exemples de Stable Diffusion 3, Source : IA Stable

Les points clés du nouveau modèle SD3 sont ses images de meilleure qualité grâce à un photoréalisme amélioré. Il a également la capacité de générer des images en fonction de prompts plus complexes et de comprendre les compositions d’éléments, les relations spatiales, les actions et les styles.

Une des fonctionnalités clés du nouveau modèle est l’amélioration de la typographie. Auparavant, il était facile de déterminer si une image avait été générée par une IA ou créée manuellement. Ce ne sera plus aussi simple, car il peut désormais générer du texte dans divers styles et la plupart du temps, il ne fera pas de fautes de frappe. Sur cet exemple, il fait moins de fautes que moi (généré avec StableSwarm et RTX 4090) :

Modèle Stable Diffusion 3, Source : OMGPU

L’IA Stable a travaillé avec NVIDIA et AMD pour permettre des optimisations spécifiques au hardware pour les deux constructeurs de GPU. Pour NVIDIA, cela inclut la possibilité d’utiliser TensorRT, ce qui entraîne une augmentation de 50% des performances. Cela fonctionne sur tous les GPU GeForce RTX. Cependant, veuillez noter qu’un modèle TensorRT spécial est requis, qui n’a pas encore été publié.

Pour AMD, l’IA Stable promet une inférence optimisée pour les APU AMD, les GPU et même le GPU de centre de données Instinct MI300X. Le hardware AMD n’a pas besoin de télécharger de modèles spéciaux.

Si vous souhaitez télécharger et utiliser les nouveaux modèles, consultez le guide disponible sur Reddit rédigé par le personnel de l’IA Stable.

Source : IA Stable, Hugging Face (Téléchargement du modèle)