La division HBM de Samsung pourrait connaître un changement radical, surtout après qu’AMD ait décidé d’adopter le processus HBM3E pour son dernier accélérateur dédié à l’IA, ouvrant ainsi la possibilité d’une validation par NVIDIA.

La voie prometteuse du HBM3E pour Samsung avec AMD

Les temps sont plutôt difficiles pour le géant coréen dans le secteur de l’IA, notamment en raison d’une sous-performance persistante de sa branche de fabrication. Bien que des perspectives aient émergé lorsque NVIDIA a manifesté un grand intérêt, les résultats des tests de qualification n’ont pas été à la hauteur des attentes, reléguant Samsung à une position moins favorable.

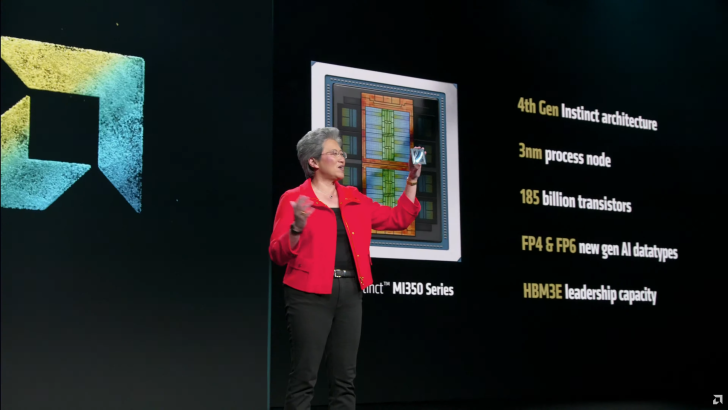

Cependant, un rapport de BusinessKorea suggère que l’espoir pourrait renaître après qu’AMD ait annoncé l’utilisation des empilements 12-Hi HBM3E de Samsung pour son nouvel accélérateur IA. Par ailleurs, la société prévoit également de collaborer avec AMD sur la gamme d’accélérateurs Instinct MI400, en utilisant son processus HBM4.

AMD a aussi révélé que ses derniers accélérateurs IA, les Instinct MI350X et MI355X, intégreront des solutions HBM3E issues de Samsung et Micron. Comme ces GPU dédiés à l’IA sont équipés de 288 Go de mémoire, il est probable qu’AMD ait utilisé les empilements 12-Hi de Samsung. De plus, AMD envisage d’élargir ses solutions vers des offres à échelle de rack, ce qui devrait augmenter la demande pour la mémoire HBM3E, profitant à Samsung sur le long terme.

Dans la seconde moitié de cette année, Samsung prévoit aussi d’accroître la production de HBM4. Avec AMD utilisant ce processus pour ses accélérateurs MI400, l’adoption devrait être encore plus accentuée. Samsung souhaite vraiment renverser la tendance en sa faveur avec HBM4, vu que des concurrents comme SK Hynix et Micron ont renforcé leur part de marché HBM grâce à leur collaboration avec NVIDIA. L’annonce d’AMD pourrait bien permettre à Samsung de regagner du terrain, surtout avec une solution HBM4 compétitive.