AMD franchit une nouvelle étape dans le domaine de l’intelligence artificielle, en facilitant l’accès à des modèles LLM volumineux pour les utilisateurs de PC grâce à une récente mise à jour des pilotes.

AMD Renforce les Capacités AI pour les Consommateurs

La société Team Red se positionne comme un acteur clé dans l’intégration de l’intelligence artificielle dans les machines grand public via ses moteurs XDNA. Les offres APU d’AMD, notamment les gammes Strix Point et Strix Halo, se distinguent par des performances AI élevées. Avec le dernier pilote Adrenalin Edition 25.8.1, AMD permet désormais l’utilisation de modèles comme le Llama 4 Scout de Meta, un exploit unique dans ce domaine.

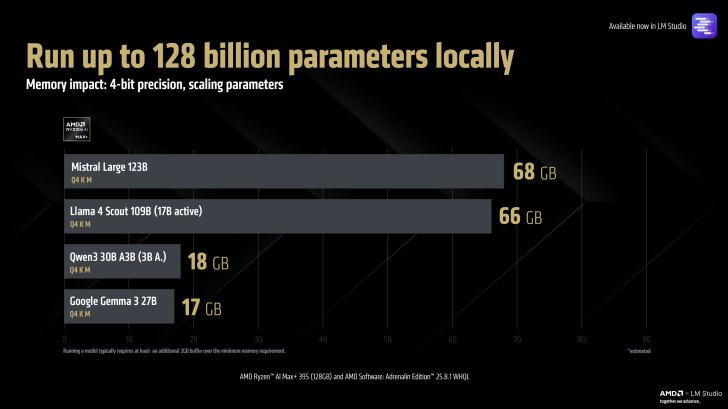

De manière intéressante, grâce à la mémoire graphique variable (VGM) d’AMD, les utilisateurs peuvent bénéficier de jusqu’à 96 Go de mémoire graphique pour l’iGPU, ce qui permet de faire fonctionner des modèles à grande échelle localement. Le modèle Llama, basé sur MoE, utilise 17 milliards de paramètres en fonctionnement, garantissant une performance décente pour être utilisé comme un assistant AI efficace.

Un point important est que AMD a considérablement élargi la taille du contexte des modèles. Alors que la norme dans l’industrie était généralement autour de 4096 tokens, la société a atteint une longueur de contexte impressionnante de 256 000 tokens. Cela offre un meilleur contrôle sur les flux de travail, sans compromis sur les performances.

Actuellement, la plateforme Strix Halo est disponible sur un nombre limité d’appareils, souvent à des prix dépassant les 1 800 €. Cependant, les avancées d’AMD en matière de calcul AI suscitent un optimisme fort. Bien que l’accès à cette puissance AI soit réalisable pour le grand public, il faut néanmoins prévoir un budget conséquent pour acquérir les dispositifs proposés.