OpenAI fait face à une pénurie de puissance de traitement, entraînant une lenteur des réponses de ChatGPT. La sortie de GPT-4.5 est restreinte aux abonnés Pro, alors que des milliers de GPUs seront installés pour améliorer la situation. Découvrez comment OpenAI compte sur des solutions innovantes pour répondre à cette demande croissante.

Si vous utilisez ChatGPT et que vous avez remarqué ses temps de réponse lents, OpenAI a confirmé que cela est dû à un manque de puissance de traitement. L’entreprise s’efforce d’installer des milliers de GPU d’ici la semaine prochaine, avec des centaines de milliers d’autres « à venir bientôt ». En attendant, cette pénurie a poussé l’entreprise à ralentir la sortie de GPT-4.5.

OpenAI vient de sortir GPT-4.5, mais les utilisateurs moyens n’y auront pas encore accès. Le modèle n’est disponible que sur le niveau Pro de l’entreprise, à 200€/mois. Le PDG d’OpenAI, Sam Altman, a expliqué que le plan était de lancer le modèle simultanément sur les abonnements Plus et Pro. Cependant, la pénurie de GPU a forcé l’entreprise à étaler son lancement.

GPT-4.5 is ready!

good news: it is the first model that feels like talking to a thoughtful person to me. I have had several moments where I’ve sat back in my chair and been astonished at getting actually good advice from an AI.

bad news: it is a giant, expensive model. we…

– Sam Altman (@sama) 27 février 2025

Ces dernières semaines, les utilisateurs de ChatGPT ont remarqué des temps de réponse lents du modèle GPT-4o. Altman a noté que la plateforme a connu une croissance importante et n’a pas la puissance de traitement supplémentaire nécessaire pour accueillir tous ses utilisateurs, rendant le lancement du « gros et coûteux » GPT-4.5 problématique.

Heureusement, OpenAI dispose déjà de « dizaines de milliers » de GPU disponibles que les techniciens installeront la semaine prochaine. Après cela, l’entreprise pourra finaliser le déploiement pour les utilisateurs Plus. De plus, l’entreprise a « des centaines de milliers » de GPU en commande, qu’Altman est sûr que cela ne satisfera pas entièrement la capacité.

« Des centaines de milliers [de GPU] arrivent bientôt, et je suis à peu près sûr que vous utiliserez chacun d’eux qui nous permettra d’en rassembler, » a déclaré le PDG. « Ce n’est pas ainsi que nous voulons fonctionner, mais il est difficile de prévoir parfaitement les pics de croissance qui entraînent des pénuries de GPU. »

Nous avons tous ressenti les effets de ces pénuries, et c’est l’une des raisons pour lesquelles OpenAI souhaite s’orienter vers le développement de puces. En juillet dernier, l’entreprise a rapporté avoir eu des discussions avec Broadcom concernant la conception de puces AI et la réduction de sa dépendance à NVIDIA. Les négociations ont dû être très productives puisque des sources internes disent qu’OpenAI est prêt à envoyer à TSMC un design de puce sur mesure pour validation dans les mois à venir. Si tout se passe bien, la production de masse commencera en 2026.

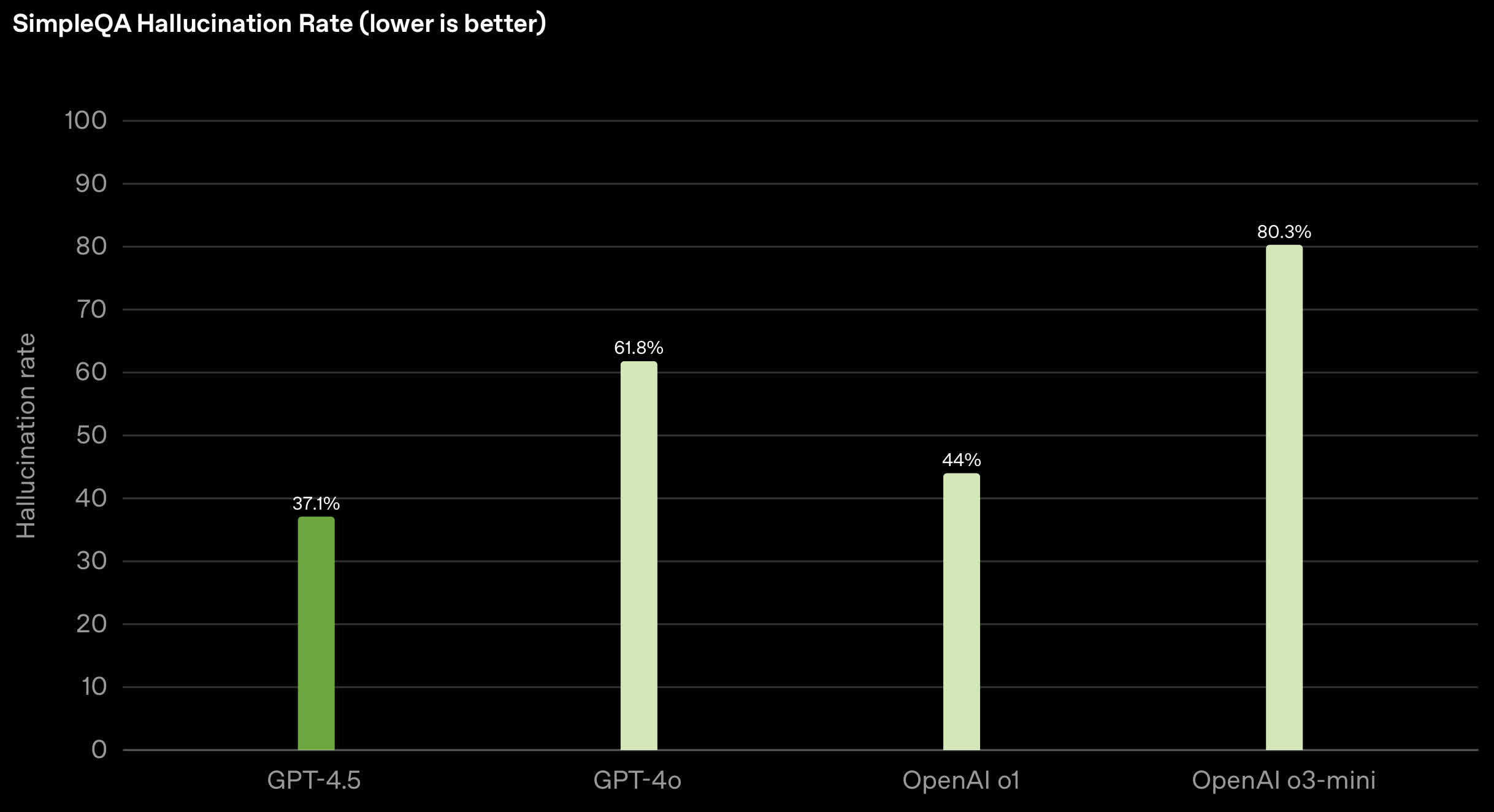

Concernant les performances de la dernière IA d’OpenAI, Altman a noté que GPT-4.5 n’est pas un modèle de raisonnement, donc les utilisateurs ne doivent pas s’attendre à ce qu’il dépasse les benchmarks. Cela évoqué, il y a une certaine forme de « magie » dans l’intelligence qui impressionne Altman.

« C’est le premier modèle qui me donne l’impression de parler à une personne réfléchie, » a vanté Altman. « J’ai eu plusieurs moments où je me suis assis en arrière dans ma chaise et j’ai été étonné d’obtenir de réels bons conseils d’une IA. »

À ce stade, je ne prendrais pas de conseils d’une IA, encore moins les payer. Cela évoqué, OpenAI commence à ajuster ses prix pour toucher le bon public. Son niveau Plus coûte 20€/mois, ce qui n’est pas cher, mais qui manque de l’accès illimité du version Pro à 200€/mois. Le niveau gratuit a un accès illimité à GPT-4o mini, ce qui est suffisant pour la plupart des utilisateurs moyens. Si OpenAI pouvait réduire le prix des abonnements Plus à 15€ ou moins, cela attirerait davantage le public occasionnel.