NVIDIA, à travers les déclarations de son PDG, dévoile sa transformation en fournisseur d’infrastructures d’IA. L’entreprise élargit son rôle traditionnel de constructeur de puces pour s’impliquer dans le développement d’applications d’intelligence artificielle, annonçant des avancées significatives dans des technologies telles que les modèles de génération d’images et la gestion des processus d’inférence.

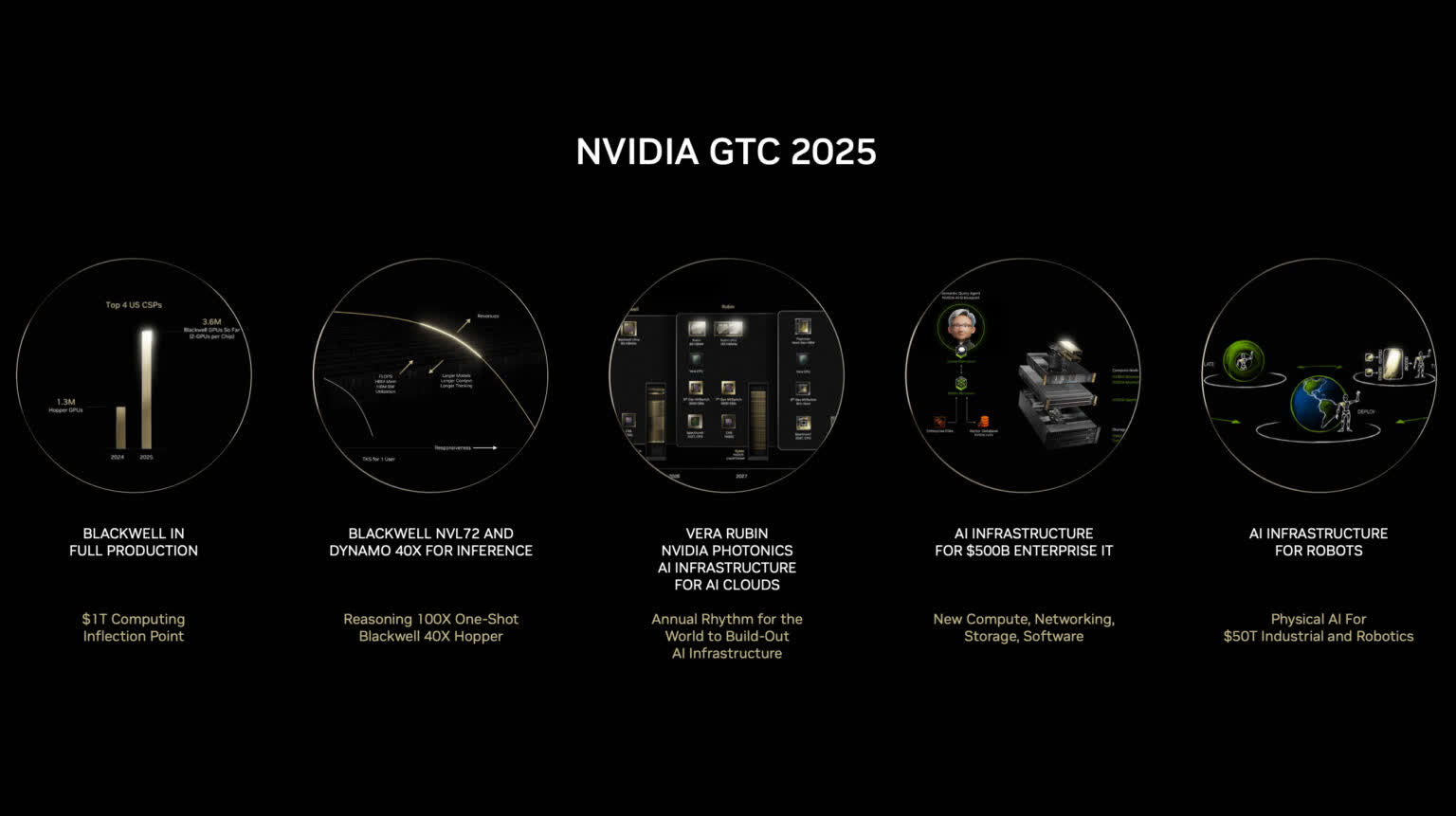

Un défi majeur dans l’analyse d’une entreprise en crise de croissance rapide comme NVIDIA réside dans la compréhension des divers domaines qu’elle couvre, des nombreux produits qu’elle annonce et de sa stratégie globale. Après le discours d’ouverture du PDG Jensen Huang lors de la conférence annuelle GTC de cette année, cette tâche s’est révélée particulièrement complexe. Comme à son habitude, Huang a abordé une vaste gamme de sujets lors de sa longue présentation, laissant franchement plus d’une personne dans l’incompréhension.

Cependant, lors d’une session de questions-réponses instructive avec des analystes du secteur quelques jours plus tard, Huang a partagé plusieurs informations qui ont soudainement clarifié toutes les diverses annonces de produits et de partenariats qu’il avait évoquées, ainsi que la réflexion qui les sous-tendait.

En substance, il a déclaré que NVIDIA est désormais un fournisseur d’infrastructures d’IA, construisant une plateforme de hardware et de logiciel que de grands fournisseurs de cloud, des vendeurs de technologie et des départements informatiques d’entreprises peuvent utiliser pour développer des applications équipées par l’intelligence artificielle.

Il va sans dire que c’est un écart considérable par rapport à son rôle en tant que fournisseur de puces graphiques pour le jeu sur PC, ou même de ses efforts pour aider à la création d’algorithmes d’apprentissage automatique. Pourtant, cela unifie plusieurs annonces apparemment disparates d’événements récents et fournit une indication claire de la direction que prend l’entreprise.

NVIDIA évolue au-delà de ses origines et de sa réputation en tant que société de conception de semi-conducteurs, prenant un rôle crucial d’enableur d’infrastructures pour le futur des capacités d’intelligence artificielle, ou, comme l’a décrit Huang, un « constructeur d’intelligence ».

Dans son discours principal au GTC, Huang a discuté des efforts de NVIDIA pour permettre la génération efficace de tokens pour les modèles de fondation modernes, reliant ces tokens à l’intelligence que les organisations exploiteront pour générer des revenus futurs. Il a décrit ces initiatives comme la construction d’une usine d’IA, pertinente pour une vaste gamme d’industries.

Bien que cela soit ambitieux, les signes d’une économie axée sur l’information émergent, et les efficacités que l’IA apporte à la fabrication traditionnelle deviennent de plus en plus évidentes. Des entreprises entièrement bâties autour de services d’IA (comme ChatGPT) à la fabrication robotique et à la distribution de biens traditionnels, nous entrons sans aucun doute dans une nouvelle ère économique.

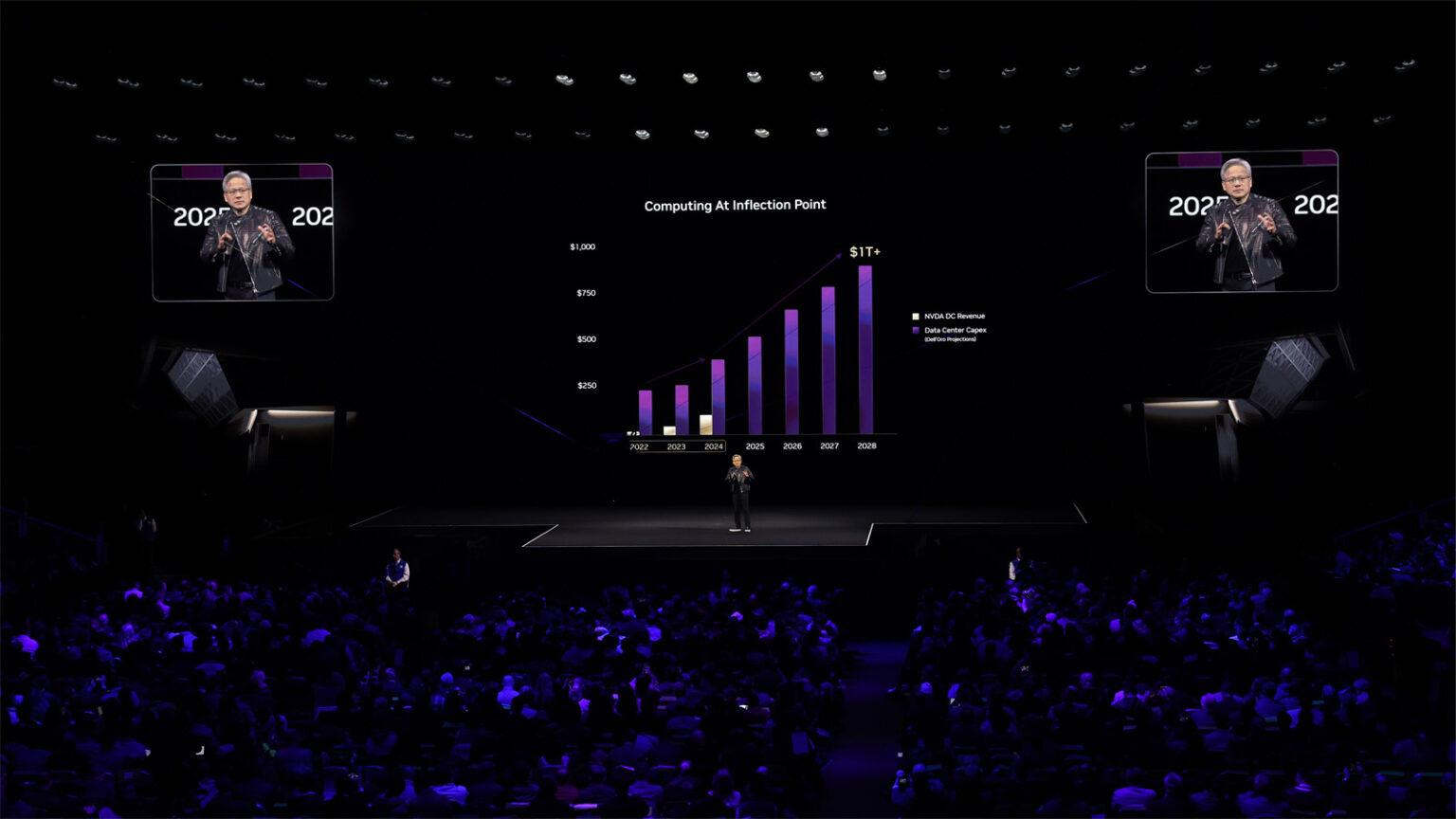

Dans ce contexte, Huang a largement décrit comment les dernières offres de NVIDIA facilitent une création de tokens plus rapide et plus efficace. Il a d’abord abordé l’inférence IA, généralement considérée comme plus simple que les processus d’entraînement IA qui ont initialement propulsé NVIDIA au devant de la scène. Cependant, Huang a soutenu que l’inférence, notamment lorsqu’elle est utilisée avec de nouveaux modèles de raisonnement séquentiel tels que DeepSeek R1 et o1 d’OpenAI, nécessitera environ 100 fois plus de ressources informatiques que les méthodes d’inférence basiques actuelles. Il y a donc peu de risque que des modèles linguistiques plus efficaces réduisent la demande d’infrastructure informatique. En effet, nous sommes encore aux débuts du développement d’une infrastructure d’usine d’IA.

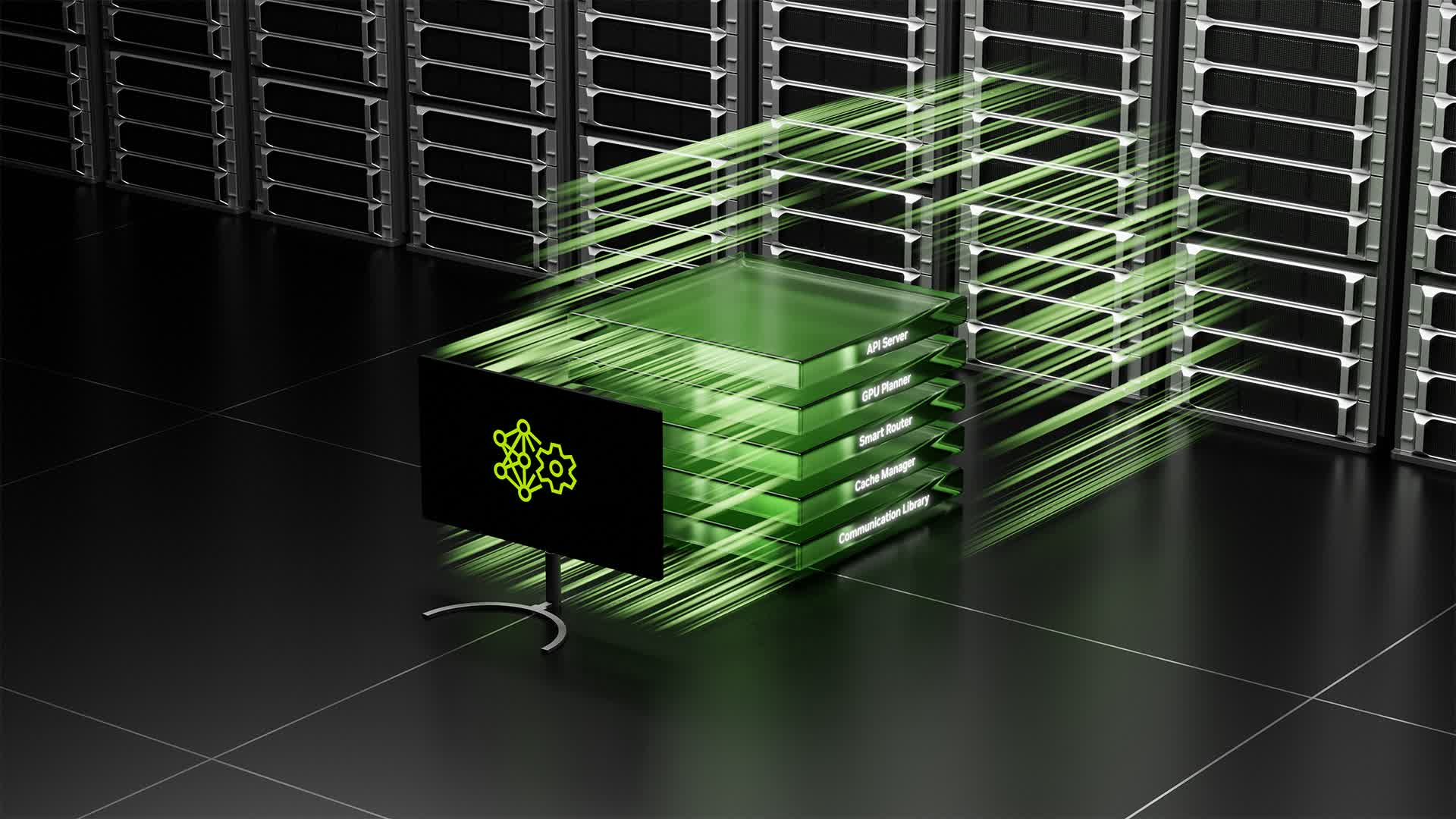

L’une des annonces les plus importantes mais les moins comprises de Huang était un nouvel outil logiciel appelé NVIDIA Dynamo, conçu pour améliorer le processus d’inférence pour des modèles avancés. Dynamo, une version améliorée du logiciel Triton Inference Server de NVIDIA, alloue dynamiquement des ressources GPU pour différentes étapes d’inférence, telles que le pré-remplissage et le décodage, chacune ayant des besoins de calcul distincts. Il crée également des caches d’informations dynamiques, gérant les données efficacement à travers différents types de mémoire.

Fonctionnant de manière similaire à l’orchestration des conteneurs Docker dans le cloud computing, Dynamo gère intelligemment les ressources et les données nécessaires à la génération de tokens dans des environnements d’usines d’IA. NVIDIA a qualifié Dynamo « d’OS des usines d’IA ». Concrètement, Dynamo permet aux organisations de gérer jusqu’à 30 fois plus de requêtes d’inférence avec les mêmes ressources matérielles.

Bien sûr, ce ne serait pas un GTC si NVIDIA n’avait pas également annoncé de nouveaux chips et matériels, et il y en avait beaucoup cette fois-ci. Huang a présenté une roadmap pour les futurs GPU, y compris une mise à jour de la série Blackwell actuelle appelée Blackwell Ultra (série GB300), offrant de la mémoire HBM embarquée améliorée pour des performances accrues.

Il a également dévoilé la nouvelle architecture Vera Rubin, présentant un nouveau CPU basé sur Arm appelé Vera et un GPU de nouvelle génération nommé Rubin, chacun intégrant significativement plus de cœurs et de capacités avancées. Huang a même fait allusion à la génération suivante, nommée après le mathématicien Richard Feynman, projetant la roadmap de NVIDIA jusqu’en 2028 et au-delà.

Lors de la séance de questions-réponses qui a suivi, Huang a expliqué que dévoiler les futurs produits bien à l’avance est crucial pour les partenaires constructeurs de l’écosystème, leur permettant de se préparer adéquatement aux changements technologiques à venir.

Huang a également souligné plusieurs partenariats annoncés lors de ce GTC. La présence significative d’autres vendeurs technologiques a démontré leur volonté de participer à cet écosystème en pleine expansion. Du côté du calcul, Huang a expliqué que pour maximiser pleinement l’infrastructure d’IA, des avancées dans toutes les zones de la pile informatique traditionnelle, y compris le réseau et le stockage, sont nécessaires.

À cette fin, NVIDIA a dévoilé une nouvelle technologie de photonique silicium pour le réseau optique entre les racks de serveurs accélérés par GPU et a discuté d’un partenariat avec Cisco. Le partenariat avec Cisco permet l’intégration de silicium Cisco dans les routeurs et commutateurs conçus pour intégrer des usines d’IA accélérées par GPU dans des environnements d’entreprise, ainsi qu’un niveau de gestion logicielle partagé.

Pour le stockage, NVIDIA a collaboré avec des fournisseurs de hardware de premier plan et des entreprises de plateformes de données, s’assurant que leurs solutions pouvaient tirer parti de l’accélération GPU, élargissant ainsi l’influence de NVIDIA sur le marché.

Enfin, en s’appuyant sur une stratégie de diversification, Huang a introduit de nouveaux travaux que l’entreprise effectue pour les véhicules autonomes (notamment un accord avec GM) et la robotique, qu’il a décrits comme faisant partie de la prochaine grande étape du développement de l’IA : l’IA physique.

NVIDIA fournit des composants aux constructeurs automobiles depuis de nombreuses années et, de manière similaire, a proposé des plateformes robotiques depuis plusieurs années également. Ce qui est différent maintenant, cependant, c’est qu’ils sont reliés à une infrastructure d’IA qui peut être utilisée pour mieux entraîner les modèles qui seront déployés dans ces appareils, ainsi que pour fournir les données d’inférence en temps réel nécessaires à leur fonctionnement dans le monde réel. Bien que ce retour à l’infrastructure soit sans doute un progrès relativement modeste, dans le contexte plus large de la stratégie d’infrastructure d’IA de l’entreprise, cela a plus de sens et contribue à rassembler de nombreuses initiatives de l’entreprise en un tout cohérent.

Comprendre tous les différents éléments que Huang et NVIDIA ont dévoilés lors de ce GTC cette année n’est pas simple, notamment en raison de la nature torrentielle de toutes les annonces différentes et de l’ambition nettement plus large de l’entreprise. Une fois que les pièces s’assembleront, cependant, la stratégie de NVIDIA devient claire : l’entreprise assume un rôle bien plus important que jamais et est bien positionnée pour atteindre ses objectifs ambitieux.

À la fin de la journée, NVIDIA sait qu’être un fournisseur d’infrastructures et d’écosystèmes leur permet de bénéficier à la fois directement et indirectement alors que le courant global de l’informatique IA s’élève, même si leur concurrence directe est vouée à augmenter. C’est une stratégie astucieuse et qui pourrait mener à une croissance encore plus grande à l’avenir.