NVIDIA s’apprête à proposer des prix compétitifs pour ses puces AI H200, selon un communiqué récent. Celui-ci indique que les nouveautés destinées à la Chine connaîtront une légère augmentation par rapport aux H20 actuelles.

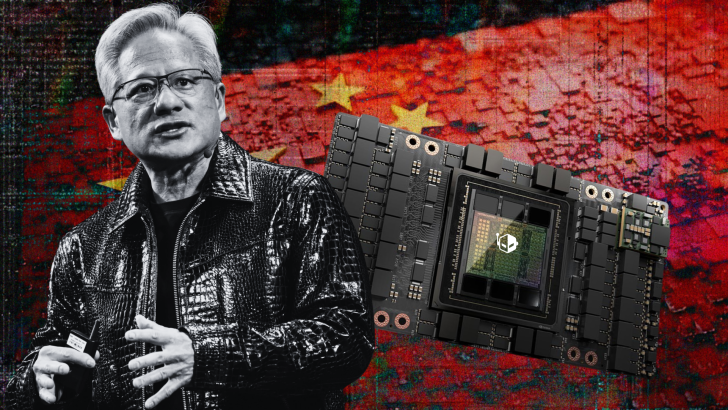

NVIDIA et son offensive tarifaire pour les H200 en Chine

Suite à la levée des restrictions par l’administration Trump concernant l’exportation des H200 vers la Chine, des incertitudes planaient sur l’intérêt de Pékin pour ces nouveaux modèles, dans le cadre de son projet de technologie domestique. De plus, l’introduction de la gamme Hopper a suscité des doutes sur la demande. D’après l’analyste Jukan, NVIDIA aurait un plan pour combler ce vide grâce à une tarification extrêmement attractive.

China-bound H200: China supply essentially confirmed, yet only ~1.3x pricier than the H20…

According to Chinese media reports, NVIDIA’s H200 sales to China are said to be virtually confirmed.

Also, NVIDIA CEO Jensen Huang (黄仁勋) is reportedly scheduled to visit China in… pic.twitter.com/OtMWhbSKQY

— Jukan (@jukan05) Décembre 24, 2025

Les médias chinois estiment le prix d’un cluster de 8 puces H200 autour de 200 000 €, comparable aux configurations H20. Le H200, avec des caractéristiques nettement améliorées, pourrait offrir une performance estimée à plus de six fois celle de son prédécesseur. Voici un aperçu des comparaisons entre H200 et H20 en termes techniques :

| Catégorie | NVIDIA H20 | NVIDIA H200 | Amélioration Estimée (H200 → H20) |

|---|---|---|---|

| Architecture | Hopper (version export-limitée) | Hopper | — |

| Process Node | TSMC 4N | TSMC 4N | — |

| Type de HBM | HBM3 | HBM3E | — |

| Capacité HBM | ~96 Go | 141 Go | ≈ +47% de capacité |

| Largeur de bande HBM | ~4.0 To/s | 4.8 To/s | ≈ +20% de bande passante |

| Cas d’usage prévu | Axé sur l’inférence (formation restreinte) | Formation complète + inférence + HPC | Amélioration fonctionnelle |

| Pouvoir de calcul (FP8 / FP16) | Significativement réduit vs H100 (conforme à l’export) | Ssemblable à la classe H100, capacité complète de Hopper | Augmentation substantielle |

| Formats PCIe / SXM | Versions PCIe uniquement (typiquement) | PCIe + SXM | — |

| Support NVLink | Restreint / limité | NVLink complet | Amélioration majeure au niveau système |

| Déploiement typique | Inferences LLM conformes à la Chine | Formation et inférence à l’échelle mondiale | — |

Des sources rapportent que la première livraison des H200 en Chine pourrait se faire d’ici mi-février, sous réserve d’approbation réglementaire. Plusieurs géants de l’AI, tels qu’Alibaba et Tencent, semblent prêts à investir jusqu’à 31 milliards € en infrastructure, axée sur du hardware conforme de NVIDIA et AMD. Cela remet en question l’idée que la Chine pourrait ne pas être intéressée par les H200.

Il est clair que la Chine a besoin de l’accès à du hardware de NVIDIA pour former des modèles d’IA avancés, ce qui pousse les fournisseurs de services cloud chinois à se ruer sur les H200 et MI308. Malgré les progrès de Huawei, celui-ci peine à rivaliser avec les alternatives occidentales, limité par des contraintes de capacité et un écosystème logiciel moins développé.