Pénurie de mémoire : pourquoi NVIDIA favorise les GPU les plus rentables, quitte à frustrer les joueurs

Des rumeurs circulent sur les choix stratégiques d’NVIDIA concernant ses GPU face aux pénuries de mémoire. Selon le PDG de Gigabyte, l’entreprise privilégiera la rentabilité dans ce contexte.

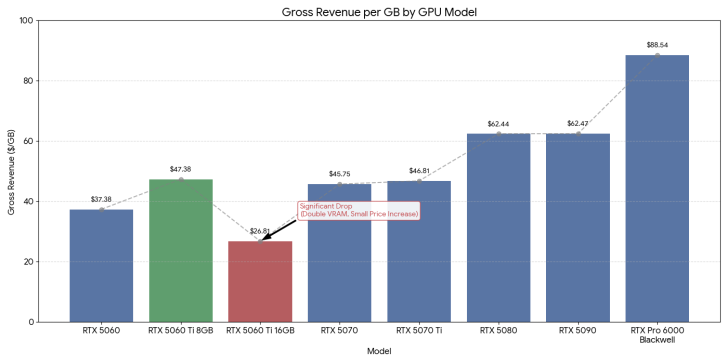

NVIDIA : Modèle de Rentabilité par Go Impacte la RTX 5060 Ti 16 Go

Les pénuries de DRAM touchent divers segments de la chaîne d’approvisionnement PC, rendant la situation des GPU de plus en plus délicate. Bien que des rumeurs aient suggéré l’abandon de la déclinaison GeForce RTX 5070 Ti 16 Go, NVIDIA a confirmé qu’elle resterait sur le marché. Eddie Lin, PDG de Gigabyte, a partagé comment NVIDIA pourrait ajuster sa stratégie pour maximiser ses profits à partir de son stock limité de DRAM.

« Ils ne peuvent pas se concentrer uniquement sur les produits haut de gamme ou bas de gamme… Par exemple, ils ont cinq segments. Ils se concentrent sur les segments 1, 3 et 5, et réduisent le pourcentage sur 2 et 4, car ceux-ci génèrent moins de revenus par Go de mémoire. »

Lin a pris l’exemple d’un GPU à 300 $ (environ 280 €) dont la mémoire rapporte 35 $ par Go (32 €), tandis qu’un modèle à 400 $ (environ 370 €) avec 8 Go rapporte 50 $ (48 €) par Go. En revanche, un modèle à 500 $ (environ 460 €) avec 16 Go ne rapporte que 32 $ (30 €), donc sa contribution est inférieure.

Cette analyse suggère que tous les modèles peu rentables pourraient être éliminés du portefeuille d’NVIDIA. Les modèles les plus rentables à l’heure actuelle sont ceux dotés de 8 Go, comme les RTX 5060 Ti et RTX 5060, ainsi que les modèles avec très haute VRAM, tels que la RTX 5090.

Cela permet de mieux comprendre les rumeurs concernant la reprise de la production de la RTX 3060 et l’augmentation du prix de la RTX 5090. NVIDIA pourrait également intégrer des modules de mémoire GDDR plus anciens, comme la GDDR5, moins sollicités par le secteur de l’IA, pour maintenir l’offre sur le segment grand public.

La direction future d’NVIDIA soulève des questions, sa stratégie pour les GPU consommateurs étant remise en question face à l’essor de l’IA.