NVIDIA présente les détails techniques de ses racks Blackwell GB200 & GB300 et engagements Open Compute

NVIDIA a récemment détaillé ses infrastructures Blackwell GB200 et GB300, mettant en avant leur architecture ouverte au sein de la plateforme MGX.

NVIDIA Partage Ses Développements pour les Systèmes Blackwell GB200 et GB300

L’année précédente, NVIDIA avait présenté ses premiers serveurs Blackwell fonctionnels. Cette année, l’entreprise introduit sa plateforme Blackwell Ultra. Durant l’événement Hot Chips 2025, une analyse technique des racks et trays Blackwell a été présentée par l’ingénieur mécanique John Norton.

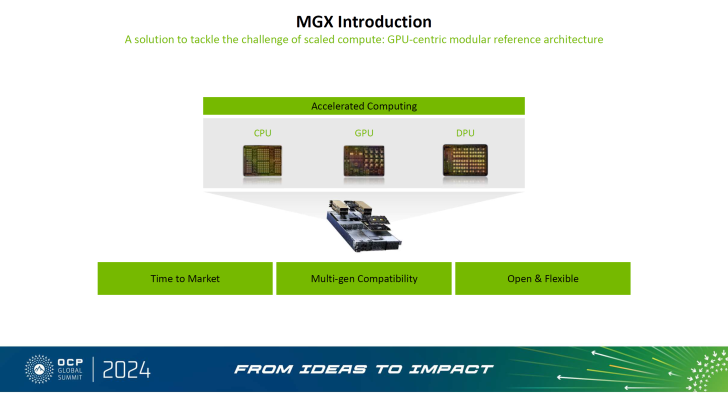

La conférence a débuté avec l’architecture MGX, introduite à l’OCP (Open Compute Project) l’année dernière. Les défis de conception des plateformes GB200 et GB300 ont également été abordés.

MGX a été conçu pour surmonter les obstacles liés à l’échelle des accélérateurs répartis à l’international. Les clients requéraient souvent des ajustements particuliers, qu’il s’agisse de gestion, de NIC, ou d’une combinaison spécifique de CPU et de GPU. Ces itérations constantes sur le système ont nécessité une approche réfléchie.

Pour cela, NVIDIA a développé MGX comme une architecture modulaire. En découpant le système en petits modules interopérables, il devient possible d’effectuer des ajustements spécifiques sans perturber l’ensemble du système. En contribuant à l’OCP, MGX est devenu accessible, permettant aux clients de personnaliser leurs besoins.

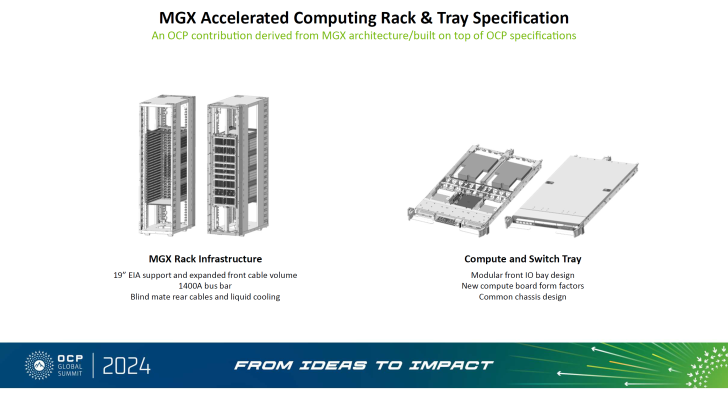

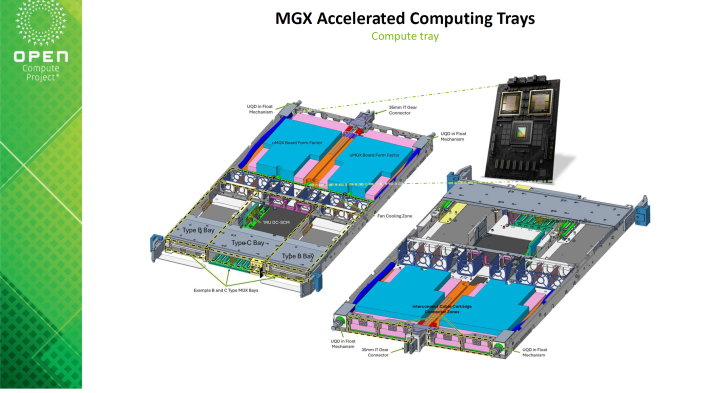

John s’est ensuite concentré sur l’infrastructure de rack MGX et les trays de calcul. NVIDIA s’appuie sur des standards ouverts pour sa conception, rendant toute la documentation technique disponible en ligne.

Les plateformes Blackwell GB200/GB300 ont été dévoilées avec des détails techniques. Le rack présente des switches en haut, suivis de l’alimentation qui convertit le courant AC à haute tension en courant DC pour le tableau DC à l’arrière.

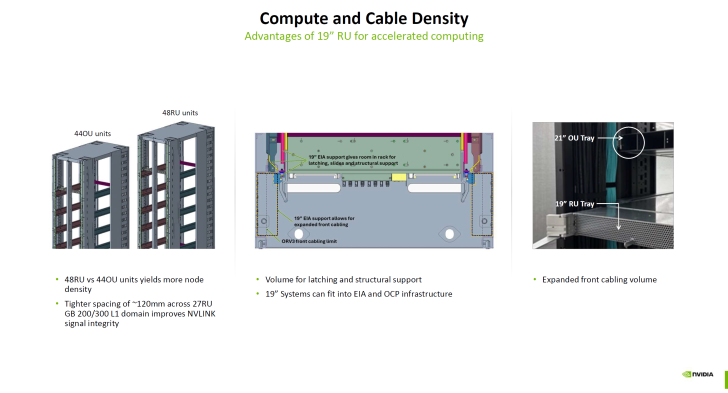

Directement sous l’alimentation se trouvent les trays de calcul. Le GB200 peut contenir jusqu’à 300 puces, réparties sur 10 trays de calcul. Avec des capacités de calcul de 80 FP4 Petaflops par tray, le système total atteint 1,4 exaflops.

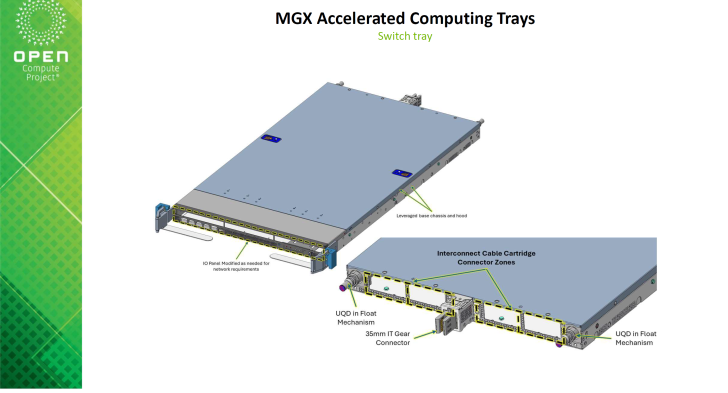

Le NVLink, qui fonctionne à 200 Gb/s par voie, relie les trays de GPU aux trays de commutation, favorisant ainsi une faible latence et une interconnexion cuivre efficace.

Les caractéristiques OCP déploient des appareils sur un pitch de 48 millimètres, permettant une densité accrue. NVIDIA a intégré ces caractéristiques pour optimiser l’espace des racks et ainsi bénéficier d’une meilleure efficacité.

Le bus bar, capable d’envoyer jusqu’à 35 kilowatts, a été considérablement renforcé pour supporter jusqu’à 1 400 amps, ce qui a nécessité l’expansion du cadre arrière du rack.

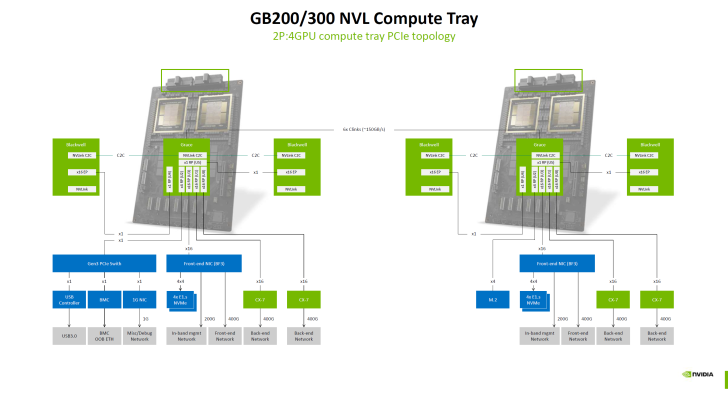

Chaque tray de calcul du GB200/300 contient deux CPU et quatre GPU, avec un module hôte intégré soutenant un CPU Grace et deux GPU Blackwell. La connectivité s’effectue via des connecteurs NVLink.

Le tray est conçu pour inclure un secteur de refroidissement modulable, permettant diverses configurations et options de gestion personnalisées.

Enfin, la connexion des unités se fait par un système de déconnexion rapide universel compatible avec les standards OCP. Cette approche totalement refroidie par liquide optimise les performances.

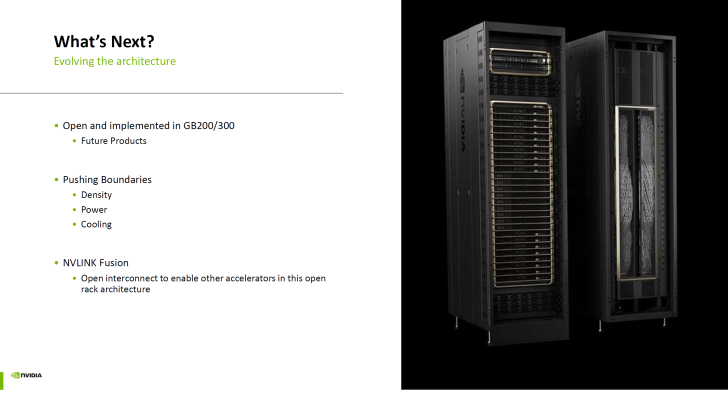

NVIDIA a confirmé que les GB200 et GB300 sont désormais en production à grande échelle, avec des déploiements prévus dans de nombreux centres de données hyperscale. L’entreprise continuera d’explorer l’amélioration de la densité et de l’efficacité énergétique dans ses futures itérations.