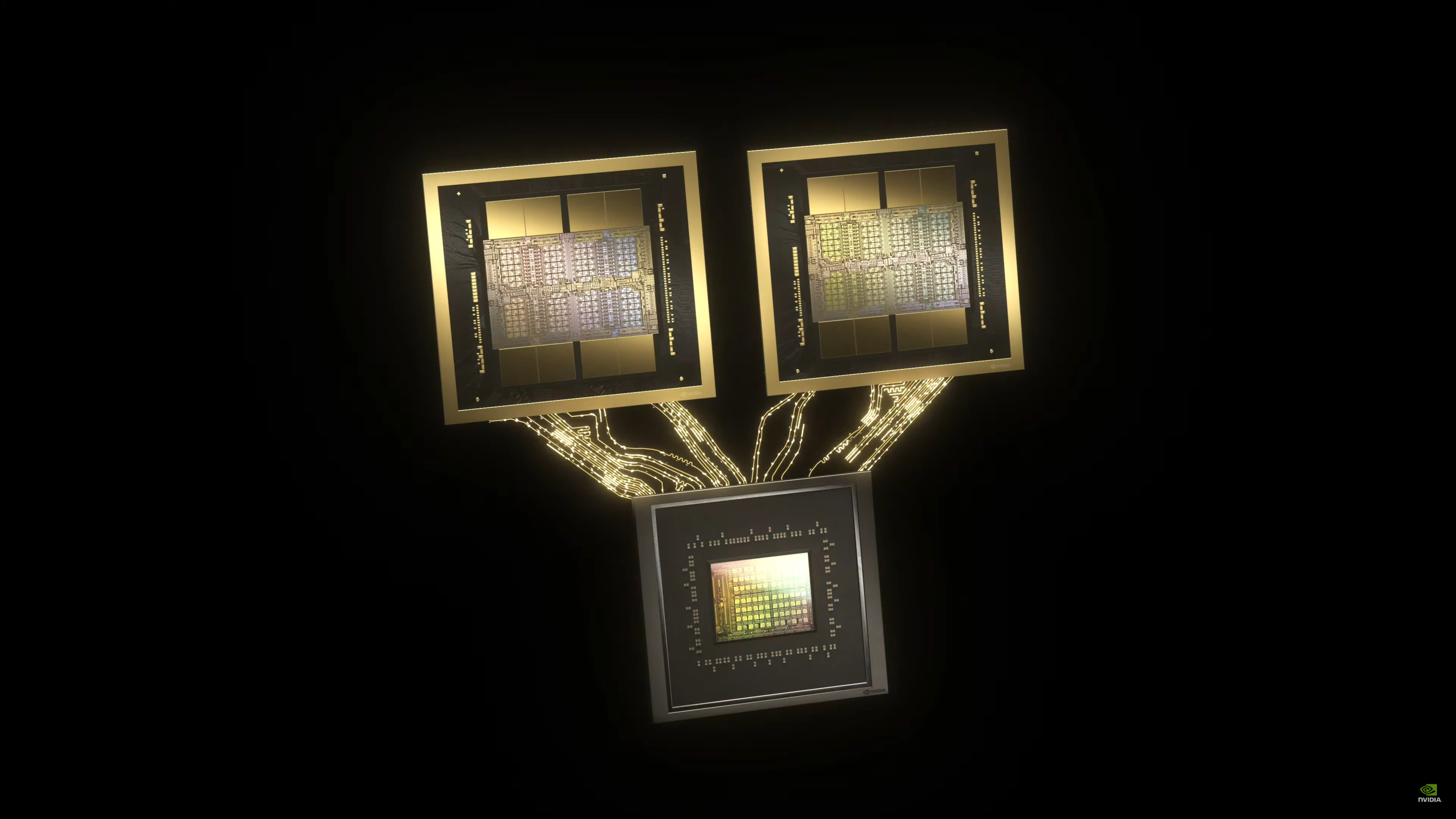

NVIDIA a récemment annoncé avoir franchi des frontières en matière de performance AI grâce à son architecture Blackwell, laquelle bénéficie d’une série d’optimisations et d’une puissance hardware accrue.

Optimisations de Blackwell pour les LLM à grande échelle : Rivalité accrue pour la vitesse de génération de tokens

Depuis un certain temps, l’entreprise fait des progrès dans le secteur AI, mais ses solutions basées sur Blackwell marquent un tournant. Dans une publication récente, NVIDIA a révélé avoir atteint 1 000 TPS avec un seul nœud DGX B200 équipé de huit GPU Blackwell. Ce résultat a été mesuré sur le modèle Llama 4 Maverick, comportant 400 milliards de paramètres, soulignant ainsi l’impact significatif de l’écosystème AI de NVIDIA.

Avec cette configuration, NVIDIA peut désormais atteindre jusqu’à 72 000 TPS dans un serveur Blackwell. Comme l’a mentionné Jensen lors de son discours au Computex, les entreprises afficheront leurs avancées en AI en montrant leur progression en matière de génération de tokens, un domaine où NVIDIA se concentre pleinement. Les optimisations logicielles, grâce à TensorRT-LLM et à un modèle de décodage spéculatif, ont permis d’atteindre une augmentation de performance de 4x.

Dans son article, NVIDIA a exploré plusieurs stratégies pour optimiser Blackwell pour les LLM à grande échelle. Une des techniques clés est le décodage spéculatif, où un modèle « draft » plus petit et rapide prédit plusieurs tokens, et le modèle principal les vérifie en parallèle. Voici comment l’entreprise le résume :

Le décodage spéculatif est une technique populaire pour accélérer la vitesse d’inférence des LLM, préservant la qualité du texte généré. Cela fonctionne en ayant un modèle « draft » plus rapide qui prédit une séquence de tokens, vérifiés ensuite par le LLM principal en parallèle.

Cette rapidité résulte de la génération de plusieurs tokens potentiels en une itération du modèle cible, bien que cela entraîne une surcharge pour le modèle draft.

– NVIDIA

NVIDIA a également exploité une architecture basée sur EAGLE3, conçue pour accélérer l’inférence des modèles de langage. L’entreprise affirme qu’avec ce succès, elle a consolidé sa position de leader dans le secteur AI, rendant Blackwell optimisé pour des LLM aussi volumineux que le Llama 4 Maverick. Cette avancée est un pas décisif vers une interaction AI plus fluide et rapide.