NVIDIA : correction des défauts de conception des puces IA Blackwell

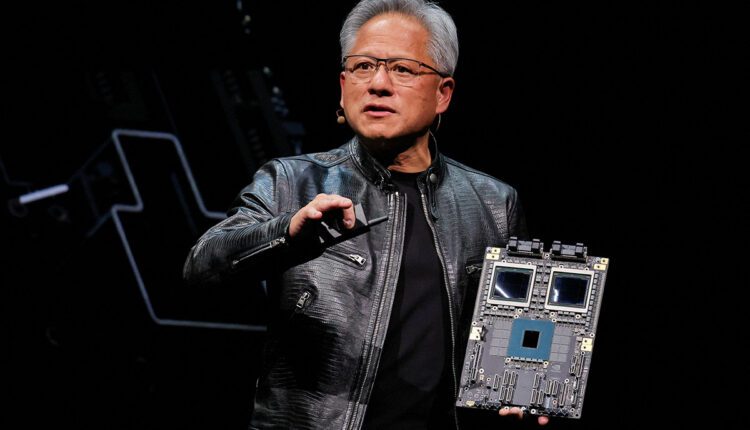

NVIDIA a récemment fait état de difficultés concernant ses conceptions de GPU Blackwell, ce qui a eu un impact sur la production. Le PDG de l’entreprise a annoncé que la marque collaborait avec TSMC pour corriger le problème rencontré. Selon Jensen Huang, les puces Blackwell AI devraient être expédiées d’ici la fin de l’année.

Les rumeurs au sujet des soucis d’architecture GPU chez NVIDIA se sont avérées fondées. La structure Blackwell, qui alimente ses dernières puces AI, semble avoir souffert d’une défaillance de conception entraînant des retards de production. Cela pourrait affecter le calendrier de clients majeurs tels que Meta, Microsoft, et Alphabet.

Jensen a indiqué : « Cela fonctionnait, mais la défaillance de conception a entraîné un faible rendement. C’était entièrement la faute de NVIDIA. » Il a ajouté que la réalisation d’un ordinateur Blackwell nécessitait la conception de sept types différents de puces, qui devaient être mises en production simultanément.

Collaboration avec TSMC

Heureusement, NVIDIA a réussi à identifier le problème et à le corriger grâce à l’assistance du constructeur de puces TSMC. En prenant l’entière responsabilité de cette erreur, le PDG a également précisé que les tensions supposées entre NVIDIA et TSMC étaient infondées.

Pour comprendre la complexité de cette tâche, le GPU B200 se compose d’un impressionnant 208 milliards de transistors, fabriqués à l’aide du nœud 4NP de TSMC. Pour y parvenir, NVIDIA a dû relier deux GPU de 104 milliards de transistors via un interconnect de 10 To/s. Cette approche rappelle la technologie Foveros d’Intel utilisée dans les processeurs Core Ultra 200.

Performances améliorées

NVIDIA met en avant des performances notables avec un entraînement des modèles quatre fois plus rapide, une inférence trente fois plus rapide, et une efficacité énergétique vingt-cinq fois supérieure par rapport à une puce H100. Pour rappel, l’inférence représente la rapidité avec laquelle un chatbot peut répondre à vos questions, par exemple.

Avec ces avancées, le B200 peut offrir des réponses plus rapides pour une expérience utilisateur fluide ou gérer plusieurs tâches simultanément à la vitesse d’une H100. Sans oublier la massive mémoire HBM3e de 192 Go, qui a connu un doublement par rapport à son prédécesseur pour permettre une formation AI plus complexe.

Avenir des GPU grand public

Il est important de préciser que ces développements ne devraient pas impacter les GPU destinés aux consommateurs, étant de taille bien plus réduite. Malgré tout, avoir un tel monstre technologique dans les PC serait un ajout intéressant, à condition de pouvoir se le permettre.