NVIDIA a récemment annoncé la version « Ultra » de son architecture Blackwell, offrant une amélioration spectaculaire en termes de capacité mémoire et de performance en intelligence artificielle pour les centres de données.

Blackwell Ultra : Capacité Mémoire Élargie et Performances Renforcées

La première génération de Blackwell a rencontré quelques obstacles, mais NVIDIA a réussi à améliorer l’approvisionnement de ce nouveau monstre de l’IA. Leurs GPU B100 et B200 proposent déjà des performances incroyables, mais avec Blackwell Ultra, l’entreprise vise à établir de nouveaux standards dans le secteur.

Les puces B300, qui en découlent, augmenteront non seulement la densité mémoire avec des empilements HBM3E jusqu’à 12 Hi, mais offriront également des capacités computationnelles accrues pour des traitements AI plus rapides, s’intégrant parfaitement aux derniers commutateurs Ethernet Spectrum Ultra X800.

Communiqué de presse : La nouvelle architecture Blackwell Ultra, introduite un an après le premier modèle, intègre les solutions rack-scale NVIDIA GB300 NVL72. Le GB300 NVL72 promet d’augmenter les performances IA de 1,5 fois par rapport à son prédécesseur GB200 NVL72, tout en permettant une expansion des opportunités de revenus pour les usines d’IA de 50 fois, comparées aux modèles basés sur Hopper.

Amélioration de la Raisonnement IA

Le GB300 NVL72 relie jusqu’à 72 GPU Blackwell Ultra et 36 CPU Arm Neoverse, formant une architecture scalable. Grâce à cette configuration, les modèles d’intelligence artificielle peuvent tirer parti d’une capacité de calcul accrue pour explorer divers scénarios et décomposer des demandes complexes, améliorant ainsi la qualité des réponses fournies.

De plus, le GB300 NVL72 sera disponible via NVIDIA DGX Cloud, offrant une solution AI complètement gérée sur des plateformes cloud, optimisant les performances avec des logiciels et des services adaptés à des charges de travail évolutives. Le système DGX SuperPOD avec les systèmes DGX GB300 utilise le design rack GB300 pour proposer une usine d’IA clé en main aux clients.

Le système NVIDIA HGX B300 NVL16 prévoya 11 fois plus d’inférences sur les grands modèles de langage, avec une capacité de calcul multipliée par 7 et une mémoire 4 fois plus importante que celle de la génération Hopper, offrant ainsi des performances exceptionnelles pour les charges de travail les plus complexes, telles que le raisonnement IA.

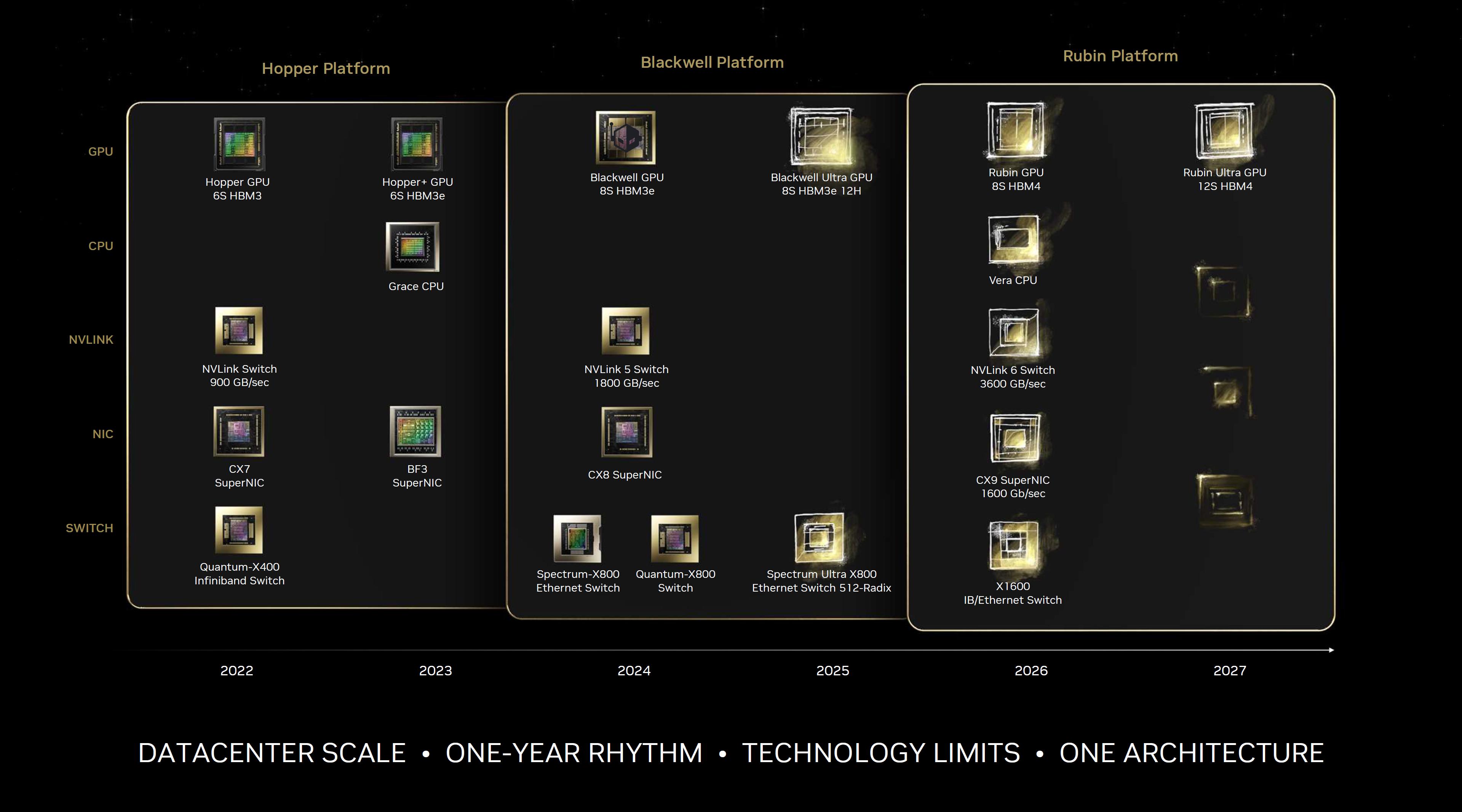

Feuille de Route GPU NVIDIA – Centres de Données / IA

| Nom de code GPU | Feynman | Rubin (Ultra) | Rubin | Blackwell (Ultra) | Blackwell | Hopper | Ampere | Volta | Pascal |

|---|---|---|---|---|---|---|---|---|---|

| Famille GPU | GF200? | GR300? | GR200? | GB300 | GB200/GB100 | GH200/GH100 | GA100 | GV100 | GP100 |

| SKU GPU | F200? | R300? | R200? | B300 | B100/B200 | H100/H200 | A100 | V100 | P100 |

| Mémoire | HBM4e/HBM5? | HBM4 | HBM4 | HBM3e | HBM3e | HBM2e/HBM3/HBM3e | HBM2e | HBM2 | HBM2 |

| Lancement | 2028 | 2027 | 2026 | 2025 | 2024 | 2022-2024 | 2020-2022 | 2018 | 2016 |