Les GPU Blackwell de NVIDIA sont en tête des performances en matière d’inférence AI, ce qui permet aux entreprises d’en tirer des marges bénéficiaires plus élevées par rapport à la concurrence.

Les optimisations logicielles de NVIDIA offrent des performances d’inférence exceptionnelles sur l’architecture GPU Blackwell, tandis qu’AMD doit encore progresser

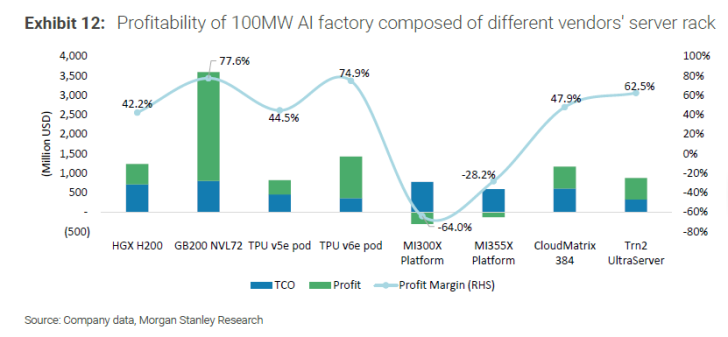

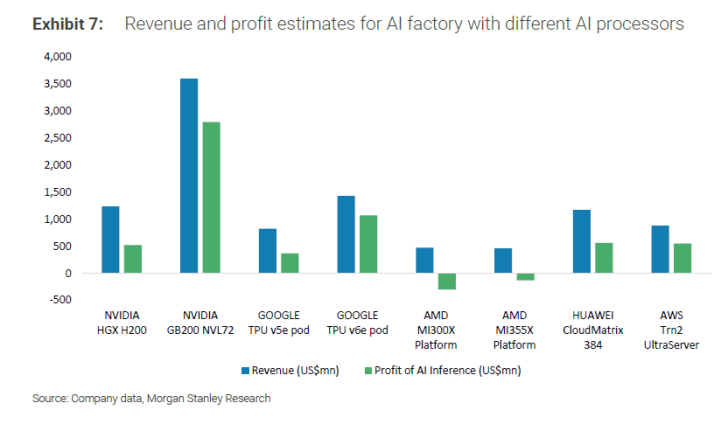

Des données récentes de Morgan Stanley Research comparent les coûts opérationnels et les marges bénéficiaires des solutions AI en matière d’inférence. Il s’avère que la plupart des « usines » d’inférence AI, utilisant plusieurs puces, affichent des marges supérieures à 50 %. NVIDIA domine ce secteur.

Pour l’évaluation, un exemplaire de 100MW d’usines AI a été analysé, intégrant des racks de serveurs de différents fournisseurs. Ces derniers incluent NVIDIA, Google, AMD, AWS, et Huawei. Parmi eux, la plateforme GPU Blackwell GB200 NVL72 de NVIDIA affiche la plus haute marge bénéficiaire de 77,6 %, représentant un profit d’environ 3,5 milliards d’euros.

Google se positionne en deuxième place avec sa puce TPU v6e, présentant une marge de 74,9 %, suivie par AWS avec un Trn2 Ultraserver à 62,5 %. D’autres solutions oscillent autour de 40 à 50 %, mais les chiffres d’AMD indiquent qu’il leur reste beaucoup à développer.

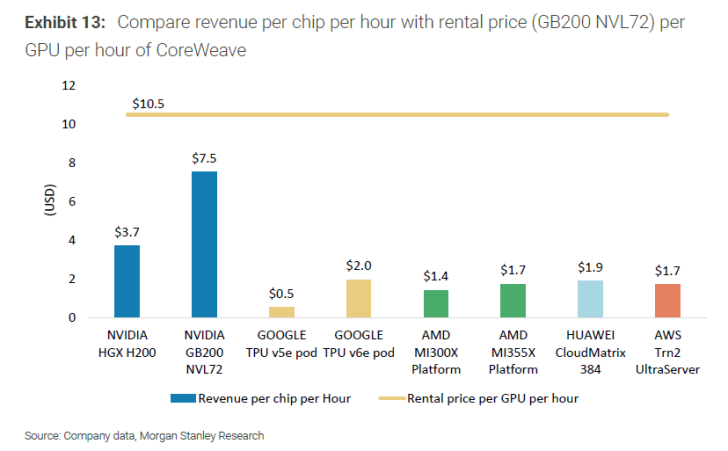

La plateforme MI355X d’AMD montre une marge bénéficiaire négative de 28,2 %, tandis que l’ancienne MI300X affiche -64 % en matière d’inférence AI. Les revenus par puce montrent que NVIDIA, avec son chip GB200, génère 7,5 € par heure, contre seulement 1,7 € pour AMD.

Les autres puces présentent des revenus horaires de 0,5 à 2,0 €, plaçant NVIDIA dans une catégorie à part. Ce leadership de NVIDIA est attribué à son support FP4 et aux optimisations continues de son architecture CUDA AI.

Bien qu’AMD propose du hardware de qualité avec ses plateformes MI300 et MI350, il reste des domaines à améliorer, notamment en inférence AI où la compétition est rude.

Selon Morgan Stanley, le coût total de possession (TCO) des plateformes MI300X peut atteindre 744 millions d’euros, équivalent à la plateforme GB200 de NVIDIA, évaluée à environ 800 millions d’euros. C’est un paramètre qui désavantage AMD.

Les serveurs MI355X ont un TCO estimé à 588 millions d’euros, semblable à celui du CloudMatrix 384 de Huawei. Le facteur coût pourrait expliquer la popularité de NVIDIA, qui, en matière d’inférence AI, capte 85 % du marché prévu pour les années à venir.

NVIDIA et AMD s’engagent également à maintenir une cadence annuelle pour rester compétitifs. NVIDIA lancera sa plateforme GPU Blackwell Ultra, offrant une hausse de 50 % par rapport à la GB200, suivie du modèle Rubin l’année prochaine. Pour sa part, AMD prévoie de dévoiler le MI400 pour rivaliser avec Rubin, tout en optimisant son MI400 pour l’inférence AI, promettant ainsi une année intéressante pour ce segment.