NVIDIA annonce l’acquisition de Groq pour étendre son architecture d’accélérateur en décode à faible latence

NVIDIA soulève des interrogations sur ses unités LPU de Groq. Lors d’un appel aux investisseurs pour le quatrième trimestre 2026, Jensen a relevé des éléments intéressants à leur sujet.

NVIDIA et Groq : Un partenariat stratégique pour les charges de travail sensibles à la latence

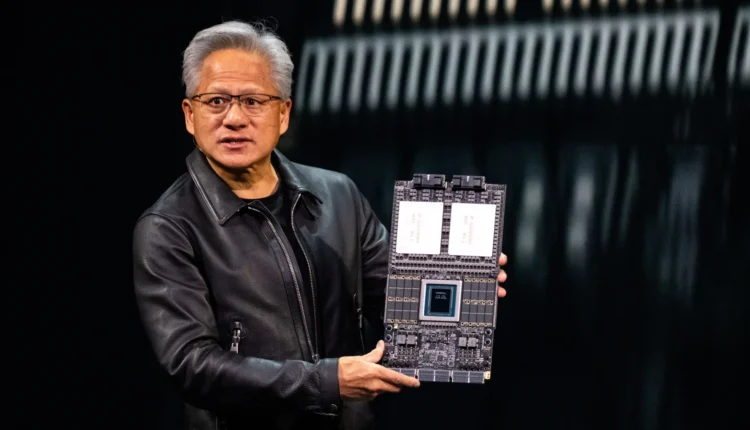

NVIDIA a multiplié les acquisitions cette année, dont celle de Groq, une collaboration non-locale atteignant 20 milliards € — le plus gros investissement de Team Green. Annoncée la veille de Noël, cette alliance reste à détailler. Jensen a mentionné l’avenir des LPU lors de l’appel, suggérant leur importance pour les futures offres AI d’NVIDIA.

Concernant ce vision de Groq et du décodeur à faible latence, j’ai de grandes idées que je partagerai lors de GTC.

Nous allons étendre ce architecture avec Groq en tant qu’accélérateur, similaire à l’intégration de Mellanox.

– Jensen Huang, PDG de NVIDIA

L’acquisition de Groq vise à répondre aux besoins des applications sensibles à la latence. Aujourd’hui, l’étape d’inférence devient prépondérante. Les environnements nécessitant des réponses instantanées voient la latence comme un frein majeur. Tandis qu’NVIDIA excelle dans l’apprentissage avec ses architectures Hopper et Blackwell, elles doivent renforcer leur position sur l’inférence, où les unités LPU de Groq joueront un rôle central.

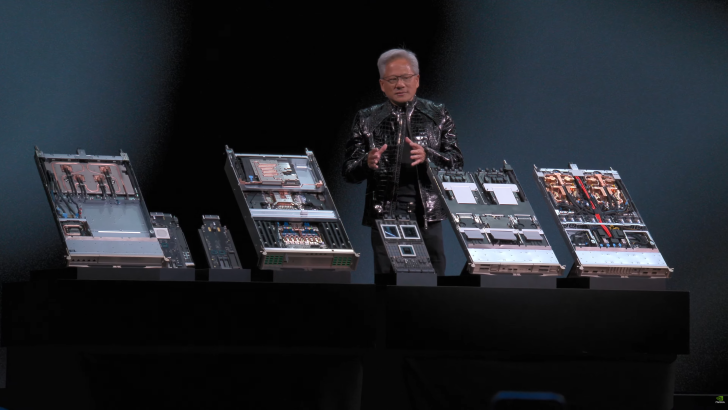

L’acquisition de Groq pourrait réduire l’écart similaire à celui de Mellanox, qui a résolu des problèmes de mise en réseau pour NVIDIA. Groq permettra une optimisation architecturelle, signalant une intégration rack-scale pour les LPU. Par conséquent, les impacts sur la stratégie des centres de données d’NVIDIA vont se renforcer avec cette initiative.

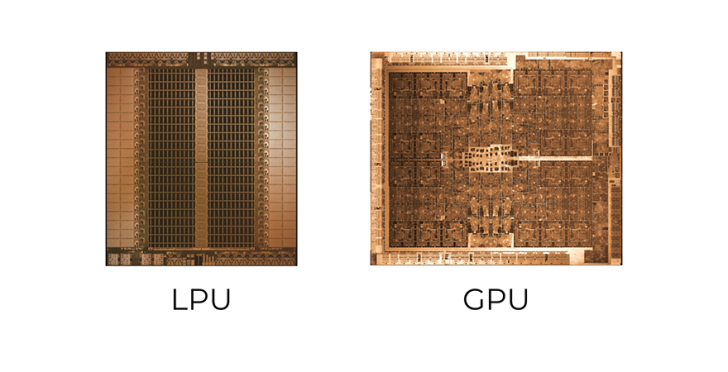

Les étapes de décodage et de pré-remplissage sont cruciales pour l’inférence. Pour NVIDIA, Groq apportera une capacité de décodage rapide, permettant aux agents d’effectuer des raisonnements complexes en quelques secondes. Le CPX Rubin couvre efficacement les étapes de pré-remplissage grâce à ses moteurs d’accélération d’attention et à la puissance massive du NVFP4.

Pour le décodage, les LPU utiliseront une SRAM sur-die, offrant des débits internes impressionnants. Des entreprises comme Cerebras et Microsoft adoptent également cette technologie. Selon les analystes, NVIDIA pourrait présenter un « rack LPX » avec 256 unités LPU à GTC, optimisant ainsi l’architecture pour des offres rack-scale innovantes.

Cette architecture hybride pourrait donner à NVIDIA un avantage décisif pour les charges de travail sensibles à la latence. Lors de l’appel aux investisseurs, Jensen a directement lié la croissance des revenus à l’évolution de la couche applicative de l’AI. Nous anticipons une présentation détaillée des progrès de NVIDIA sur les LPU lors du GTC de cette année.