Microsoft Azure s’upgrade avec les GPUs Blackwell Ultra de NVIDIA, 4600 pour des modèles IA à plus d’un trillion de paramètres

Microsoft a récemment dévoilé son premier cluster de production à grande échelle, équipé des GPU NVIDIA GB300 « Blackwell Ultra » conçus pour des modèles d’IA de grande taille.

NVIDIA GB300 « Blackwell Ultra » pour des modèles IA de plusieurs centaines de trillions de paramètres sur Azure

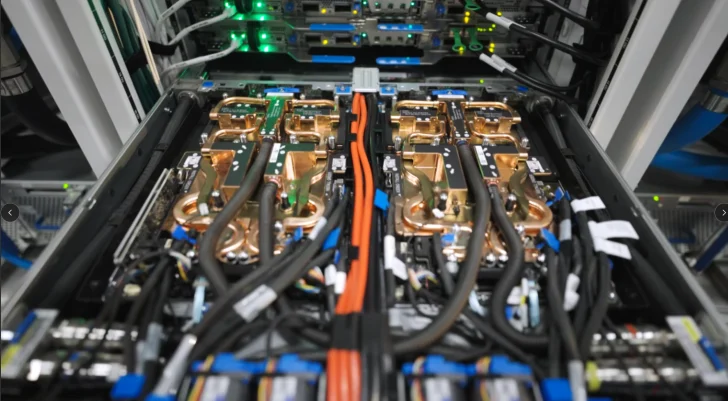

Azure de Microsoft a bénéficié d’une mise à jour avec les Blackwell Ultra. Ce nouveau cluster de production intègre plus de 4 600 GPU basés sur l’architecture NVIDIA GB300 NVL72, tous interconnectés grâce à la technologie InfiniBand de prochaine génération. Cette évolution permet à Microsoft de déployer des centaines de milliers de GPU Blackwell Ultra dans divers datacenters à travers le monde, tous centrés sur une seule tâche : l’IA.

The world’s first large-scale @nvidia GB300 NVL72 supercomputing cluster for AI workloads is now live on Microsoft Azure.

The deployment connects 4,600+ NVIDIA Blackwell Ultra GPUs using next-gen InfiniBand network—built to train and deploy advanced AI models faster than… pic.twitter.com/CmmDtcrlwn

— Microsoft Azure (@Azure) Octobre 9, 2025

Selon Microsoft, ce cluster permet de réduire les temps d’entraînement de plusieurs mois à quelques semaines, tout en offrant la possibilité de travailler sur des modèles dépassant les centaines de trillions de paramètres. Les performances d’inférence des GPU de NVIDIA demeurent inégalées, comme l’illustre les benchmarks MLPerf.

Les nouvelles machines virtuelles ND GB300 v6 d’Azure sont optimisées pour des modèles de raisonnement et des systèmes d’IA multimodaux. Chaque rack est constitué de 18 machines virtuelles, chacune équipée de 72 GPU. Voici les caractéristiques principales :

- 72 NVIDIA Blackwell Ultra GPU (avec 36 CPUs NVIDIA Grace).

- 800 gigabits par seconde (Gbp/s) à l’échelle inter-racks via InfiniBand NVIDIA Quantum-X800.

- 130 téraoctets par seconde de bande passante NVLink au sein d’un rack.

- 37 To de mémoire rapide.

- Jusqu’à 1 440 pétaflops de performance FP4 Tensor Core.

Au niveau des racks, la technologie NVLink réduit les contraintes de mémoire et de bande passante, permettant jusqu’à 130 To par seconde de transfert de données intra-rack. Cette architecture optimise le rendement d’inférence tout en réduisant les temps de latence, renforçant ainsi l’efficacité des systèmes d’IA façonnés pour répondre à des besoins toujours croissants.

Pour une échelle au-delà des racks, Azure déploie une architecture non-bloquante exhaustive via InfiniBand NVIDIA Quantum-X800, optimisant l’entraînement de modèles exceptionnels à des dizaines de milliers de GPU grâce à une communication réduite. Cela améliore l’efficacité globale de l’entraînement et permet aux chercheurs d’avancer plus rapidement et à moindre coût.

Partenariat avec NVIDIA, Azure représente un moment clé pour les États-Unis en matière d’IA. Les nouvelles machines virtuelles sont désormais prêtes à être utilisées par les clients.