Microsoft aurait développé des « Toolkits » pour réduire la dominance de CUDA d’NVIDIA avec des GPU AMD AI

Microsoft explore des moyens d’exploiter ses GPU AMD pour des charges de travail d’inférence, en développant des outils capables de convertir les modèles NVIDIA CUDA en code compatible avec ROCm.

Microsoft et la demande d’inférence

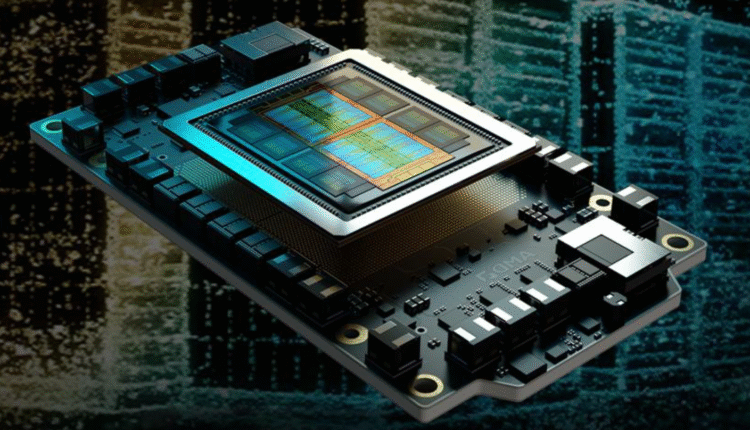

NVIDIA reste un acteur dominant dans le domaine de l’IA grâce à son système de ‘verrouillage CUDA’, qui pousse les fournisseurs de services cloud et les géants de l’IA à adopter leurs GPU. Une source ‘haut placée’ chez Microsoft indique que la société a mis au point des ‘toolkits’ permettant d’exécuter du code CUDA sur des GPU AMD via une traduction en version ROCm.

Nous avons créé des toolkits pour convertir des modèles CUDA en ROCm pour les utiliser sur des AMD, comme les 300X. Nous avons reçu de nombreuses demandes concernant ce collaboration avec AMD.

Défis et opportunités

Briser la domination de CUDA est un défi important, tant ce logiciel est ancré dans l’industrie de l’IA. Microsoft est probablement en train d’exploiter des solutions connues comme des couches de compatibilité d’exécution pour faciliter cette traduction. Par exemple, le projet ZLUDA permet à ces appels CUDA d’être traduits en ROCm sans une réécriture exhaustive.

Malgré cela, la maturité relative de la pile logicielle ROCm pose des problèmes, car certaines API sous CUDA n’ont pas d’équivalents directs, ce qui peut affecter les performances dans les centres de données. En parallèle, Microsoft semble développer un outil de migration vers le cloud, intégré à Azure, visant à optimiser l’utilisation des GPU AMD face à leurs concurrents onéreux de NVIDIA.

En raison de l’augmentation des demandes relatives à l’inférence, Microsoft voit un intérêt grandissant pour les puces AI d’AMD, qui représentent une alternative compétitive aux GPU coûteux de NVIDIA.