Récapitulatif : La course à l’accélérateur d’IA pousse l’innovation rapide dans les technologies de mémoire à large bande. Lors de l’événement GTC de cette année, des géants de la mémoire ont présenté leurs solutions HBM4 et HBM4e, marquant une avancée significative dans le domaine des performances de mémoire.

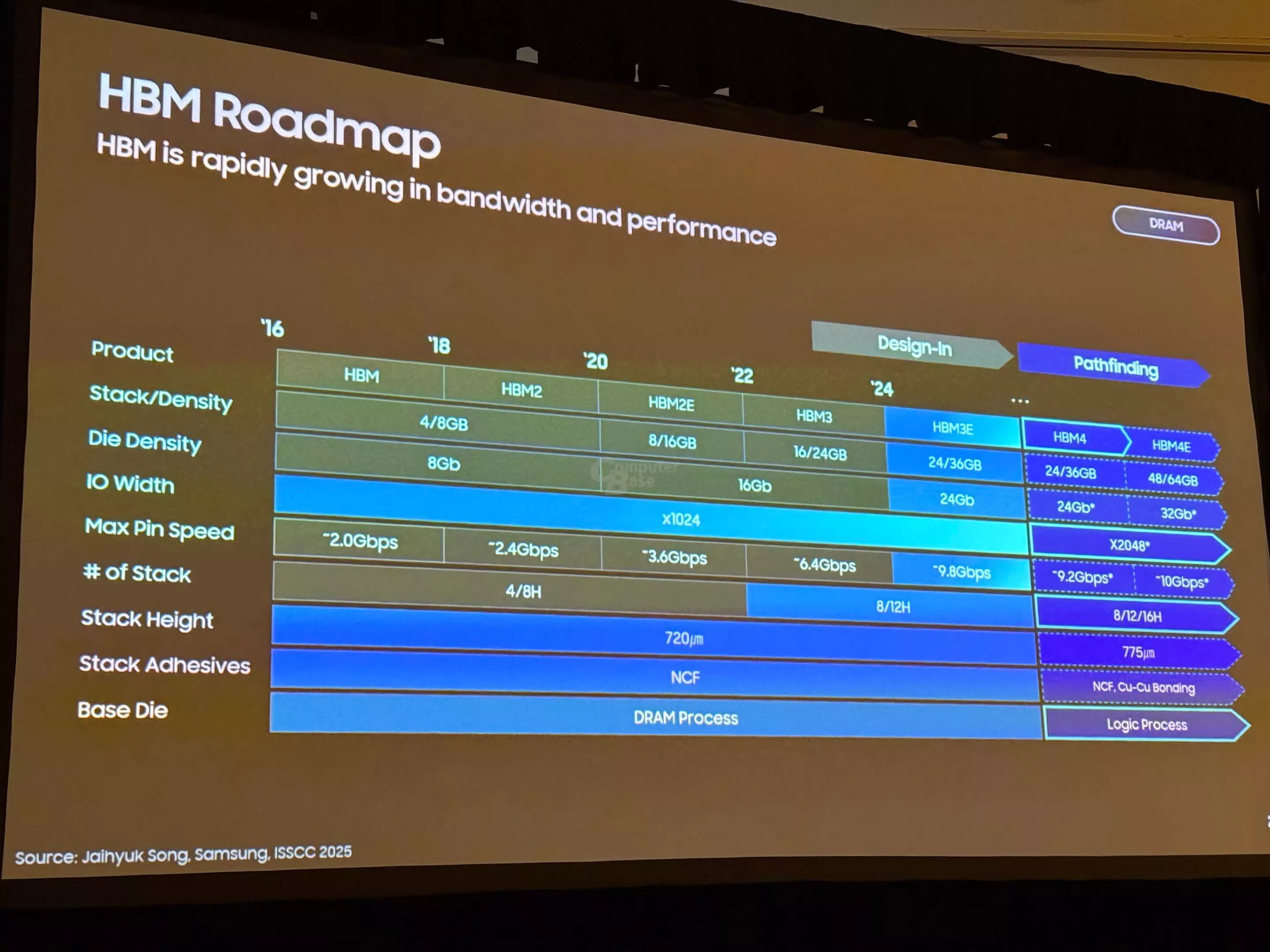

Alors que les GPU des centres de données passent à HBM3e, les roadmaps de la mémoire présentées lors de l’événement GTC de NVIDIA montrent clairement que HBM4 sera la prochaine grande étape. Computerbase a assisté à l’événement et a noté que ce nouveau standard permet des améliorations notables en termes de densité et de bande passante par rapport à HBM3.

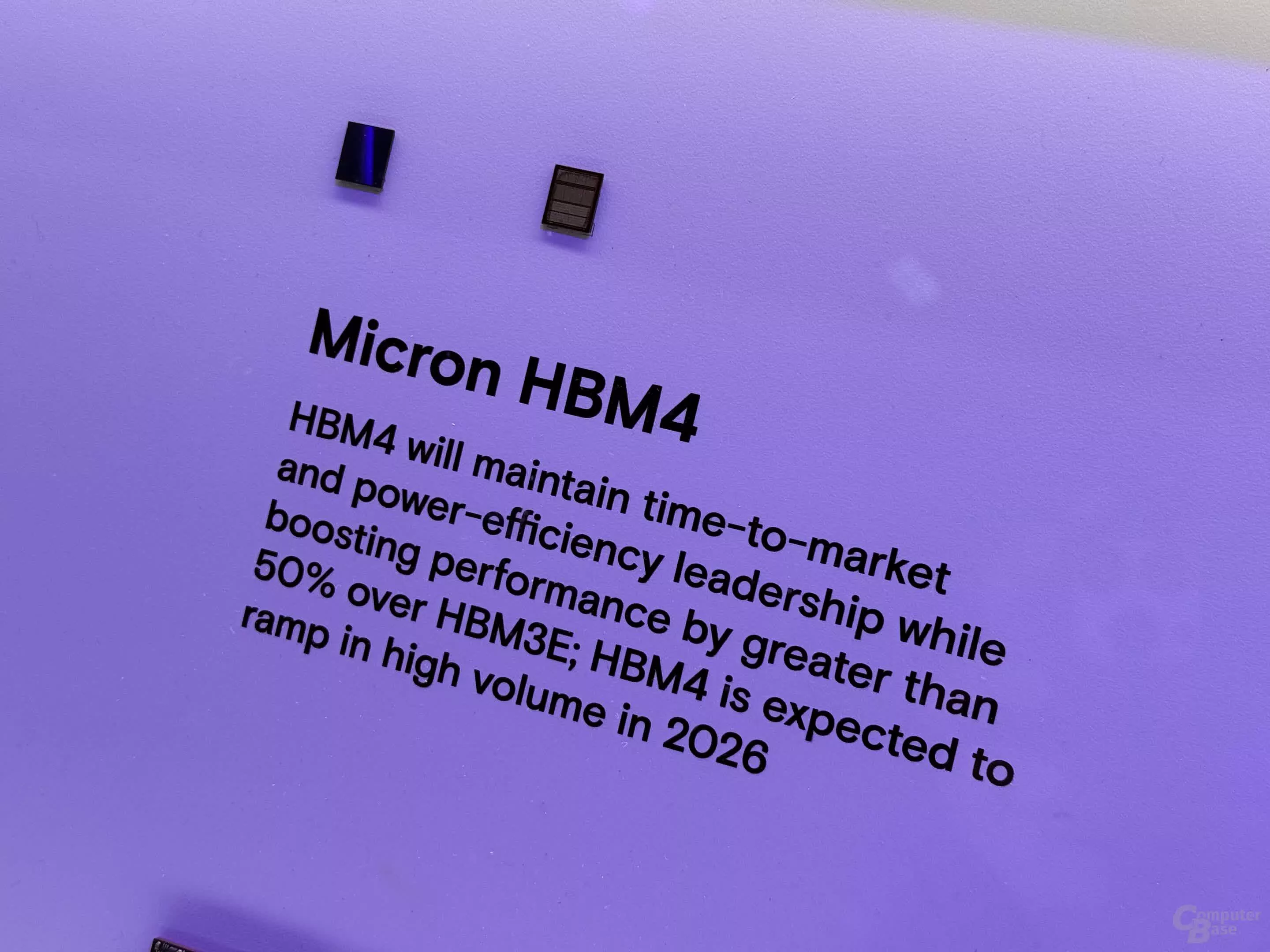

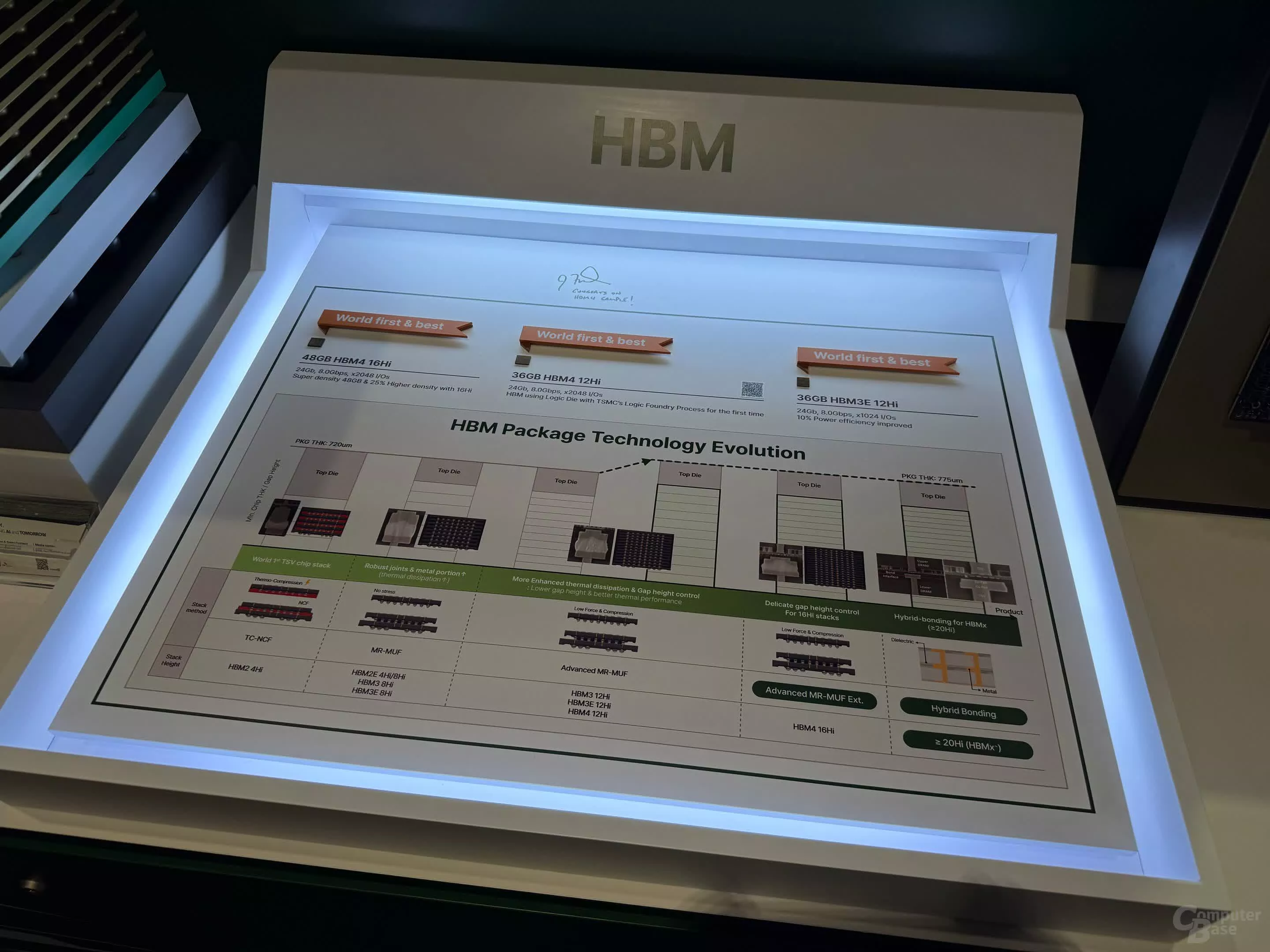

SK Hynix a présenté sa première pile HBM4 de 48 Go composée de 16 couches de puces de 3 Go fonctionnant à 8 Gbps. De même, Samsung et Micron ont montré des démonstrations similaires de HBM4 de 16 couches, Samsung affirmant que les vitesses atteindront finalement 9,2 Gbps au sein de cette génération. Nous devons nous attendre à des piles de 36 Go à 12 couches devenant plus courantes pour les produits HBM4 lancés en 2026. Micron indique que sa solution HBM4 améliorera les performances de plus de 50 % par rapport à HBM3e.

Cependant, les constructeurs de mémoire envisagent déjà l’au-delà de HBM4 vers HBM4e et des points de capacité impressionnants. La roadmap de Samsung prévoit des DRAM de 32 Gb par couche, permettant des empilements de 48 Go et même 64 Go avec des débits de données compris entre 9,2 et 10 Gbps. SK Hynix a évoqué la possibilité d’empilements de 20 couches ou plus, permettant des capacités allant jusqu’à 64 Go en utilisant leurs puces de 3 Go sur HBM4e.

Ces hautes densités sont essentielles pour les prochains GPU Rubin de NVIDIA, destinés à l’entraînement d’IA. La société a révélé que Rubin Ultra utilisera 16 empilements de HBM4e pour un impressionnant 1 To de mémoire par GPU lors de son arrivée en 2027. NVIDIA affirme qu’avec quatre chiplets par paquet et une bande passante de 4,6 Po/s, Rubin Ultra permettra un total de 365 To de mémoire dans le système NVL576.

Bien que ces chiffres soient impressionnants, ils s’accompagnent d’un prix très élevé. VideoCardz note que les cartes graphiques destinées aux consommateurs ne semblent pas prêtes à adopter les déclinaisons HBM de si tôt.

Les générations HBM4 et HBM4e représentent un lien essentiel pour permettre une montée en performances continue de l’IA. Si les constructeurs de mémoire parviennent à mettre en œuvre leurs feuilles de route ambitieuses concernant la densité et la bande passante au cours des prochaines années, cela stimulera considérablement les charges de travail gourmandes en données pour l’IA. NVIDIA et d’autres en comptent sur cela.