La question de la confiance envers l’IA se pose alors que les outils modernes tentent d’éliminer les interactions classiques avec les claviers et souris. Les avancées technologiques montrent un avenir où la voix pourrait prendre le relais, mais les doutes persistent quant à leur fiabilité dans des tâches essentielles.

“Hey ChatGPT, clique sur le champ de saisie du mot de passe dans la fenêtre contextuelle apparaissant dans le quadrant inférieur gauche de l’écran et remplis XUS&(#($J, puis appuie sur Entrée.”

Amusant, n’est-ce pas ? Non, merci. Je vais plutôt déplacer ma souris bon marché et taper les 12 caractères sur mon clavier trop sensible, au lieu de dire le mot de passe à haute voix dans mon espace de travail partagé.

C’est plutôt impressionnant de voir ChatGPT comprendre vos commandes vocales, réserver un billet bon marché pour huit personnes afin de regarder un match de Liverpool à Anfield, et vous amener à l’écran de paiement. Mais allez-vous lui faire confiance pour votre mot de passe ? Ou de préférence, n’allez-vous pas le taper via un clavier physique ?

Imaginez vous investir entièrement dans l’IA, pour réaliser que l’étape finale, où vous avez VRAIMENT besoin d’un clavier ou d’une souris, n’est pas faisable, et que vous voilà bloqué. C’est précisément la question que beaucoup se posent après avoir visionné les démonstrations flashy d’agents IA et d’automatisation, présentées par Google, OpenAI et Anthropic.

C’est une question légitime

L’IA était le thème central lors de l’événement I/O de Google plus tôt cette année. À la fin de la keynote, j’étais persuadé que les smartphones Android ne seront plus jamais les mêmes. Par extension, toute plateforme où Gemini sera présent – des applications Workspace comme Gmail jusqu’à la navigation sur Google Maps depuis une voiture.

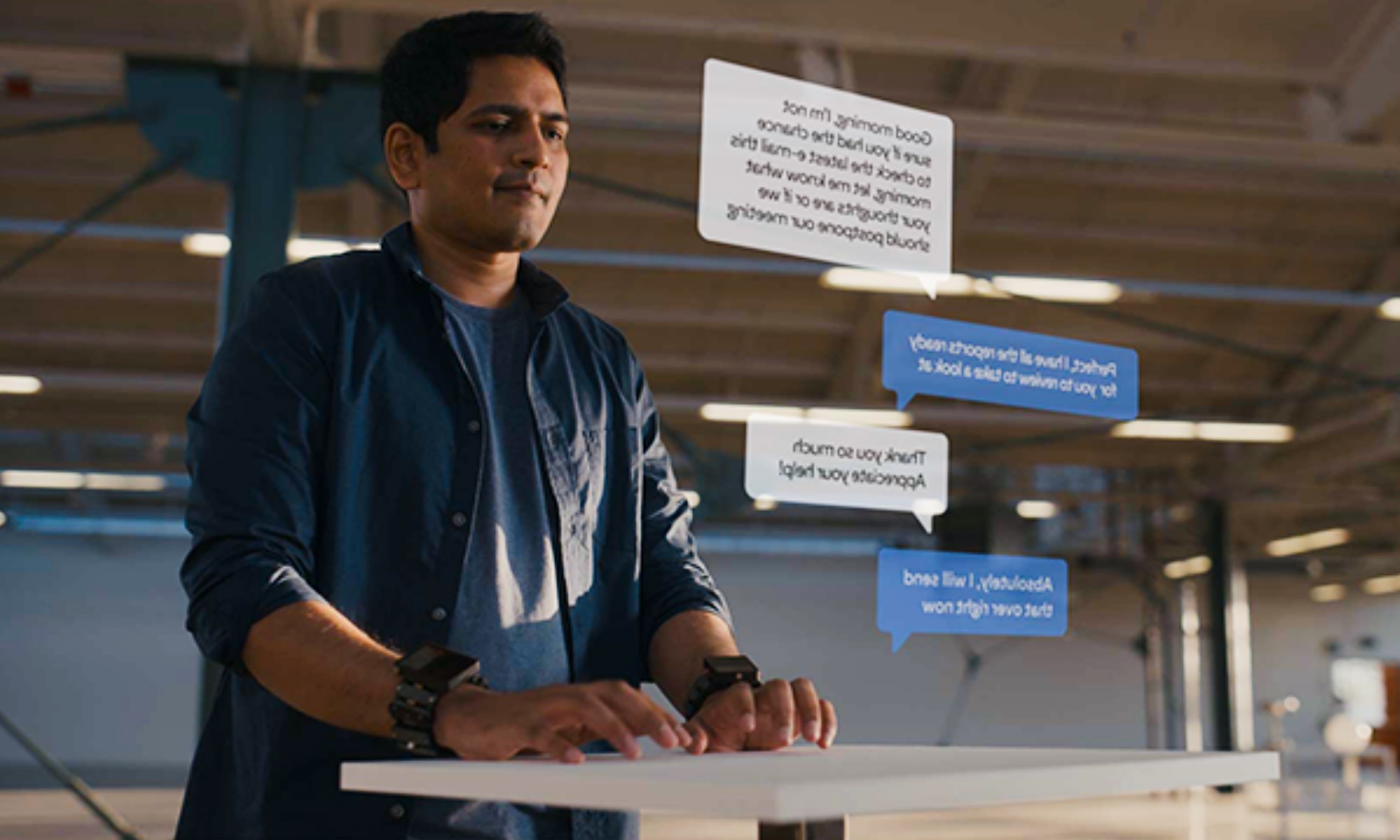

La démonstration la plus impressionnante était Project Mariner, et le prototype de recherche suivant de Project Astra. Pensez-y comme à un assistant conversationnel de nouvelle génération qui vous permettra de parler et d’accomplir des tâches réelles, sans jamais toucher l’écran ou sortir le clavier. Vous pouvez passer vos requêtes d’un manuel d’utilisateur hébergé sur le site d’une marque à des vidéos YouTube explicatives, sans jamais devoir répéter le contexte.

C’est presque comme si le concept véritable de mémoire était arrivé pour l’IA. Dans un navigateur, il va réserver vos billets, vous amener à la dernière page où vous devez simplement confirmer si tous les détails sont corrects, avant de procéder au paiement. Cela amène à se poser des questions sur la possibilité d’un monde sans clavier et souris alors que les interactions vocales deviennent la norme dans le domaine de l’IA.

Le fardeau de l’erreur

Étrangement, votre ordinateur est déjà équipé d’un contrôle vocal pour naviguer dans le système d’exploitation. Sur les PC Windows et macOS, vous pouvez trouver les outils de commande vocale inclus dans la suite d’accessibilité. Il existe quelques raccourcis disponibles pour accélérer le processus, et vous pouvez en créer vous-même.

Avec l’émergence des modèles IA de nouvelle génération, on parle d’abandonner le clavier et la souris pour tout le monde, et pas seulement de les voir comme une technologie d’assistance.

Imaginez une combinaison de l’utilisation de l’ordinateur de Claude et de l’entrée suivie par les yeux de l’Apple Vision Pro. En cas de méconnaissance, l’utilisation d’ordinateur d’Anthropic est un agent d’utilisation d’ordinateur. Anthropic affirme qu’il permet à l’IA de “utiliser les ordinateurs comme le font les personnes – en regardant un écran, en déplaçant un curseur, en cliquant sur des boutons et en tapant du texte.”

Prenons maintenant un scénario où votre intention est énoncée vocalement à Claude, captée par les micros intégrés, et la tâche est exécutée. Pour toute tâche finale requise de votre part, des gestes peuvent combler le vide. Le Vision Pro a montré que les commandes suivies par les yeux sont possibles et fonctionnent avec un haut degré de précision.

En dehors des casques, l’IA contrôlée par la voix peut encore fonctionner sur un ordinateur ordinaire. Hume AI, en partenariat avec Anthropic, développe un système appelé Empathetic Voice Interface 2 (EVI 2) qui transforme les commandes vocales en entrée pour l’ordinateur. C’est presque comme parler à Alexa, mais au lieu de commander des brocolis, l’assistant IA comprend ce que nous disons et le convertit en entrée clavier ou souris.

Tout cela semble formidable, mais soyons réalistes. Vous aurez besoin d’un clavier pour des modifications médiatiques précises. Effectuer des changements mineurs sur un canevas de programmation. Remplir des cellules dans une feuille. Imaginez dire : “Hé Gemini, mets quatre mille huit cents quatre-vingt-quinhuit dollars dans la cellule D5 et étiquette-la comme dépense de voyage aérien ?” Oui, je sais. Je préfèrerais tout taper moi-même.

Le dernier kilomètre, pas la fin

Si vous parcourez des démonstrations du mode IA dans la recherche, de l’agent Project Mariner, et de Gemini Live, vous aurez un aperçu de l’informatique vocale. Tous ces progrès en matière d’IA semblent incroyablement pratiques, jusqu’à ce qu’ils ne le soient plus. Par exemple, à quel moment cela devient trop irritant de dire des choses comme “Déplace-toi vers la boîte de dialogue dans le coin supérieur gauche et clique sur le bouton bleu qui évoqué Confirmer.”

C’est trop encombrant, même si toutes les étapes précédentes ont été réalisées automatiquement par une IA.

Et n’oublions pas le problème majeur. L’IA a tendance à devenir incontrôlable. “À ce stade, elle est encore expérimentale – parfois encombrante et sujette aux erreurs,” prévient Anthropic à propos de l’utilisation de l’ordinateur Claude. La situation n’est pas bien différente de l’agent opérateur d’OpenAI, ou d’un outil similaire actuellement en développement chez Opera, les créateurs d’un navigateur web très versatile.

Retirer le clavier et la souris d’un ordinateur équipé par l’IA, c’est comme conduire une Tesla en mode conduite autonome totale (FSD), mais sans direction. La voiture vous amènera assurément quelque part, mais vous devrez reprendre le contrôle en cas d’événement inattendu.

Dans le contexte de l’informatique, pensez au dépannage, où vous DEVEZ être au volant. Mais supposons qu’un modèle d’IA, principalement piloté par la voix (et capté par le micro de votre machine informatique préférée), vous amène à l’étape finale où vous devez conclure le flux de travail, comme effectuer un paiement.

Même avec les Passkeys, vous devrez confirmer votre identité en entrant le mot de passe, en ouvrant une application d’authentification, ou en touchant un capteur d’empreinte digitale. Aucun créateur de système d’exploitation ou développeur d’application (particulièrement celui traitant de la vérification d’identité) ne laisserait un modèle d’IA avoir le contrôle total sur cette tâche test.

Il est tout simplement trop risqué d’automatiser cette tâche avec un agent IA, même avec des commodités comme les Passkeys entrant en jeu. Google affirme souvent que Gemini apprendra de la mémoire et de vos propres interactions. Mais tout commence vraiment par lui permettre de surveiller votre utilisation de l’ordinateur, ce qui repose fondamentalement sur l’entrée clavier et souris. Donc oui, nous en revenons au point de départ.

Passer au virtuel ? Cela prendra du temps

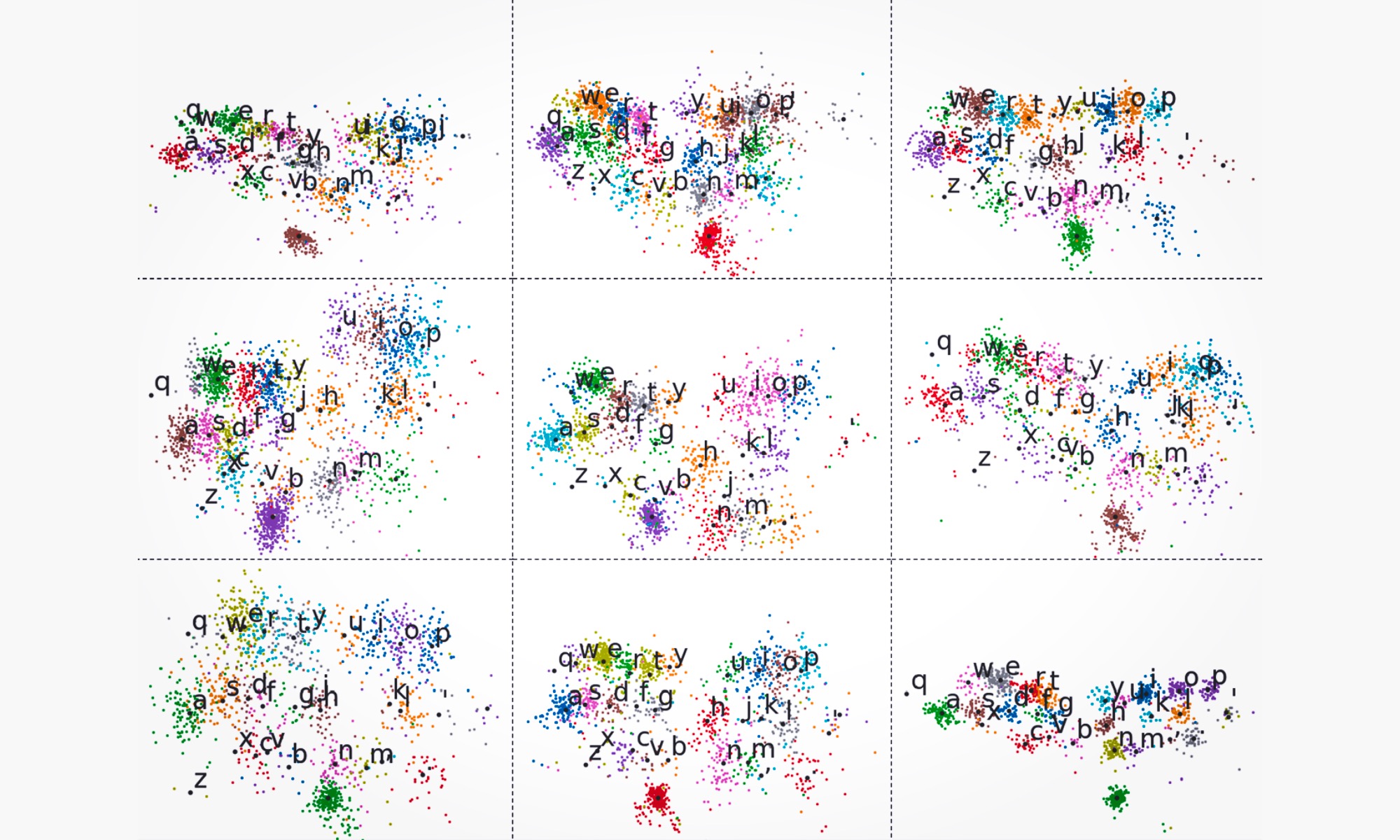

Lorsque l’on parle de remplacer la souris et le clavier d’ordinateur par une IA (ou tout autre avancement), on évoque en réalité leur substitution par un proxy. Et cela nous amène à un remplacement familier. Il existe une multitude de documents de recherche abordant les souris virtuelles et les claviers, datant d’au moins une décennie, bien avant que le papier « transformers » ne soit publié pour propulser l’industrie de l’IA à un nouveau niveau.

En 2013, DexType a lancé une application qui tirait parti du hardware Leap Motion pour permettre une expérience de saisie virtuelle dans l’air. Pas besoin d’écran tactile, ni d’un projecteur laser sophistiqué comme le Humane AI Pin. Leap Motion a disparu en 2019, mais l’idée est restée vivante. Meta est sans doute la seule entreprise disposant d’une pile logicielle et hardware réaliste prête pour une alternative d’entrée-sortie sur l’informatique, quelque chose qu’elle appelle l’interaction homme-machine (HCI).

Cette dernière travaille sur des appareils portés au poignet permettant une forme complètement différente de contrôle gestuel. Au lieu de suivre le mouvement spatial des doigts et des membres, Meta utilise une technique appelée électromyographie (EMG). Cette dernière transforme les signaux électriques générés par les nerfs moteurs dans le poignet en entrée numérique pour le contrôle des dispositifs. Et oui, les entrées de curseur et de clavier font bien partie du projet.

En parallèle, Meta affirme également que ces gestes seront plus rapides qu’une pression sur une touche classique, car nous parlons de signaux électriques voyageant de la main directement à un ordinateur, au lieu de mouvements de doigts. “C’est une manière beaucoup plus rapide d’exécuter les instructions que vous envoyez déjà à votre appareil lorsque vous appuyez pour sélectionner une chanson sur votre téléphone, cliquez sur une souris ou tapez sur un clavier aujourd’hui”, souligne Meta.

Moins de remplacements, plus de regroupements

Il y a deux problèmes avec l’approche de Meta, avec ou sans l’IA. Le concept de curseur est toujours très présent, tout comme celui du clavier, même s’ils prennent une forme numérique. Nous ne faisons que passer de l’élément physique à une version virtuelle. Le remplacement proposé par Meta semble très futuriste, surtout avec les modèles d’IA multi-modaux Llama de Meta.

Ensuite, il y a le dilemme existentiel. Ces dispositifs portables restent encore largement au stade de recherche. Lorsqu’ils sortiront, ils ne seront pas bon marché, du moins pour les premières années. Même des applications tierces basiques comme WowMouse sont soumises à des abonnements et entravées par des limitations OS.

Je ne peux pas imaginer abandonner mon clavier à 100 € pour un dispositif expérimental d’entrée verbale ou gestuelle, en envisageant qu’il remplace l’ensemble du flux de travail quotidien. Plus important encore, il faudra du temps avant que les développeurs adoptent les entrées pilotées par le langage naturel dans leurs applications. Ce sera un processus long et laborieux.

Quid des alternatives ? Eh bien, ils ont déjà des applications comme WowMouse, qui transforme votre smartwatch en un hub de reconnaissance gestuelle pour les mouvements des doigts et des paumes. Cependant, cela ne remplace que les gestes de curseur et de clic, sans vraiment offrir une expérience complète de clavier. Encore une fois, laisser les applications accéder à votre clavier comporte des risques que les dirigeants des systèmes d’exploitation vont très certainement prévenir. N’oublions pas les keyloggers.

Au final, nous sommes à un moment où les capacités conversationnelles des modèles d’IA et leurs compétences d’agence effectuent un bond considérable. Cependant, elles nécessiteront toujours votre intervention pour franchir la ligne d’arrivée avec un clic de souris ou quelques frappes sur le clavier, plutôt que de les remplacer totalement. De plus, elles restent trop encombrantes lorsque vous pouvez opter pour un raccourci clavier ou une souris au lieu de narrer une longue série de commandes vocales.

En résumé, l’IA diminuera ce dépendance à l’input physique, mais ne l’éliminera pas. Du moins, pas pour le grand public.