Au cours des trois dernières décennies, la fidélité visuelle des jeux vidéo sur PC a évolué à un rythme impressionnant. De simples triangles texturés, l’innovation a abouti à des pipelines programmables capables de simuler la lumière et la géométrie avec un réalisme jusqu’alors réservé à la production cinématographique.

Au cœur de cette transformation se trouve le pipeline de rendu graphique, processus qui convertit les données 3D en pixels. Bien qu’abstrait, ce pipeline est influencé tant par les logiciels (API graphiques, moteurs de jeux, shaders) que par le hardware (architecture GPU, sous-systèmes de mémoire). Chaque avancée majeure en réalisme visuel a découlé d’une refonte de ce pipeline, permettant aux studios de jeux d’explorer davantage de possibilités créatives.

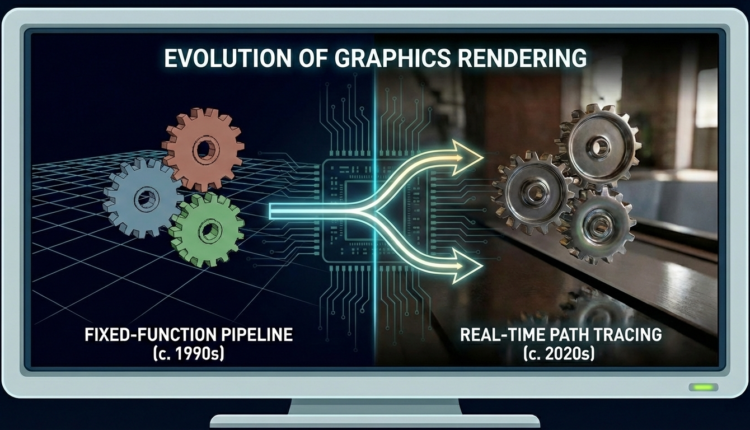

Nous allons retracer l’évolution du pipeline de rendu graphique sur PC, depuis l’ère des fonctions fixes jusqu’à celle du ray tracing en temps réel, en via le développement des shaders programmables. Cette analyse vise à éclairer les enjeux actuels et futurs du graphisme sur PC.

1. L’ère des fonctions fixes (milieu-fin des années 1990)

Avant l’avènement des shaders et des pipelines programmables, les graphismes PC étaient régis par le pipeline de fonctions fixes. Cette séquence rigide d’étapes est presque entièrement implémentée en hardware. À cette époque, le GPU ne pouvait pas être programmé, limitant ses capacités à un ensemble étroit d’opérations prédéfinies.

Une pipeline gravée dans le silicium

Le pipeline de fonctions fixes suivait un ordre strict:

- Transformation des vertices – conversion des coordonnées d’objets 3D en espace écran;

- Éclairage – calcul de l’éclairage par vertex;

- Clipping & Projection – élimination de la géométrie cachée;

- Rastérisation – conversion des triangles en fragments/pixels;

- Texturage & Mélange – application de textures et effets;

- Tests de profondeur & de stencil – détermination de la visibilité finale.

Malgré ses limites, le pipeline de fonctions fixes a posé les bases du graphisme PC moderne tout en offrant des performances acceptables pour l’époque.

2. L’essor des shaders programmables (début-milieu des années 2000)

Dans les années 2000, les choses ont radicalement changé avec l’introduction des shaders. Les développeurs ont commencé à écrire de petits programmes qui s’exécutaient directement sur le GPU, rendant ce dernier véritablement programmable.

Une transition vers la programmation

Ce changement a démarré avec DirectX 8, permettant aux développeurs de contrôler le rendu par des vertex shaders et pixel shaders.

Ces premiers shaders, bien que limités, ont permis d’explorer d’innombrables effets visuels auparavant impossibles.

Le bond visuel

Les shaders programmables ont ouvert la voie à des effets tels que l’éclairage par pixel et le bump mapping, offrant un réalisme sans précédent. Des titres comme Half-Life 2 sont devenus des références et ont mis en valeur ces nouvelles capacités.

3. Architecture de shaders unifiés et le pipeline moderne (milieu-fin des années 2000)

À mesure que les techniques de shader devenaient plus complexes, la nécessité d’unifier le traitement des vertex et des pixels est apparue. Avec Direct3D 10, tous les types de shaders pouvaient maintenant être exécutés sur un même groupe de cœurs de traitement.

Qu’est-ce que des shaders unifiés?

Cette architecture a permis une bien meilleure utilisation des ressources matérielles et une flexibilité accrue pour gérer des scènes complexes. À la fin des années 2000, les nouvelles étapes programmables ont transformé le pipeline en un système modulaire.

4. API bas niveau et contrôle explicite (milieu des années 2010)

Les progrès des GPU ont été freinés par les limitations des API graphiques de l’époque. Avec Direct3D 12 et Vulkan 1.0, les développeurs ont obtenu un contrôle bien plus direct sur le hardware.

Réécriture du pipeline autour du moteur

Les moteurs de jeux ont commencé à définir leurs propres graphes de rendu, contrôlant ainsi le flux des opérations. Cette évolution a permis une gestion plus fine des ressources et des performances optimisées.

5. Ray tracing en temps réel et pipelines hybrides (fin des années 2010 à aujourd’hui)

La dernière avancée majeure est le ray tracing en temps réel, qui permet des rendus d’une qualité auparavant réservée aux films d’animation. NVIDIA a ouvert la voie avec sa série GeForce RTX 2000.

Une percée avec RTX

Le ray tracing en temps réel, facilité par l’API DirectX Ray Tracing (DXR), permet désormais de gérer des éclairages complexes, tels que des réflexions et des ombres détaillées, en temps réel.

Les jeux modernes et la convergence des pipelines

Les titres récents combinent désormais rasterisation et ray tracing, permettant d’exploiter les avantages des deux techniques. Le résultat est un système visuel riche et performant.

En somme, la représentation graphique est en constante évolution, prenant en compte les innovations passées tout en se dirigeant vers un avenir où la distinction entre jeu en temps réel et rendu hors ligne s’estompe.