La mémoire HBM va subir une transformation significative avec les normes HBM5 et HBM6 en développement, intégrant de nouveaux équipements TC Bonders.

Hanmi présente ses premiers TC Bonders pour les mémoires HBM5 et HBM6

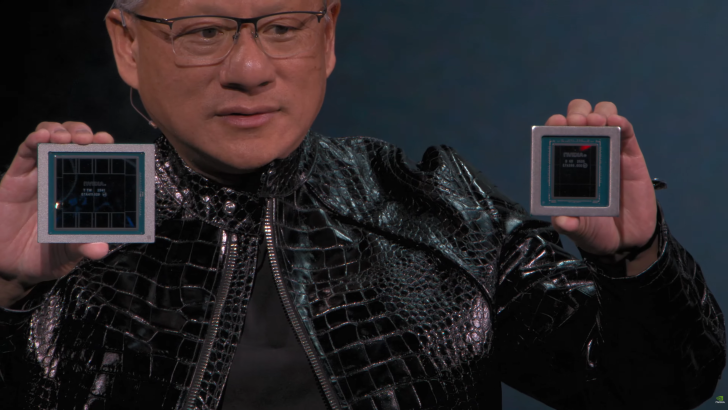

Cette année, NVIDIA et AMD vont lancer leurs nouveaux accélérateurs AI utilisant la mémoire HBM4, comme les produits de la série Instinct MI450 et Vera Rubin. Cependant, les avancées dans l’industrie de la tech AI entraînent déjà le développement des standards HBM5 et HBM6.

Selon un communiqué de Heraldcorp, les premiers Wide TC Bonder seront dévoilés lors du Semicon 2026 en Corée. Cet équipement sera une alternative au Hybrid Bonder (HB) pour produire en masse la mémoire HBM.

Le Wide TC Bonder est prometteur car, contrairement aux problèmes techniques rencontrés par le Hybrid Bonder, il devrait augmenter les rendements de production d’une manière plus efficace. Il est doté d’une technologie avancée de collage de précision.

Une autre innovation majeure est la méthode de collage sans flux, qui réduit la couche d’oxyde sur la surface des chips, ce qui renforce le collage tout en réduisant l’épaisseur globale de la mémoire HBM.

HBM5 cible NVIDIA Feynman avec une sortie prévue pour 2029

La norme HBM5 maintient un taux de données de 8 Gbps pour l’édition non-e, en augmentant le nombre de pistes I/O à 4096 bits et en portant la bande passante à 4 To/s par empilement. Avec des dies DRAM de 40 Gb, HBM5 pourra atteindre une capacité de 80 Go par empilement.

- Taux de données : 8 Gbps

- Nombre d’I/O : 4096

- Bande passante totale : 4.0 To/s

- Nombre d’empilements : 16-Hi

- Capacité par die : 40 Gb

- Capacité par HBM : 80 Go

- Puissance par HBM : 100W

- Méthode d’emballage : Microbump (MR-MUF)

- Méthode de refroidissement : Refroidissement par immersion, Thermal Via (TTV), Thermal Bonding

- Capacité de condensateur de découplage dédiée

- Die de base HBM personnalisé avec 3D NMC-HBM & Cache empilé

- LPDDR+CXL dans le die de base

- Supports NVIDIA Feynman & Instinct MI500

HBM6 pour l’architecture GPU Post-Feynman – Capacités et bande passante massives

Avec HBM6, la bande passante passe à 8 To/s, et la capacité par die DRAM pourrait atteindre 48 Gb, avec des empilements allant jusqu’à 20-Hi. Cela pourrait permettre jusqu’à 120 Go par empilement et une puissance de 120W par stack.

- Taux de données : 16 Gbps

- Nombre d’I/O : 4096

- Bande passante totale : 8.0 To/s

- Nombre d’empilements : 16/20-Hi

- Capacité par die : 48 Gb

- Capacité par HBM : 96/120 Go

- Puissance par HBM : 120W

- Méthode d’emballage : Bump-less Cu-Cu Direct Bonding

- Méthode de refroidissement : Refroidissement par immersion

- HBM multi-tours personnalisées

- Interposer actif/hybride (silicium + verre)

- Switch Ethernet + Die de pont

Alors que la production de masse de HBM4 débute cette année, le développement de HBM5 et HBM6 est en bonne voie. Ces standards offriront des mises à jour de vitesse et de technologie significatives par rapport à HBM4, positionnant ainsi les futurs GPU pour des performances jamais vues auparavant.