Les ordinateurs portables modernes intègrent de plus en plus l’intelligence artificielle, avec des puces innovantes comme le Snapdragon X Elite et les Ryzen AI 300. Cependant, ces avancées soulèvent des questions sur leur réelle utilité face aux besoins actuels. Une exploration des défis et perspectives de cette technologie dans le secteur s’impose.

Les meilleurs ordinateurs portables et marques d’ordinateurs portables s’engagent pleinement dans l’IA. Comparé à l’année dernière, la liste des meilleurs ordinateurs portables est désormais envahie par des NPUs et une nouvelle génération de processeurs, tous promettant d’intégrer l’IA dans tous les aspects de notre vie quotidienne. Cependant, après quelques années dans cette révolution de l’IA, les résultats restent encore limités.

Nous avons enfin les très attendus Snapdragon X Elite de Qualcomm dans les ordinateurs portables Copilot+, et AMD a également décidé de se lancer avec ses puces Ryzen AI 300. Bientôt, nous verrons aussi les CPU Intel Lunar Lake. Cependant, au fur et à mesure que ces processeurs apparaissent, il devient clair qu’ils ne sont pas conçus pour un futur orienté IA mais plutôt pour les besoins actuels, et on ne peut souvent pas allier les deux.

Il s’agit d’espace

Un aspect essentiel de la conception des puces, souvent peu discuté, est l’espace. Si vous parcourez des forums de matériel et des sites web dédiés aux passionnés, vous savez à quel point l’espace est crucial.

Cependant, pour beaucoup, ce n’est pas une préoccupation courante. Des entreprises comme AMD et Intel pourraient fabriquer d’énormes puces avec une puissance de calcul impressionnante — et des exigences de puissance et thermiques conséquentes, mais ce n’est pas le sujet ici — néanmoins, elles ne le font pas. Une grande partie de l’art de la conception de puces réside dans la quantité de puissance que l’on peut entasser dans un espace donné.

Il est primordial de comprendre que rajouter du matériel sur une puce n’est pas sans coût — cela signifie enlever de l’espace à quelque chose d’autre. Par exemple, vous pouvez voir une image annotée d’une puce Ryzen AI 300 ci-dessous. En haut à droite, on peut observer l’espace occupé par le NPU XDNA. C’est le plus petit des trois processeurs sur la puce — des spéculations l’estiment à environ 14mm2 — mais cela représente tout de même un certain encombrement. AMD aurait pu utiliser cet espace pour ajouter plus de cœurs ou, plus probablement, un cache L3 Infinity supplémentaire pour le GPU.

Annotated! 😁

Étrange comment les unités scalaires RDNA WGP continuent de bouger, revenant finalement à la configuration RDNA1.

La SRAM autour de l’IMC est aussi présente sur PHX2 (et présumément PHX1), mais apparemment pas sur le IOD desktop ou les CPU/APUs plus anciens.

Dans l’ensemble… intéressant, sans grandes surprises. https://t.co/cf6MZVMgT2 pic.twitter.com/MfPqQRDGcY

— Nemez (@GPUsAreMagic) 29 juillet 2024

Ce n’est pas pour stigmatiser AMD ni pour dire que les CPU Ryzen AI 300 sont mauvais. Ce n’est pas le cas, comme vous pouvez le lire dans notre test du Asus Zenbook S 16. AMD, Intel et Qualcomm font constamment des compromis dans la conception pour intégrer tout ce dont ils ont besoin dans la puce, et ce n’est pas aussi simple que d’ajouter plus de cache et de considérer cela comme suffisant. Actionner un levier modifie d’innombrables autres valeurs, et toutes nécessitent un équilibre.

Cependant, cela montre bien qu’ajouter un NPU à une puce n’est pas quelque chose que les designers peuvent faire sans sacrifier d’autres éléments. Actuellement, ces NPUs sont essentiellement inutiles. Même les applications accélérées par l’IA préfèrent utiliser la puissance de calcul du GPU intégré, et si vous avez un GPU discret, il sera de loin plus performant que le NPU. Il existe certes quelques cas d’utilisation pour un NPU, mais pour la grande majorité des utilisateurs, le NPU sert surtout à fournir un flou d’arrière-plan (légèrement) amélioré.

Le Ryzen AI 300 est l’unique exemple dont nous disposons pour le moment, mais les futures puces Lunar Lake d’Intel seront également confrontées à un dilemme similaire. AMD et Intel visent tous deux l’approbation de Microsoft pour les PC Copilot+, et intègrent donc des NPUs capables d’atteindre un niveau de puissance pour répondre aux exigences apparemment arbitraires de Microsoft. Avant Copilot+, AMD et Intel incluaient déjà des coprocesseurs IA sur leurs puces — mais ces coprocesseurs sont pratiquement inutiles maintenant que de nouvelles exigences beaucoup plus élevées ont émergé.

Il est difficile de dire si AMD et Intel auraient conçu leurs processeurs de manière différente sans l’impulsion de Copilot+. Pour l’heure, nous avons une pièce de silicium qui n’a guère de but sur Ryzen AI 300 et, à terme, sur Lunar Lake. Cela rappelle la poussée d’Intel avec Meteor Lake, qui sont devenus quasiment obsolètes face aux exigences de Copilot+.

Fonctionnalités IA prometteuses

Avec les promesses d’AMD et d’Intel, ces derniers devraient être intégrés dans le dispositif Copilot+ à terme. Actuellement, seuls les puces Snapdragon X Elite de Qualcomm ont reçu le feu vert de Microsoft, mais AMD assène que sa puce pourra accéder aux fonctionnalités Copilot+ avant la fin de l’année. Cependant, cela pose un autre problème — nous manquons de fonctionnalités Copilot+.

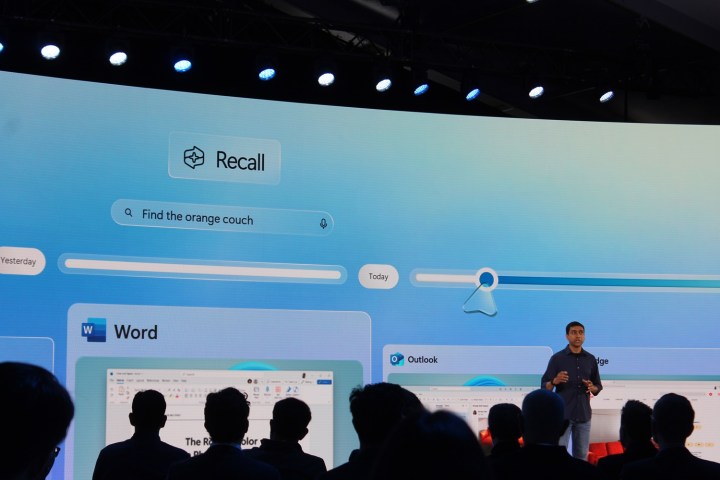

Le point central depuis l’annonce de Copilot+ par Microsoft a été Recall, et personne en dehors de la presse n’a pu l’utiliser. Microsoft a retardé son lancement, limité son accès aux Windows Insiders, et lorsque les PC Copilot+ étaient prêts à être lancés, le report a été indéfini. AMD et Intel pourraient être intégrés à Copilot+ avant la fin de l’année, mais cela n’a guère d’importance si nous n’avons pas plus de fonctionnalités IA locales.

Nous voyons certaines conséquences de l’influence de Microsoft sur l’industrie des PC. De nouveaux chips de Qualcomm et AMD, et bientôt Intel, tous contenant un morceau de silicium qui ne fait pas grand-chose. Cela donne l’impression d’un processus précipité, un peu comme ce qu’on a vu avec Bing Chat, et je me demande si Microsoft est vraiment aussi engagé dans cette plateforme qu’il le prétend. Sans compter que ce qui pousse les ventes des PC Copilot+ ce ne sont pas les fonctionnalités IA, mais une meilleure autonomie.

Dans les prochaines années, on estime qu’un demi-milliard d’ordinateurs portables compatibles IA seront vendus, et qu’en 2027, ils représenteront plus de la moitié des expéditions de PC. On comprend donc pourquoi Microsoft et l’industrie des PC souhaitent à ce point investir dans l’IA. Cependant, concernant les produits disponibles aujourd’hui, il est difficile de dire qu’ils sont aussi indispensables que Microsoft, Intel, AMD et Qualcomm voudraient nous le faire croire.

Préparer le terrain

Il est toujours important d’examiner le pourquoi dans cette situation. Nous faisons face à un problème classique de poule et d’œuf avec les PC IA, et même avec l’introduction de Copilot+ et le report de Recall, cela n’a pas changé. Intel, AMD et Qualcomm tentent de poser les bases des applications IA qui existeront à l’avenir, lorsque, espérons-le, elles seront si intégrées à notre utilisation des PC que nous ne penserons même plus à avoir un NPU. Ce n’est pas une idée folle — Apple fait cela depuis des années, et Apple Intelligence semble être l’évolution naturelle de tout cela.

Cependant, ce n’est pas le cas actuellement, donc si vous investissez dans un PC IA, soyez préparé aux conséquences d’être un utilisateur précoce. Il n’y a pas énormément d’applications pouvant tirer parti de votre NPU, sauf si vous cherchez vraiment, et même pour les applications avec des fonctionnalités IA locales, elles préfèrent s’exécuter sur votre GPU. Sans oublier les changements d’exigence que nous avons déjà vus avec Copilot+ et la première vague de NPUs d’AMD et d’Intel.

Je ne doute pas que nous y parviendrons — il y a tout simplement trop d’argent investi dans l’IA pour que cela ne devienne pas un élément incontournable dans les PC. Je suis encore en attente de voir quand cela sera réellement aussi essentiel que ce qu’on nous a dit.