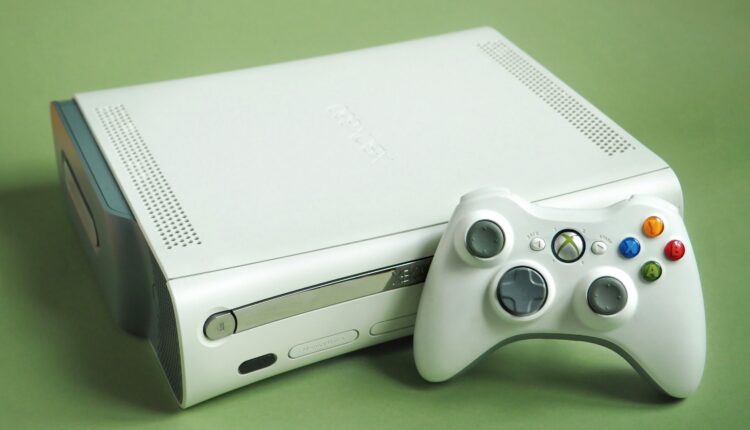

Un projet audacieux : Un développeur a réussi à exécuter un modèle d’IA sur la console Xbox 360 de Microsoft, ancienne mais emblématique. En surmontant de nombreux défis techniques, il a démontré que même des appareils obsolètes peuvent être adaptés pour faire tourner des technologies modernes, rendant l’IA accessible sur des plateformes inattendues.

A hot potato: Le projet open-source llama2.c a été conçu pour exécuter une version légère du modèle Llama 2 entièrement en code C. Ce modèle « bébé » Llama 2 est inspiré par llama.cpp, un projet créé pour permettre l’inférence LLM sur une large gamme de matériels, des dispositifs locaux aux plateformes basées sur le cloud. Ces expériences de code compactes sont désormais exploitées pour faire fonctionner la technologie IA sur pratiquement n’importe quel appareil doté d’une puce, mettant en valeur l’accessibilité et la polyvalence croissantes des outils IA.

Après avoir vu Exo Labs faire fonctionner un modèle de langage sur un ancien Pentium II sous Windows 98, le développeur Andrei David a décidé de relever un défi encore plus inhabituel. En dépoussiérant sa console Xbox 360, il s’est aventuré à faire fonctionner un modèle d’IA de la famille Llama de Meta AI sur cette machine vieillissante.

David a partagé sur X qu’il avait réussi à porter llama2.c sur la console de jeu de Microsoft de 2005. Cependant, ce processus n’a pas été sans défis majeurs. Le CPU PowerPC de l’Xbox 360 a une architecture big-endian, nécessitant une conversion d’endianness étendue pour la configuration et les poids du modèle. De plus, il a dû réaliser d’importants ajustements et optimisations du code original pour le faire fonctionner sur le hardware ancien.

LLM running on Xbox 360

Avec le CPU Xenon (PowerPC 3.2GHz w/ 3 cœurs) et 512 Mo de RAM unifiée. Basé sur @karpathy‘s🩷llama2.c, porté pour fonctionner sur la puissante console de Microsoft de 2005. Mise en œuvre pure en C optimisée pour l’architecture PowerPC et la gestion de la mémoire Xbox.

Inspiré par… pic.twitter.com/e9oMLaWIyi

– Andrei David (@AndreiDavid) 10 janvier 2025

La gestion de la mémoire a également posé un défi important. Le modèle llama2 de 60 Mo devait être soigneusement structuré pour s’adapter à l’architecture de mémoire unifiée de l’Xbox 360, où le CPU et le GPU partagent le même pool de RAM. D’après David, l’architecture de mémoire de l’Xbox 360 était remarquablement innovante pour son époque, préfigurant les techniques de gestion de la mémoire désormais standards dans les consoles de jeu modernes et les APU.

Après un codage et une optimisation intensifs, David a réussi à exécuter llama2 sur son Xbox 360 avec une simple invite : « Sleep Joe said ». Bien que le modèle llama2 ne comporte que 700 lignes de code C sans dépendances externes, David a noté qu’il peut fournir des performances « surprenantes » lorsqu’il est adapté à un domaine suffisamment restreint.

David a expliqué qu’exercer ses talents dans les limites d’une plateforme comme l’Xbox 360 l’oblige à prioriser l’utilisation efficace de la mémoire avant tout. En réponse, un autre utilisateur sur X a suggéré que les 512 Mo de mémoire de l’ancienne console de Microsoft pourraient suffire à exécuter d’autres petites implémentations LLM, comme smolLM, créées par la startup IA Hugging Face.

Le développeur a agréé au défi, et nous devrions donc voir d’autres expériences LLM sur Xbox 360 dans un avenir proche.