Les puces AI de Cerebras commencent à être adoptées de manière significative, notamment par OpenAI, qui annonce que son dernier modèle Codex bénéficie d’un nouveau fournisseur de calcul aux côtés de NVIDIA.

OpenAI réalise une sortie impressionnante de 1 000 TPS grâce à la bande passante exceptionnelle de Cerebras

Bien qu’il y ait eu des tensions financières entre NVIDIA et OpenAI, cette dernière a choisi une voie alternative en collaborant auparavant avec Cerebras. Dans sa récente version du Codex, OpenAI révèle que le GPT-5.3-Codex-Spark utilise les puces AI de Cerebras, apportant un avantage en matière de « faible latence » pour les tâches d’inférence. Ce choix affirme aussi une compétition croissante pour NVIDIA dans ce domaine.

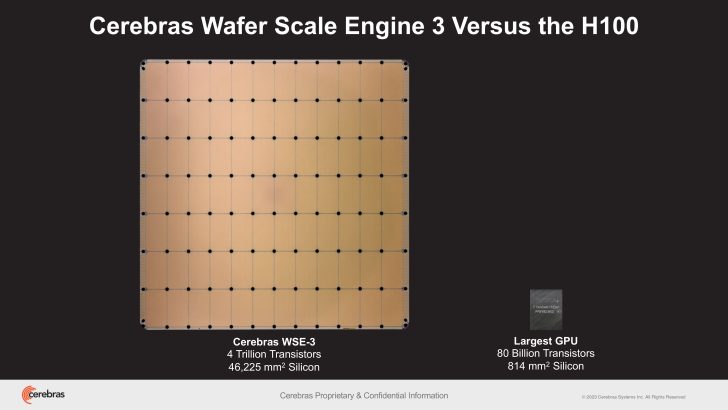

La déclinaison Codex-Spark se distingue par sa capacité à « accomplir le travail dans l’instant ». OpenAI a optimisé les pipelines pour atteindre une réduction de 50 % du temps de génération du premier token. Ce modèle fonctionne sur le Wafer Scale Engine 3 de Cerebras, offrant ainsi une bande passante mémoire incroyable, essentielle pour les tâches liées à la programmation.

| Caractéristiques | WSE-3 |

|---|---|

| Nœud de fabrication | TSMC 5nm |

| Transistors | ~4 trillions |

| Cœurs de calcul | 900 000 cœurs optimisés pour l’IA |

| SRAM On-Chip | 44 Go |

| Bande passante mémoire (On-Chip) | 21 PB/s |

| Taille de wafer | Full 300mm wafer-scale chip |

| Architecture des cœurs | Cœurs de traitement programmables optimisés pour l’IA |

OpenAI préfère Cerebras pour sa bande passante mémoire, cruciale pour ses charges de travail. Grâce à Codex-Spark, OpenAI atteint 1 000 TPS, offrant une réactivité comparable à celle d’un « pair programmer » humain. L’architecture de Blackwell de NVIDIA se concentre plus sur le traitement par lots que sur la latence, ce qui explique ce choix.

NVIDIA reste le leader incontesté en termes de dépenses sur les tokens, ayant récemment annoncé une réduction des coûts jusqu’à 10 fois avec Blackwell. Sachin Katti d’OpenAI souligne que la collaboration avec Cerebras apporte des « capacités complémentaires », mais l’allégeance d’OpenAI dans cette compétition reste principalement envers NVIDIA. La latence étant le principal obstacle, la technologie d’NVIDIA pourrait être moins adaptée pour le moment.

Il sera intéressant d’observer comment NVIDIA s’adapte sur le marché de l’inférence face à des concurrents tels que Cerebras et d’autres solutions émergentes.