La nouvelle technologie de compression de textures de NVIDIA réduit l’utilisation de VRAM jusqu’à 95 %

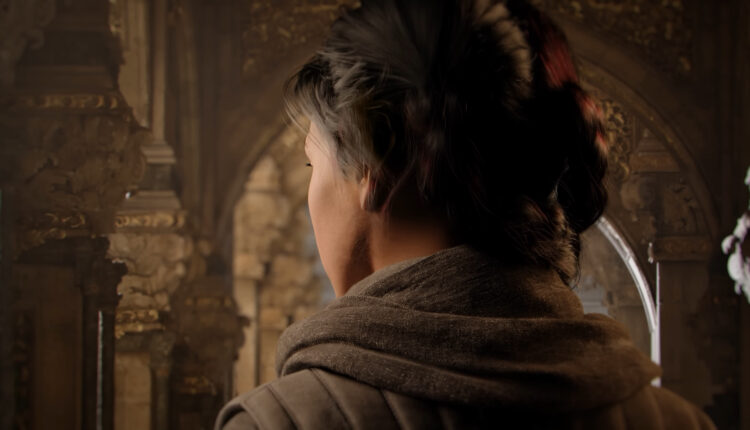

NVIDIA explore un nouveau procédé innovant pour la compression des textures, promettant des économies significatives en VRAM pour le rendu graphique 3D. Un récent démo prouve que cette technologie, bien que toujours en bêta, pourrait transformer le paysage du gaming en réduisant le poids des textures sans sacrifier la qualité visuelle.

Avis futuriste : NVIDIA travaille depuis quelques années sur une nouvelle méthode pour comprimer les textures et économiser la mémoire GPU. Bien que la technologie soit toujours en bêta, une démo récemment publiée illustre comment des solutions basées sur l’IA pourraient aider à résoudre les limitations de VRAM de plus en plus controversées des GPU modernes.

La compression de textures neuronales de NVIDIA peut offrir d’énormes économies en matière de VRAM requise pour rendre des graphiques 3D complexes, bien que personne ne l’utilise (pour l’instant). Bien que toujours en phase bêta, la technologie a été testée par la chaîne YouTube Compusemble, qui a exécuté la démo officielle sur un système de jeu moderne afin de fournir une première évaluation de son impact potentiel et ce que les développeurs pourraient réaliser dans un avenir proche.

Comme l’explique Compusemble dans la vidéo ci-dessous, la compression de textures neuronales RTX utilise un réseau de neurones spécialisé pour compresser et décompresser dynamiquement les textures des matériaux. La démo de NVIDIA comprend trois modes de rendu : Matériel de référence, NTC transcoded to BCn, et Inference sur exemplaire.

- Matériel de référence : Ce mode n’utilise pas NTC, ce qui indique que les textures restent dans leur état d’origine, entraînant une utilisation élevée du disque et de la VRAM.

- NTC transcoded to BCn (formats comprimés par blocs) : Ici, les textures sont transcoded lors du chargement, réduisant significativement l’empreinte disque mais offrant seulement des économies modérées de VRAM.

- Inference sur exemplaire : Cette approche décompresse les éléments de texture uniquement lorsque cela est nécessaire lors du rendu, réalisant les plus grandes économies tant en espace disque qu’en VRAM.

Compusemble a testé la démo aux résolutions 1440p et 4K, alternant entre DLSS et TAA. Les résultats suggèrent que, bien que NTC puisse réduire de manière draconienne l’utilisation de la VRAM et de l’espace disque, cela pourrait également affecter les taux d’images. À 1440p avec DLSS, le modèle NTC transcoded to BCn a réduit l’utilisation de la mémoire texte de 64 % (de 272 MB à 98 MB), tandis que l’inférence NTC sur exemplaire l’a drastiquement abaissée à 11,37 MB, soit une réduction de 95,8 % comparé à la compression non neuronale.

À lire également : Pourquoi les jeux PC modernes utilisent autant de VRAM ?

La démo a été exécutée sur un GPU GeForce RTX 4090, où DLSS et des résolutions plus élevées ont exercé une charge supplémentaire sur les Cœurs de Tensor, affectant les performances selon les réglages et la résolution. Cependant, les nouveaux GPU pourraient offrir des taux d’images plus élevés et rendre les différences négligeables une fois correctement optimisés. Après tout, NVIDIA investit massivement dans des techniques de rendu équipées par l’IA comme NTC et d’autres applications RTX.

La démo montre également l’importance des vecteurs coopératifs dans les pipelines de rendu modernes. Comme l’a expliqué récemment Microsoft, ces vecteurs accélèrent les charges de travail d’IA pour le rendu en temps réel en optimisant les opérations vectorielles. Ces calculs jouent un rôle crucial dans l’entraînement et l’affinage des modèles d’IA et peuvent aussi être exploités pour améliorer l’efficacité du rendu des jeux.