Un récent événement d’AMD a révélé des avancées notables dans le domaine de l’intelligence artificielle, avec des annonces concernant de nouveaux processeurs, des solutions de mise en réseau, et des développements logiciels visant à rivaliser avec les leaders du marché.

AMD a récemment tenu son événement « Advancing AI », marquant une étape majeure pour l’entreprise dans un marché dominé par la concurrence. Loin de se laisser décourager, AMD a exprimé son engagement à élargir sa gamme de produits et à accélérer le rythme de ses innovations.

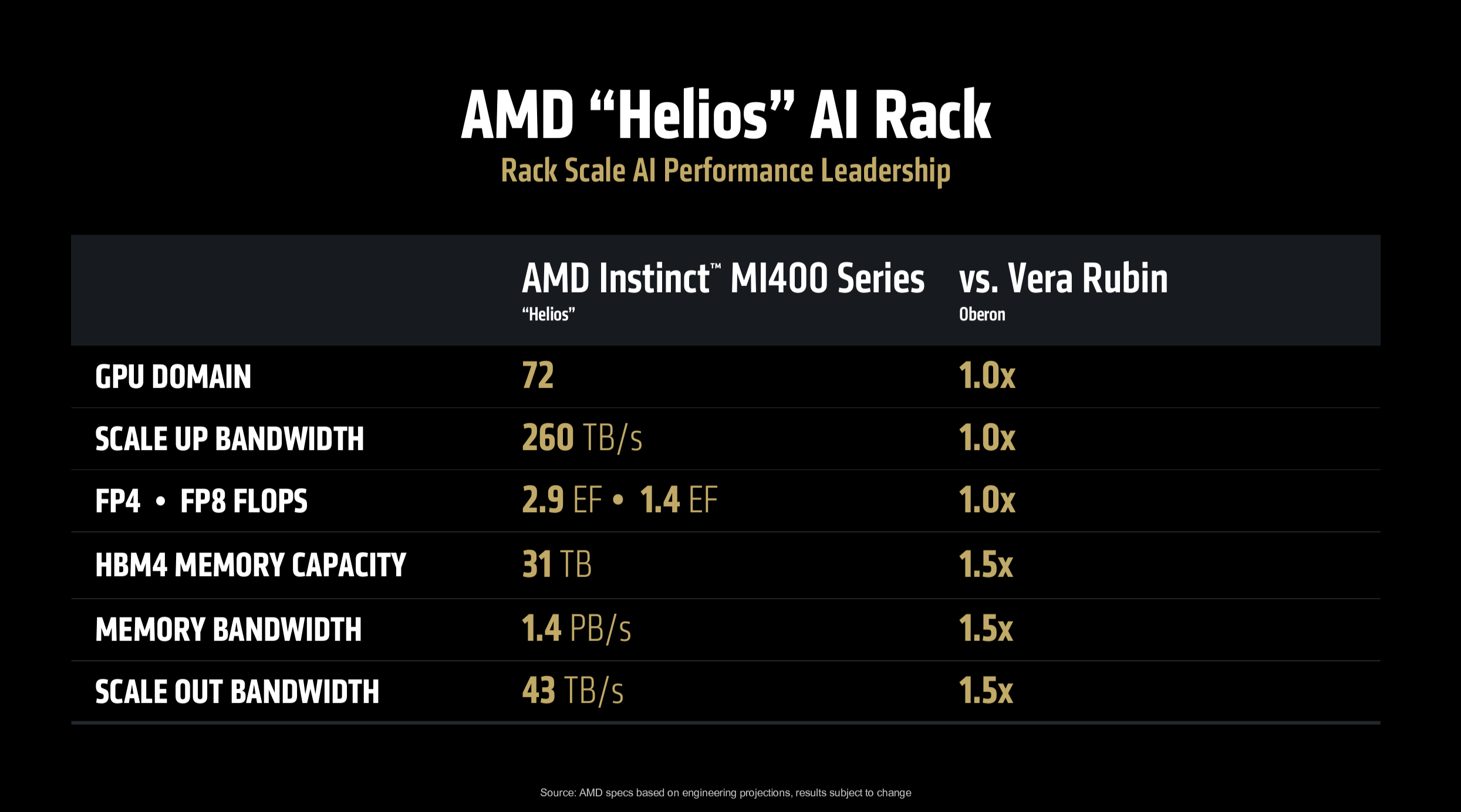

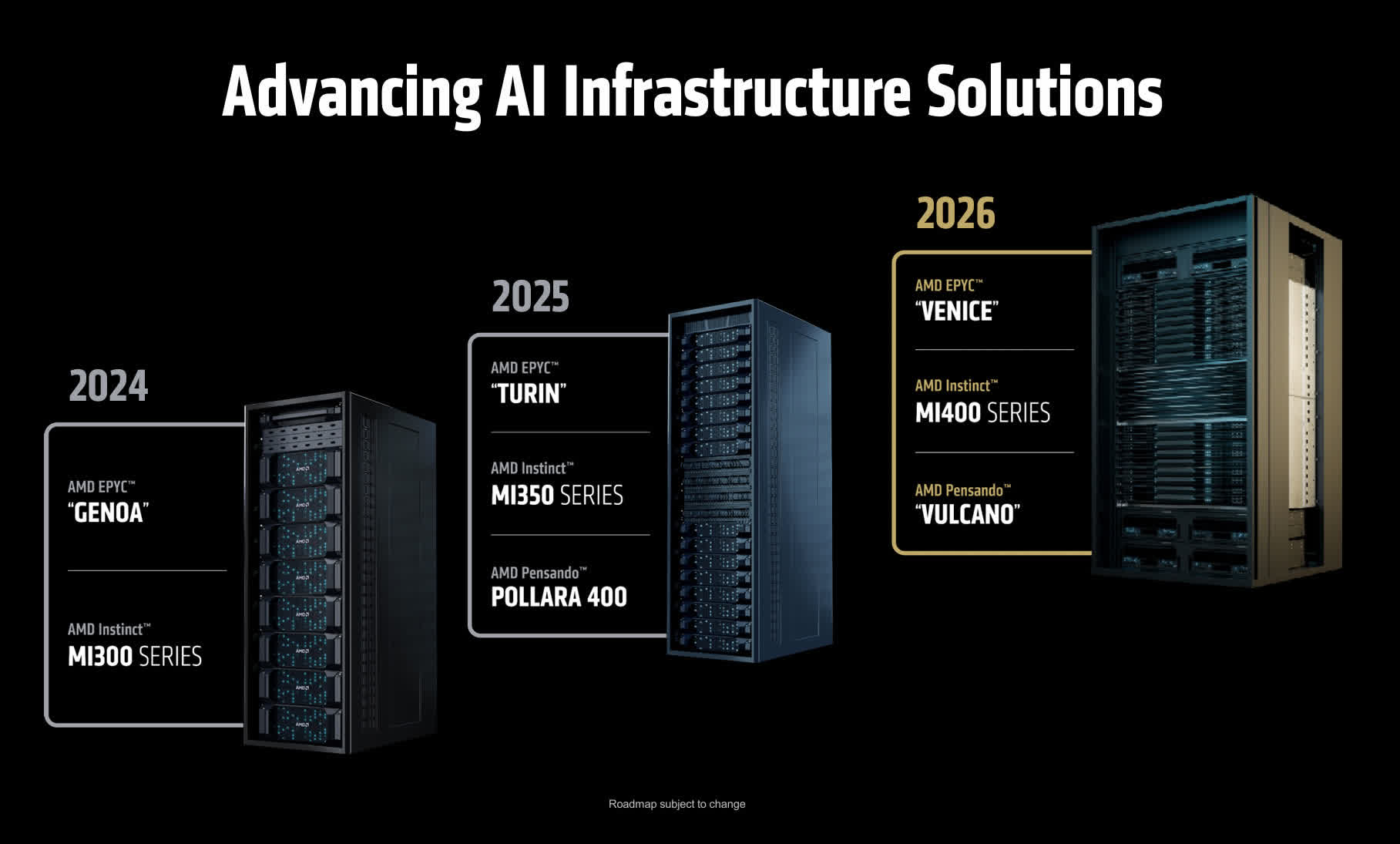

Lors de cet événement, la société a dévoilé des accélérateurs GPU Instinct MI400 et de nouveaux circuits intégrés réseau appelés « Vulcan », ainsi que la version 7 de son logiciel ROCm et l’architecture de rack Helios. Ces annonces montrent clairement l’étendue de l’influence d’AMD sur l’infrastructure de l’IA et les solutions intégrées.

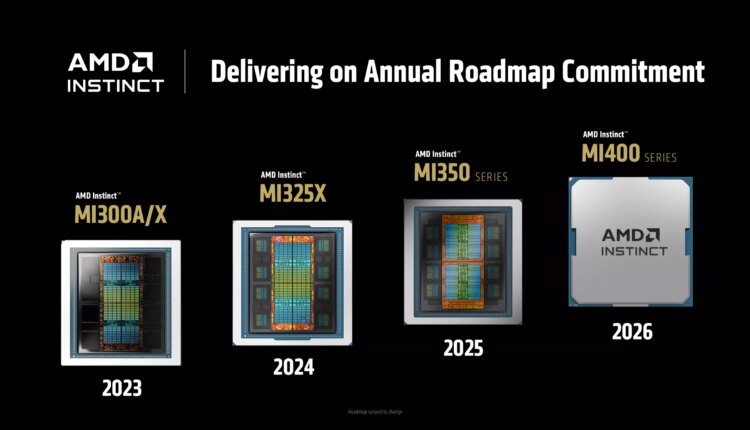

Roadmap des Instinct d’AMD

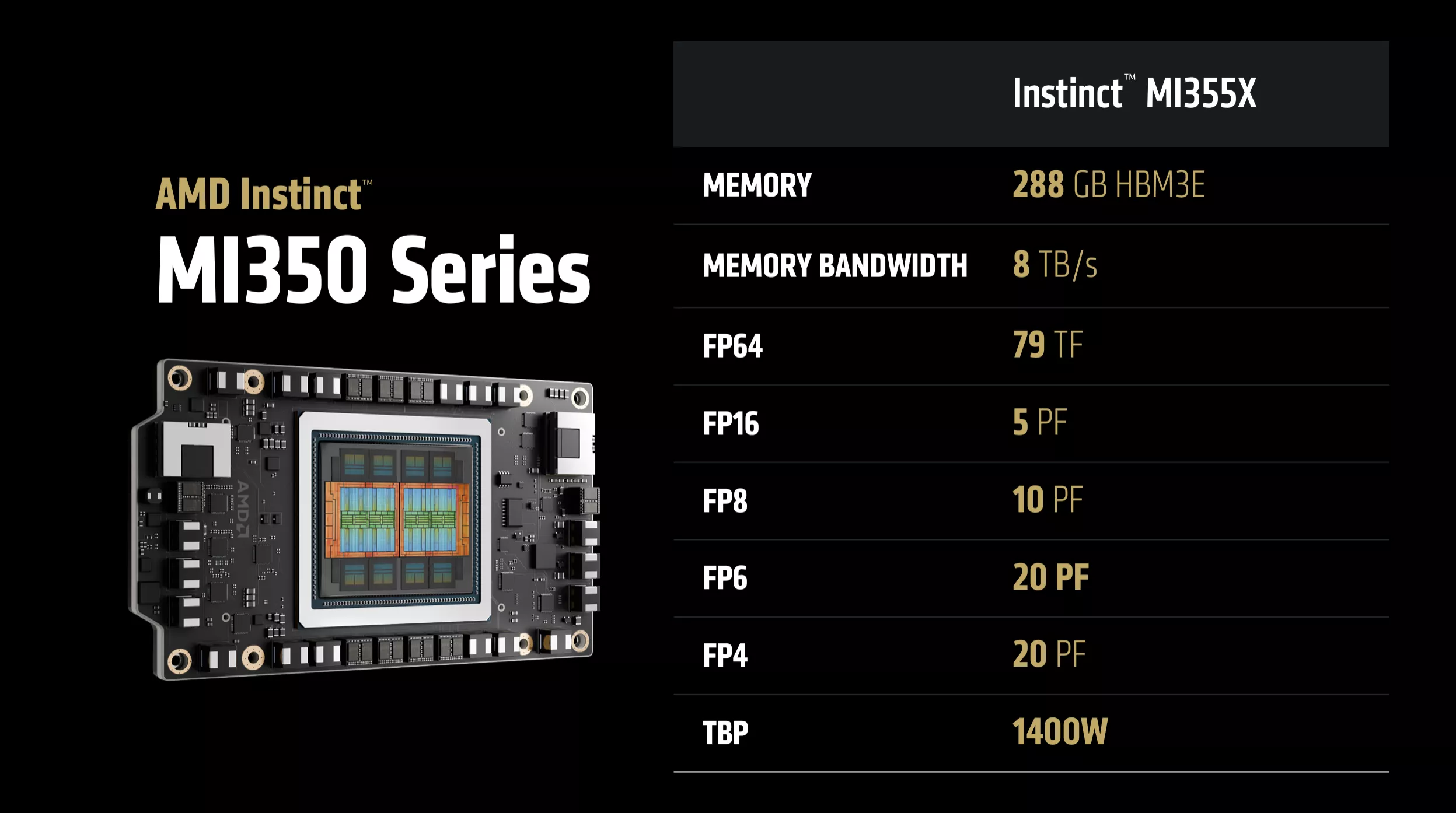

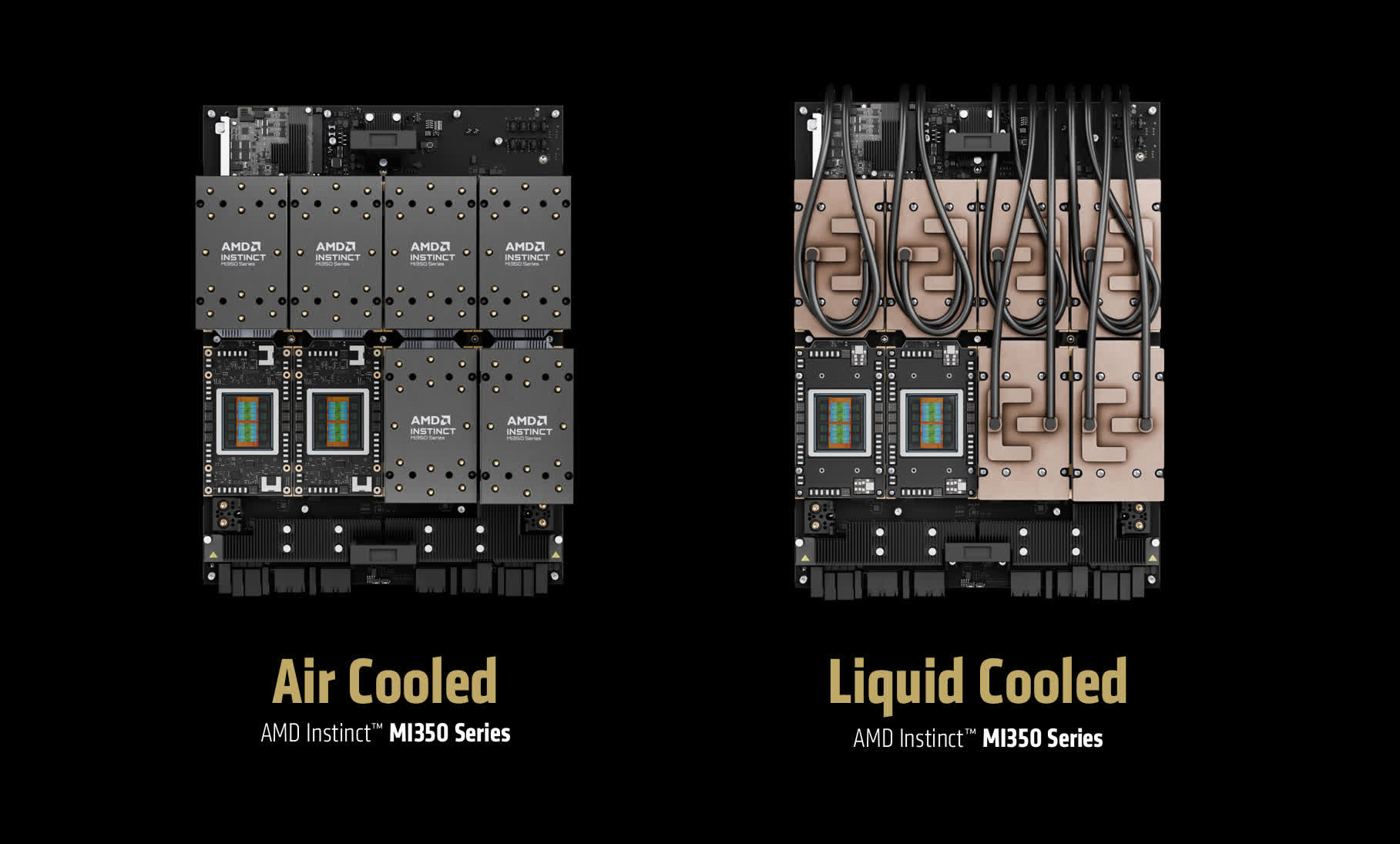

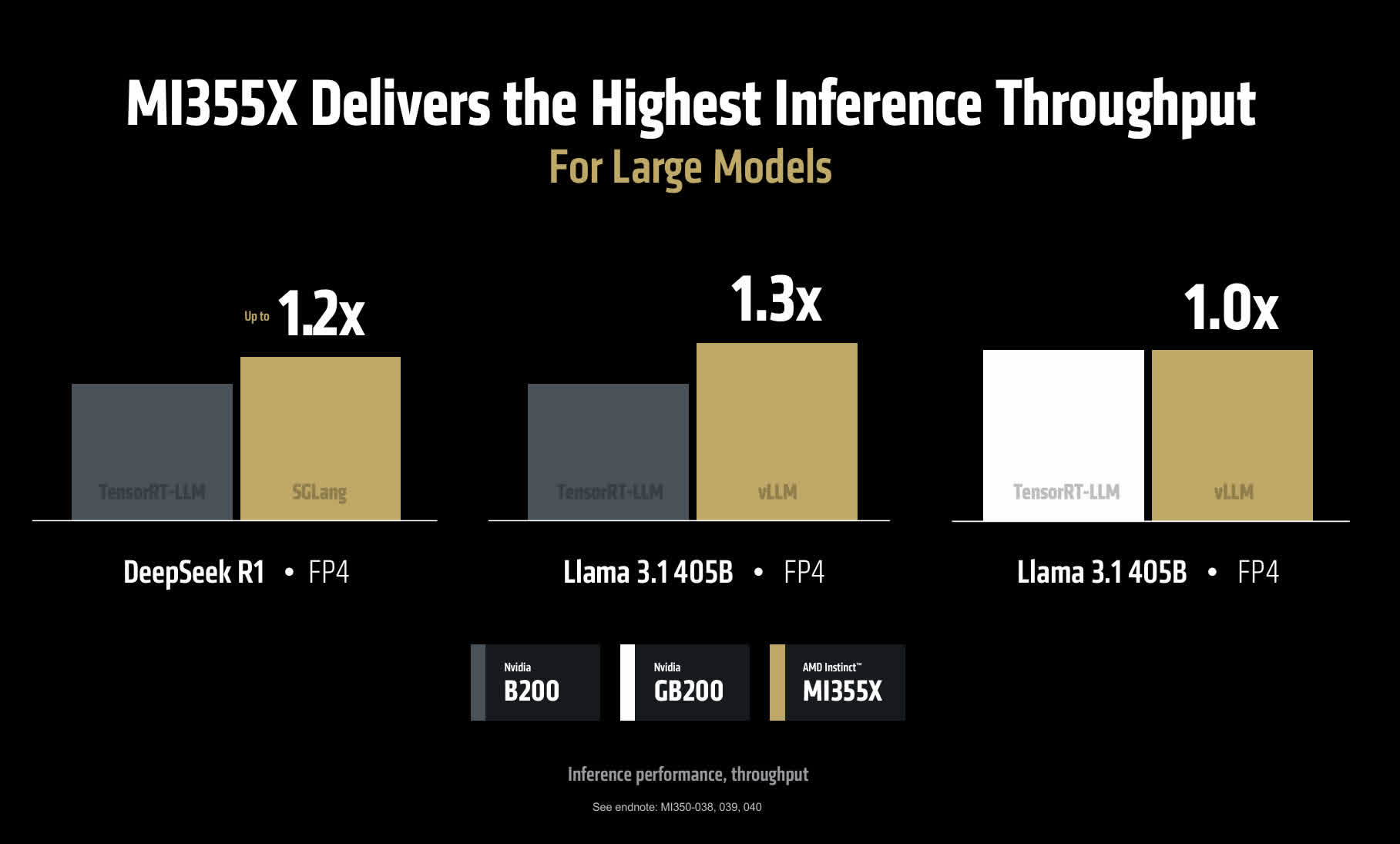

Comme prévu, l’accent a été mis sur le lancement officiel des puces GPU MI350 et MI355X. Ces dernières, optimisées par un processus de 3nm, affichent jusqu’à 288 Mo de mémoire HBM3E et peuvent fonctionner dans des systèmes refroidis par liquide ou par air.

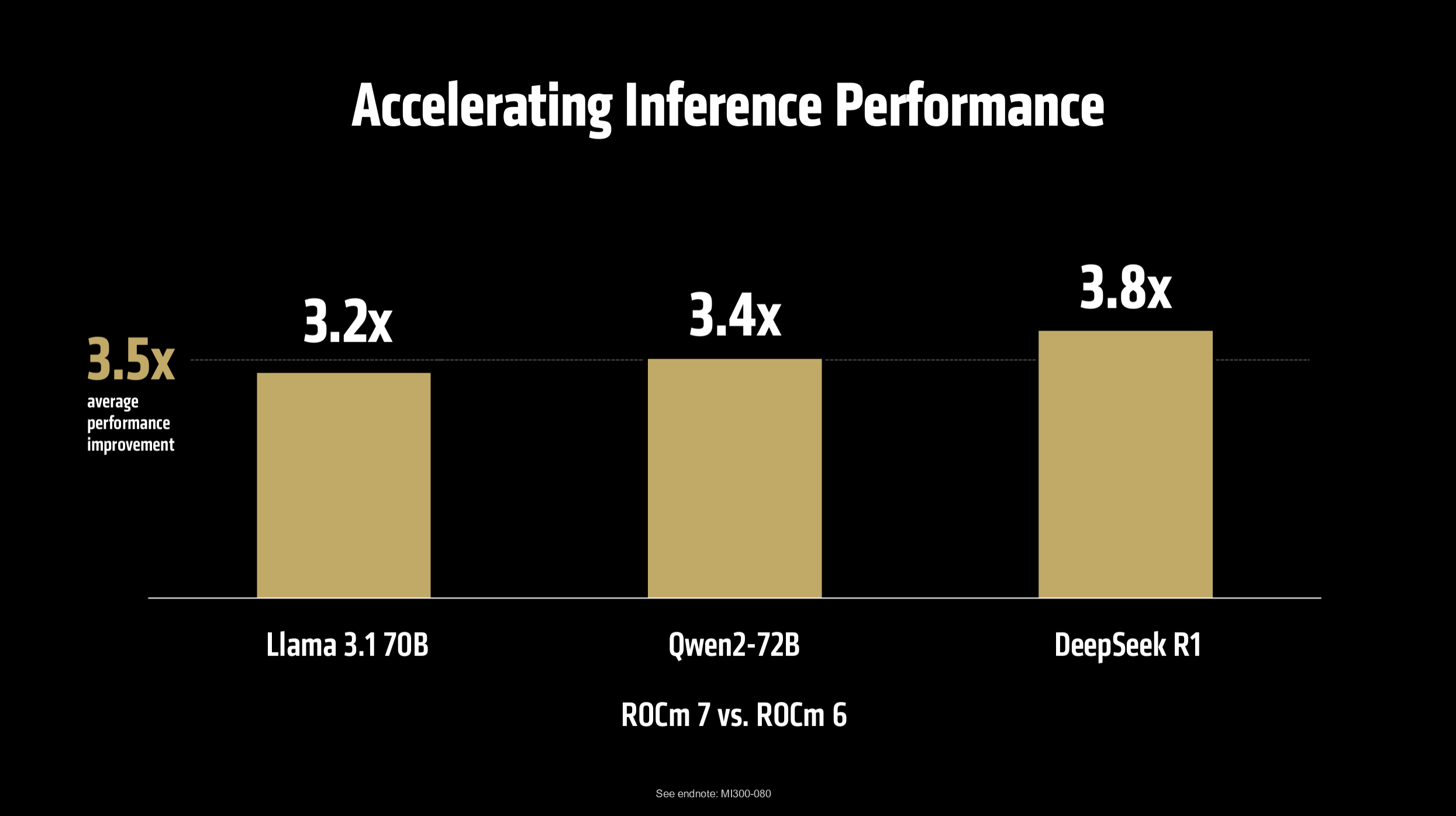

Les tests réalisés par AMD montrent que ces puces égalent, voire surpassent, les performances des modèles concurrents. L’entreprise a notamment insisté sur l’amélioration significative de la vitesse d’inférence, dépassant les performances de la génération précédente par plus de trois fois.

AMD a également dévoilé des détails sur les MI400, prévus pour l’année prochaine, ainsi que les MI500 annoncés pour 2027. Le MI400 offrira jusqu’à 432 Go de mémoire HBM4 et une bande passante mémoire de 19,6 To/sec, nécessaires pour gérer des modèles plus volumineux.

Des annonces surprenantes ont également été faites concernant les solutions de mise en réseau.

La société a présenté son nouveau chip de réseau de prochaine génération, ainsi qu’une carte d’interface réseau appelée AMD Pensando Pollara 400 AI NIC. Cette dernière est présentée comme la première carte réseau alimentée par l’IA sur le marché. La Pollara 400 utilise le standard Ultra Ethernet, offrant des améliorations de vitesse de 20% et jusqu’à 20 fois plus de capacité par rapport aux cartes utilisant la technologie InfiniBand.

AMD a aussi annoncé le développement de son chip réseau « Vulcano », conçu pour les grands clusters d’IA, offrant des vitesses de réseau de 800 Go/sec, avec une performance de scalabilité multipliée par 8 pour des groupes de GPU, prévu pour 2026.

En réunissant tous ces éléments, la nouvelle architecture de rack d’AMD a été l’une des annonces majeures. Avec un mouvement croissant vers des solutions complètes basées sur des racks pour l’infrastructure de l’IA, AMD démontre son expertise acquise, renforcée par l’achat de ZT Systems.

Cette démarche souligne l’offre compétitive d’AMD face à NVIDIA, illustrant comment tous les composants de ses solutions peuvent collaborer parfaitement.

En plus d’exposer des systèmes basés sur leurs puces prévues pour 2025, AMD a également présenté son architecture Helios, prévue pour 2026. Elle s’appuiera sur une gamme complète de puces AMD, incluant les nouveaux CPU Epyc, les GPU Instinct MI400, et le chip de réseau Vulcano. Cette architecture témoigne des ambitions d’AMD de rivaliser avec les systèmes basés sur Vera Rubin que NVIDIA a annoncés pour l’année prochaine.

D’ailleurs, AMD a adopté une stratégie similaire à celle de NVIDIA, en offrant un aperçu pluriannuel de ses plans technologiques pour les futures architectures.

Les attentes concernant les performances de ces nouvelles options pourraient être significatives. Bien que les valeurs finales puissent évoluer, il est indéniable qu’AMD affiche une confiance soutenue dans ses capacités à se mesurer à des concurrents de poids. Cela témoigne d’une dynamique positive pour l’entreprise.

Développements concernant ROCm et logiciels

Un des points clés pour AMD a été la sortie de la version 7 de son logiciel open-source ROCm. L’entreprise a souligné les avancées au niveau des charges de travail d’inférence, menaçant directement la domination du logiciel CUDA de NVIDIA.

Touchant à diverses collaborations et au support d’autres frameworks, AMD met l’accent sur l’utilisation de ROCm pour le développement interne des entreprises. Ces avancées, bien que modestes individuellement, témoignent d’un élan croissant pour le logiciel.

Une annonce notable a été l’intégration de la prise en charge de ROCm dans Windows, rendant cette plateforme plus adaptée pour les développeurs d’IA et ouvrant des possibilités d’accélération des GPU et NPUs d’AMD.

Dans le cadre de l’événement, AMD a également lancé son AMD Developer Cloud, offrant aux créateurs une ressource gratuite pour accéder à des infrastructures basées sur MI300 et concevoir des applications avec les outils ROCm. Bien que cette initiative semble modeste, elle revêt une importance stratégique pour élargir l’influence de l’entreprise.

Les actions collectives d’AMD commencent à porter leurs fruits avec un nombre croissant de clients adoptant ses solutions, incluant OpenAI, Microsoft, Oracle Cloud, et Meta.

Finalement, AMD s’efforce de créer des déploiements d’IA souverains à l’échelle mondiale, œuvrant à établir la confiance avec ses clients et partenaires constructeurs.

Avec ces annonces, AMD positionne ses solutions comme une alternative solide contre NVIDIA, témoignant de ses ambitions de croissance et d’impact sur le marché.