La plateforme CPU Intel Lunar Lake révèle des performances remarquables dans le domaine de l’inférence AI, particulièrement avec les nouveaux modèles Meta LLaMA 3.2. Cette avancée témoigne des efforts continus d’Intel pour optimiser les processus de traitement à l’aide de son hardware spécialement conçu.

Performance impressionnante de l’Intel Core Ultra 9 288V

La dernière génération de modèles développés par Meta, le LLaMA 3.2, vise à répondre à des exigences de plus en plus sophistiquées pour les tâches d’intelligence artificielle. Cette version améliore considérablement les caractéristiques des modèles précédents, en introduisant des paramètres supplémentaires adaptables aux plateformes matérielles d’Intel.

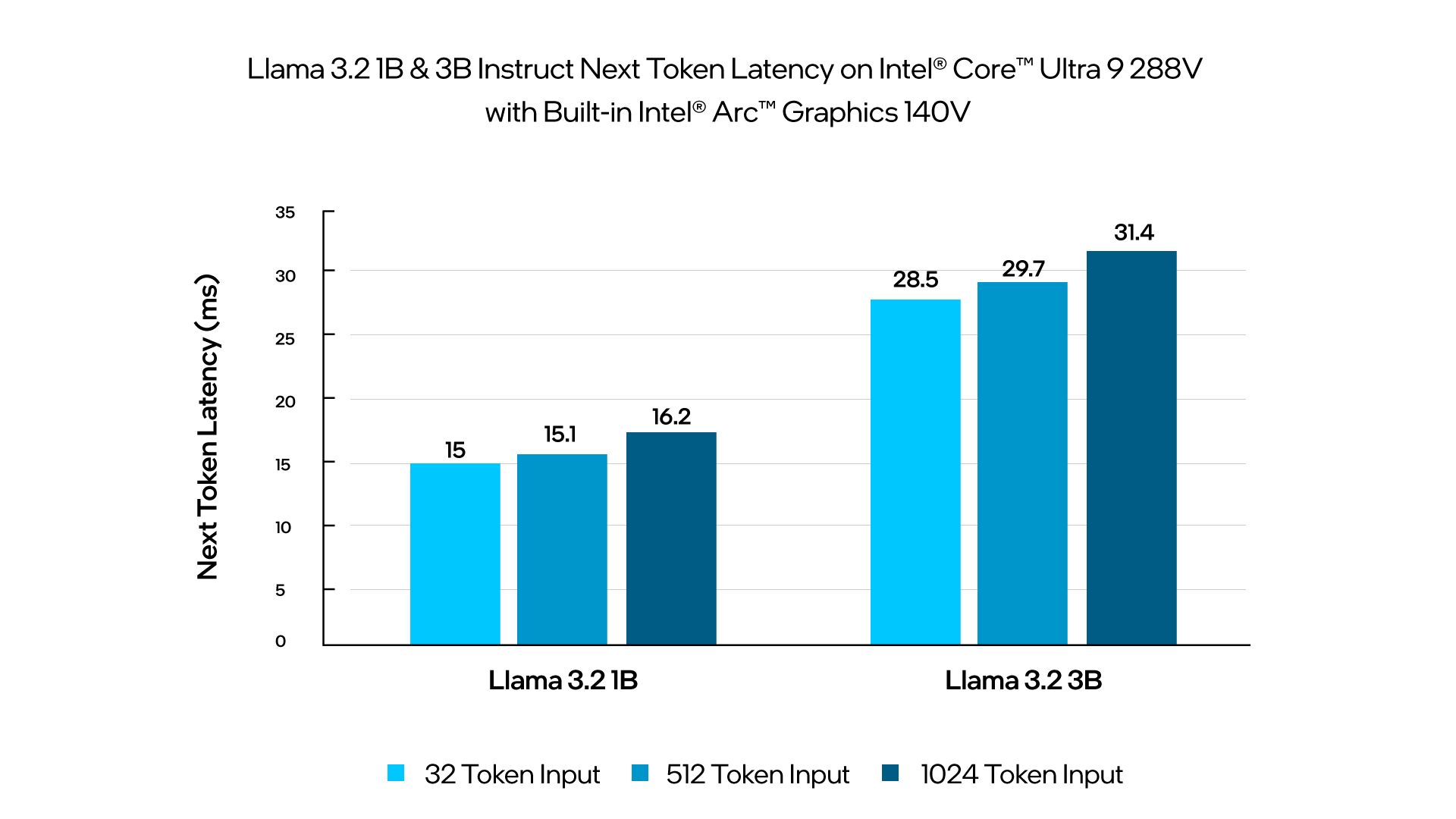

Selon les informations communiquées par Intel, le CPU phare Intel Core Ultra 9 288V « Lunar Lake » affiche une latence particulièrement faible, atteignant seulement 28,5 ms pour 32 tokens d’entrée, et 31,4 ms pour 1024 tokens avec le modèle 3B. Ces performances garantissent une fluidité remarquable pour les applications d’inférence AI.

Le modèle LLaMA 3.2 introduit des déclinaisons textuelles de 1 milliard et 3 milliards de paramètres, spécialement conçues pour traiter des tâches textuelles élémentaires. La nouveauté majeure est l’ajout d’un modèle multi-modal de 11 milliards de paramètres, capable de gérer des opérations plus complexes, y compris l’interprétation d’images et de données visuelles.

Les utilisateurs d’ordinateurs équipés de processeurs Intel peuvent bénéficier de la fonctionnalité d’analyse visuelle pour obtenir des réponses pertinentes à partir de données graphiques. Par exemple, le CPU Intel Core Ultra 9 288V associé au GPU intégré Arc 140V est capable d’interpréter des images, d’analyser leur contenu, et de fournir des réponses textuelles qui expliquent ces éléments.

OpenVINO et l’optimisation des performances AI

En parallèle, Intel a développé un cadre d’inférence AI, nommé OpenVINO, destiné à optimiser les performances sur le hardware Intel. Ce cadre améliore non seulement la vitesse d’exécution, mais également l’efficacité énergétique sur les appareils, tant en environnement PC qu’en périphérie.

Avec l’intégration de l’Unité de Traitement Neural (NPU) dans les plateformes Intel Core et les Extensions Matrici Intel Xe sur les GPU Arc, les ordinateurs de la marque bénéficient de résultats d’inférence optimisés. Cela est particulièrement pertinent pour le modèle LLaMA 3.2 en 11B, qui excelle dans le raisonnement visuel à la périphérie.