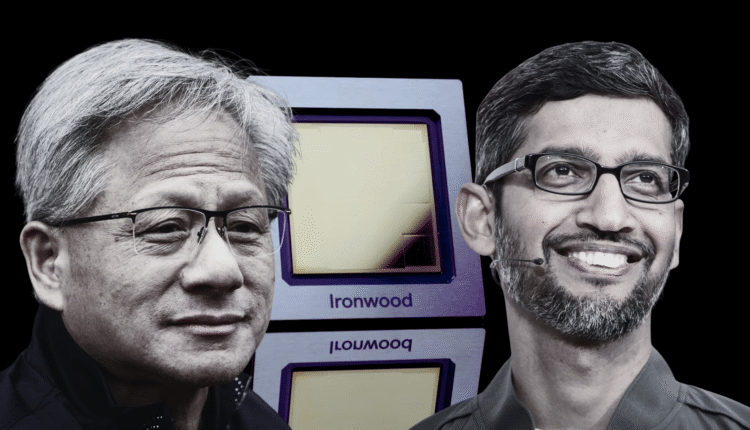

NVIDIA se retrouve face à un grand concurrent dans le secteur de l’IA : Google. Ce dernier, qui a lancé ses premiers processeurs personnalisés en 2016, rattrape rapidement son retard. Son PDG, Jensen Huang, est conscient de cette situation.

Ironwood de Google : 192 Go HBM avec des Avancées Notables

Les Ironwood TPUs de Google, prévus pour une utilisation prochaine, sont conçus pour l’inférence. Le TPU v7 met l’accent sur les performances d’inférence et promet d’améliorer significativement les performances par rapport aux précédentes générations, notamment en offrant jusqu’à 10 fois plus de puissance par rapport au TPU v5p.

- Amélioration des performances de 4x par rapport au TPU v6e.

- 192 Go de mémoire HBM et 4,614 TFLOPs de puissance de calcul par puce.

- Intégration de 9,216 puces par SuperPod, atteignant 42,5 exaFLOPS.

Google met en avant son réseau InterChip Interconnect (ICI) qui permet de connecter efficacement les blocs de puces, surpassant les solutions de NVIDIA en termes de scalabilité. Cette innovation positionne SuperPod comme une véritable avancée dans le domaine.

Les Ambitions de Google : Une Menace pour NVIDIA ?

Avec l’émergence des modèles d’inférence, Google se place en concurrent direct de NVIDIA, qui a longtemps dominé grâce à son offre optimisée pour la formation des modèles. La demande en inférence dépasse désormais largement celle pour l’entraînement.

Les Ironwood TPUs se distinguent grâce à leur mémoire plus importante, réduisant les latences et les coûts par requête. Google promet également une double efficacité énergétique, rendant l’utilisation de ses TPUs plus attractive pour les déploiements à grande échelle.

La dynamique du marché passe d’une mesure de puissance brute à des interrogations sur la capacité à traiter des requêtes avec efficacité. Cette évolution place Google comme un acteur incontournable face à une NVIDIA, qui commence à ressentir la pression.