Lors de son discours à l’ISC 2025, Mark Papermaster, CTO d’AMD, a mis en évidence les exigences croissantes en matière d’efficacité et d’adaptabilité des superordinateurs, en soulignant l’importance de s’adapter face à une demande en forte augmentation.

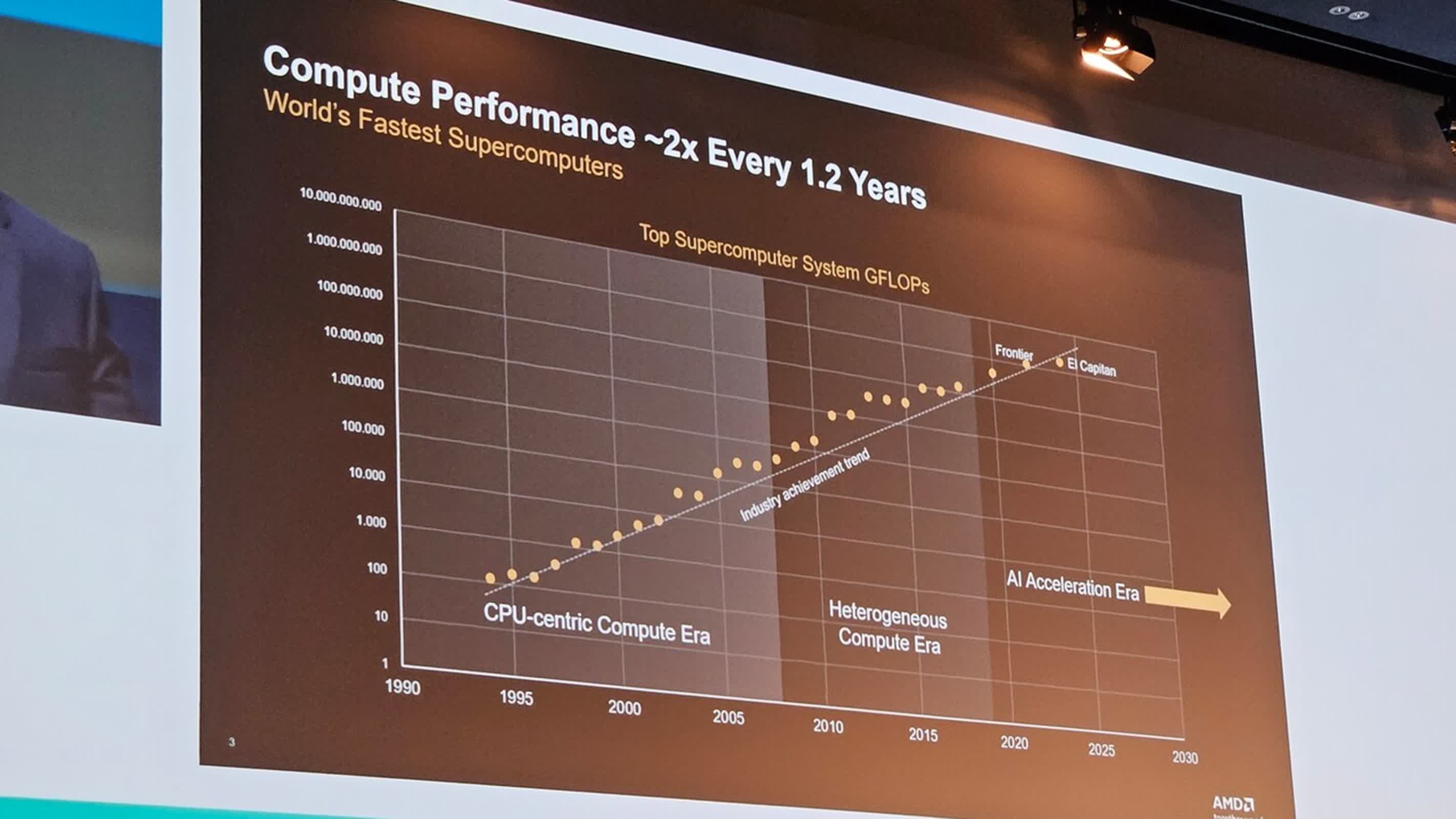

Mark Papermaster, CTO d’AMD, a connu un effritement constant de la demande pour le calcul haute performance, principalement grâce à l’intelligence artificielle. Il a fait référence à l’émergence de nouveaux systèmes en Allemagne, comme Jupiter et Blue Lion, qui illustrent cette expansion rapide. « La performance des superordinateurs continuera d’augmenter rapidement », a-t-il déclaré, en précisant que c’est la demande des utilisateurs qui stimule l’innovation et le progrès.

Bien que l’IA soit omniprésente, Papermaster a souligné que les techniques de calcul traditionnelles sont toujours essentielles, en particulier dans les applications scientifiques où la précision est fondamentale. Il a expliqué que les calculs en double précision (FP64) restent cruciaux. Bien que des formats de précision inférieure tels que FP16 et FP8 gagnent en popularité pour certaines charges de travail, une approche hybride est nécessaire. « Ce n’est pas seulement une question de FLOPS ! » a-t-il ajouté, insistant sur le fait que la puissance brute de calcul ne représente qu’une partie de l’équation.

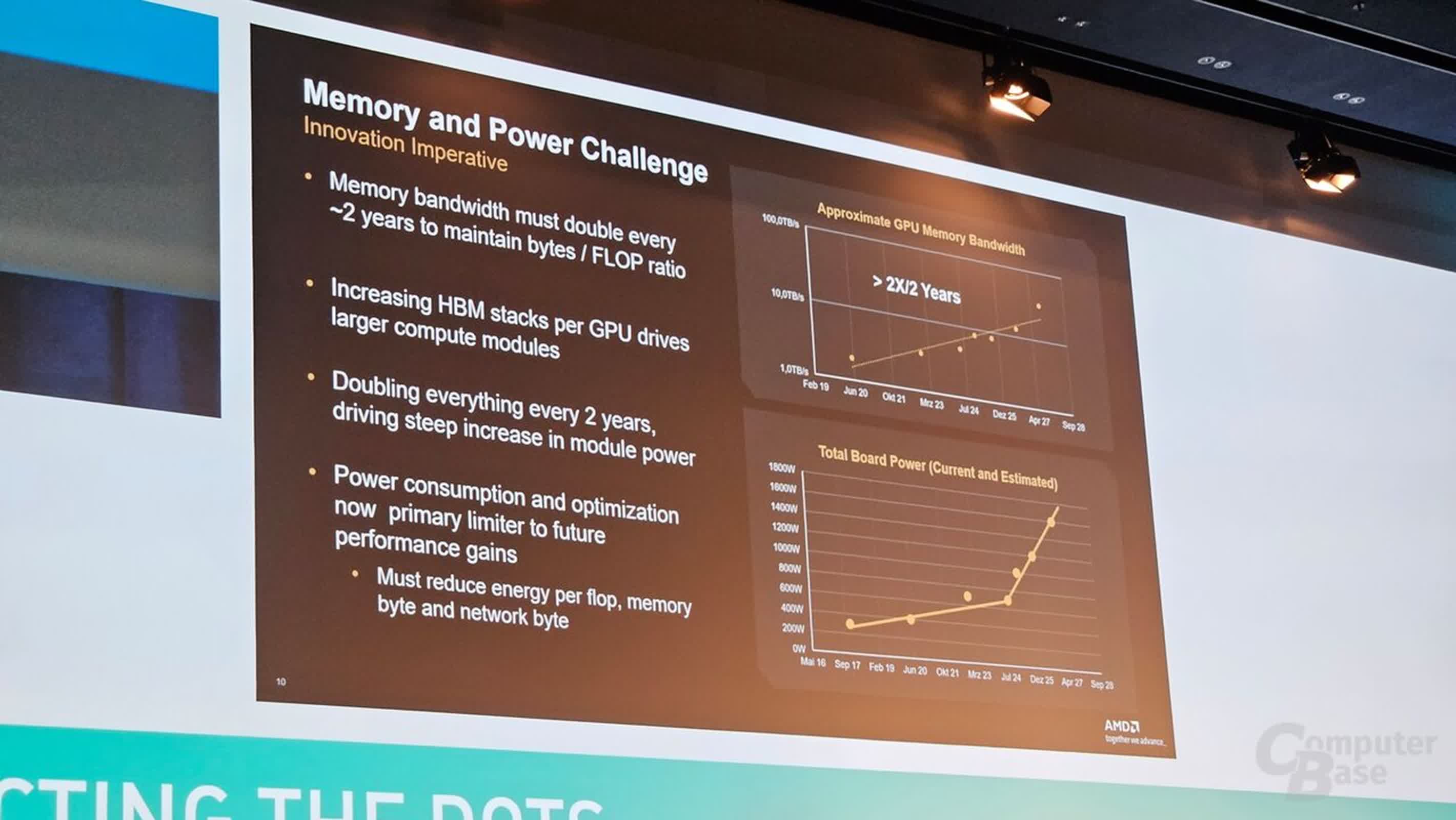

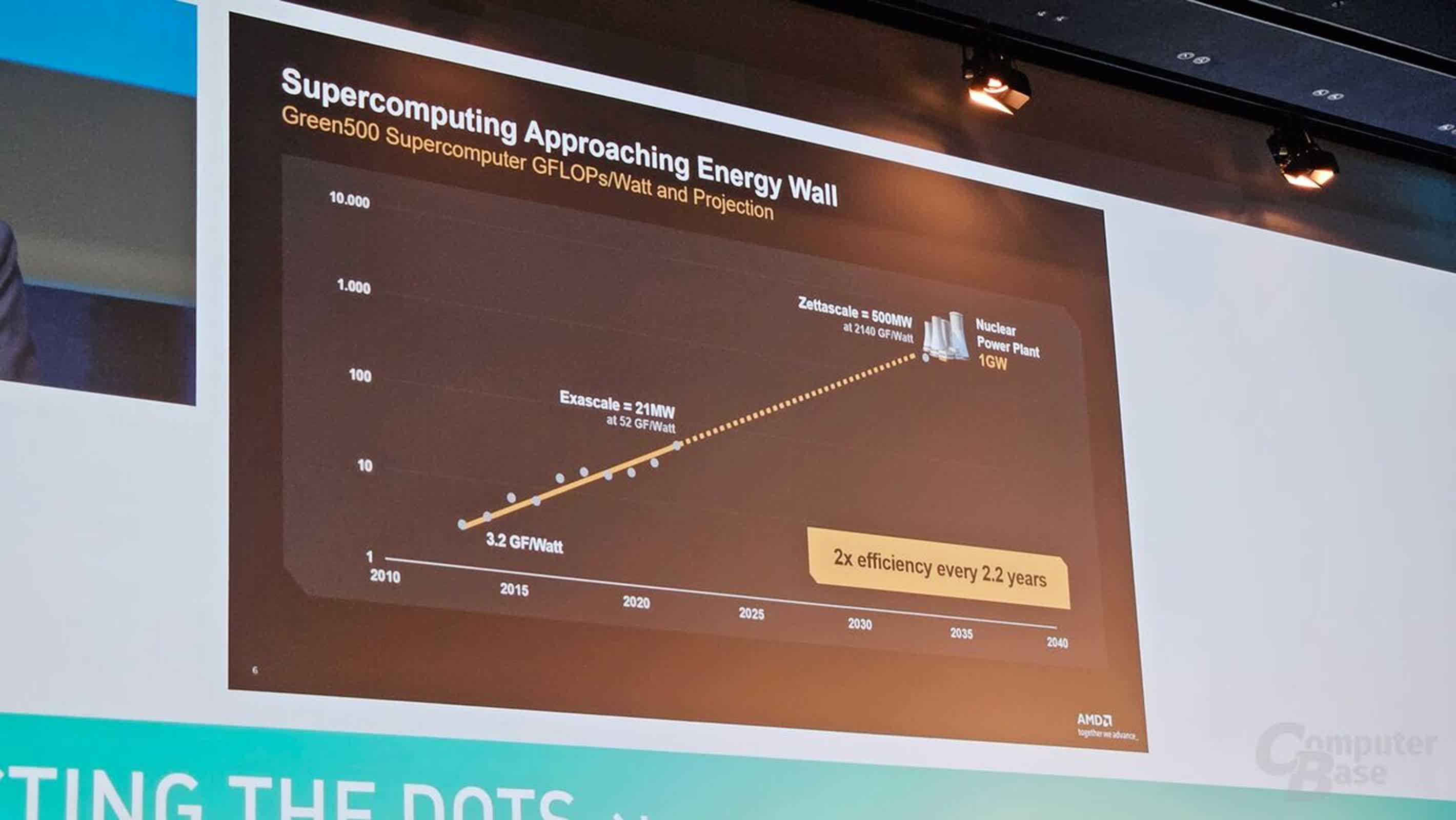

La discussion a rapidement porté sur les défis pratiques auxquels l’industrie est confrontée. Papermaster a noté que bien que la performance de calcul puisse théoriquement évoluer rapidement, des contraintes réelles telles que la bande passante et la consommation d’énergie deviennent de plus en plus tests.

Il a averti que la puissance totale des accélérateurs devrait atteindre 1 600 watts ou plus d’ici 2026 ou 2027, avec la possibilité d’atteindre 2 000 watts. « La puissance et le refroidissement seront, et sont déjà dans certains cas, les plus grandes limites », a-t-il précisé, ajoutant que la bande passante mémoire doit doubler tous les deux ans pour suivre, ce qui augmente encore la demande en énergie.

Papermaster a noté que les futurs centres de données AI pourraient consommer de l’énergie à l’échelle de centaines de mégawatts. Il a même plaisanté sur la possibilité d’avoir « 15 constructeurs de petits réacteurs nucléaires », une allusion humoristique aux demandes énergétiques croissantes de l’industrie.

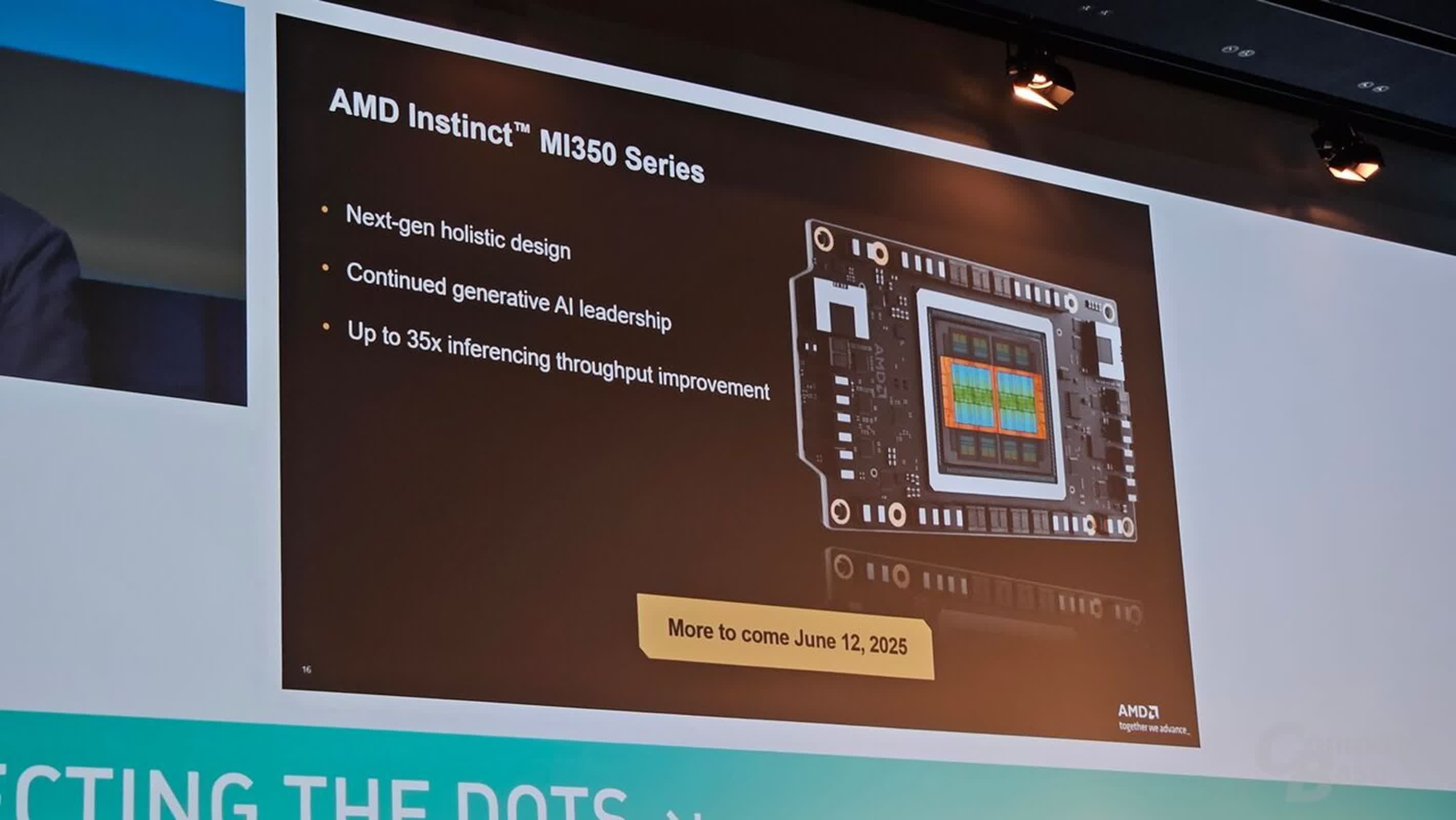

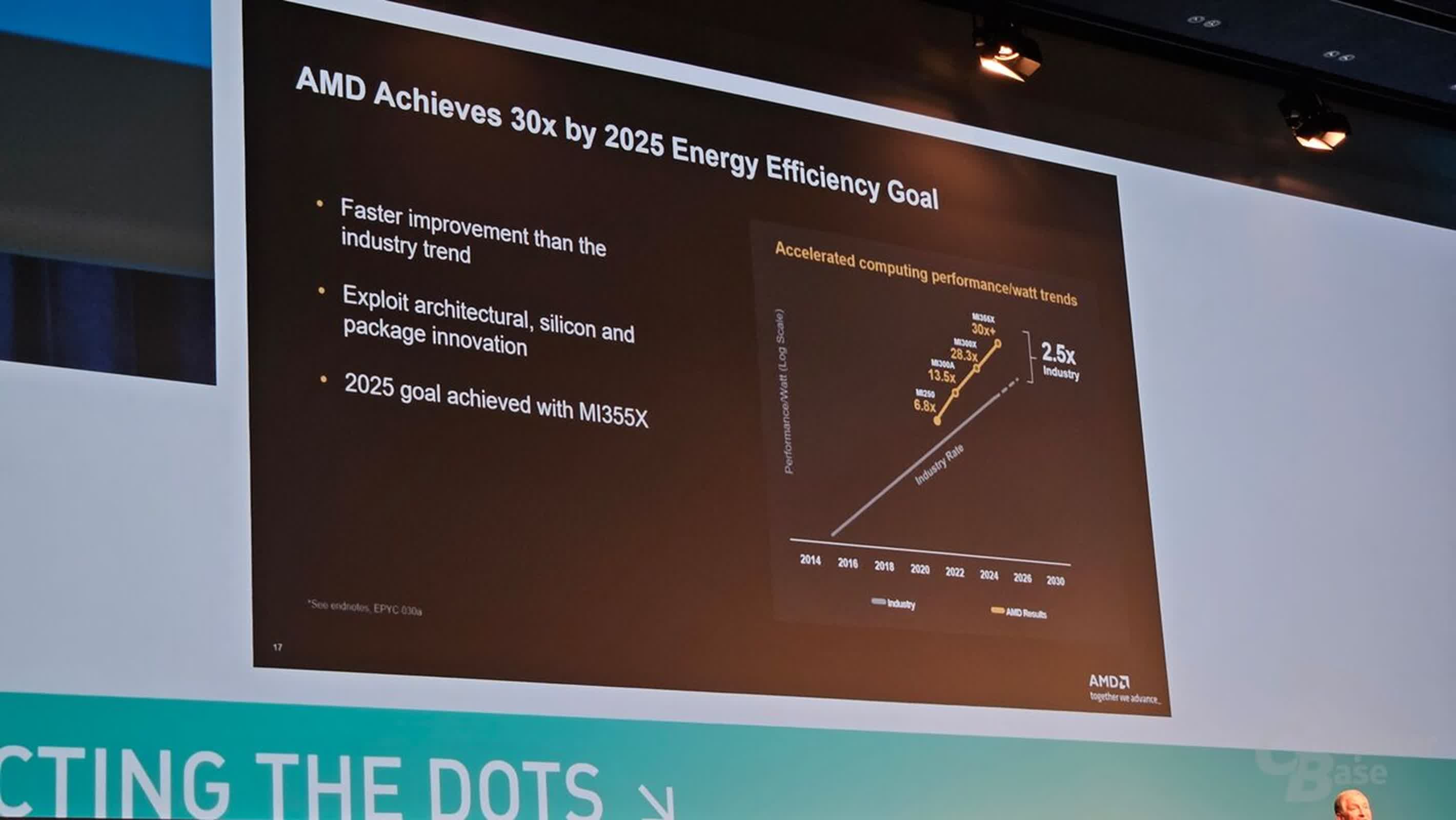

Sur le plan des produits, Papermaster a mis en avant l’élan croissant d’AMD avec ses accélerateurs Instinct. Le MI300X et le MI300A ont déjà réalisé 5 milliards € de bénéfices au cours de leur première année, capturant ainsi 5 % du marché.

En regardant vers l’avenir, il a confirmé le lancement prochain du MI355X, qui offrira jusqu’à 35 fois la performance d’inférence de son prédécesseur dans certaines charges de travail. Le nouvel accélerateur sera disponible en versions refroidies à air et à eau, soulignant l’accent continu d’AMD sur la performance et l’efficacité. Papermaster a également évoqué le potentiel de l’informatique en mémoire comme un futur bond en avant en matière d’efficacité énergétique, confirmant qu’AMD explore activement cette technologie.

Le coût reste une préoccupation majeure pour les utilisateurs professionnels, a reconnu Papermaster, alors que les organisations doivent évaluer le compromis entre un investissement initial considérable et les dépenses récurrentes liées aux temps de fonctionnement prolongés. Bien qu’AMD continue de soutenir des outils open source et disponibles gratuitement, il a admis que le développement de leur nouvelle puce 2 nm était « non ouvert – et extrêmement cher », nécessitant beaucoup plus de temps et de ressources que les conceptions précédentes. Beaucoup des outils nécessaires pour de telles puces avancées sont propriétaires et devraient le rester pour un certain temps.

Concernant la connectivité, Papermaster a mentionné que le « Ultra Ethernet » pourrait aider à réduire les coûts d’infrastructure. Il a noté qu’ NVIDIA, sous pression compétitive, a commencé à ouvrir son interconnexion NVLink à d’autres fournisseurs en réponse, une tentative de contrer le potentiel disruptif du Ultra Ethernet. Une plus grande variété d’options dans ce domaine pourrait, selon lui, aider à faire baisser les coûts et encourager un écosystème plus compétitif.

Interrogé sur le rôle du RISC-V, Papermaster a clarifié qu’AMD utilise déjà le RISC-V dans certaines applications, mais qu’il est « actuellement irréaliste de classifier ces puces comme des superordinateurs. » Il a souligné que le RISC-V est encore à ses débuts en matière de maturité et nécessitera un développement substantiel avant de pouvoir rivaliser dans les plus hautes catégories de performance.

En regardant vers l’avenir, Papermaster imagine le superordinateur idéal comme un système très polyvalent capable de gérer un large éventail de charges de travail. Il a reconnu que cet objectif reste une ambition à long terme, et que des architectures spécialisées continueront à dominer dans un avenir prévisible. Cependant, la construction modulaire – illustrée par des projets comme Jupiter – offre une voie prometteuse pour l’avenir.

Les futurs superordinateurs devraient être assemblés à partir de nombreux composants interconnectés, chacun optimisé pour des tâches spécifiques. Atteindre une performance élevée à travers une telle diversité de charges de travail nécessitera, selon lui, un mélange de technologies émergentes, y compris des interconnexions optiques et un éventuel support à l’informatique quantique.