NVIDIA et AMD ont récemment publié les derniers benchmarks de performance MLPerf Inference de leurs nouvelles GPU, dont le modèle Blackwell B200 et l’Instinct MI325X.

NVIDIA Blackwell B200, AMD Instinct MI325X et leurs Performances Sur Les Benchmarks MLPerf

Les benchmarks MLPerf Inference v5.0 sont désormais disponibles et montrent les résultats des géants des GPU, qui ont mis en avant leurs dernières réalisations. Comme observé précédemment, l’optimisation logicielle et le support des nouvelles écosystèmes et charges de travail d’IA sont tout aussi cruciaux que la puissance brute des GPU.

NVIDIA Blackwell Établit De Nouveaux Records

Le système GB200 NVL72, intégrant 72 GPU Blackwell, a réalisé un débit de 30 fois supérieur sur le benchmark Llama 3.1 405B par rapport à l’H200 NVL8 de NVIDIA. Cette performance impressionnante est le résultat d’une hausse de plus de trois fois la puissance par GPU et d’un domaine d’interconnexion NVIDIA NVLink neuf fois plus large.

Bien que plusieurs entreprises utilisent des benchmarks MLPerf pour évaluer leurs matériels, seulement NVIDIA et ses partenaires ont soumis des résultats sur le benchmark Llama 3.1 405B.

Les déploiements de production doivent souvent tenir compte des contraintes de latence sur deux indicateurs clés. Le premier est le temps pour le premier token (TTFT), indiquant combien de temps un utilisateur doit attendre avant de recevoir une réponse d’un modèle de langage. Le second est le temps par token de sortie (TPOT), se rapportant à la rapidité de la délivrance des tokens.

Le nouveau benchmark Llama 2 70B présente un TPOT 5 fois plus court et un TTFT 4.4 fois plus bas, ce qui améliore l’expérience utilisateur. Lors de ce test, la soumission de NVIDIA avec un système NVIDIA DGX B200 équipé de huit GPU Blackwell a triplé la performance par rapport à un système utilisant huit GPU H200, établissant un standard élevé pour cette version plus exigeante.

La combinaison de l’architecture Blackwell et de sa pile logicielle optimisée ouvre la voie à des performances d’inférence de nouvelle génération, permettant à des usines d’IA de fournir une intelligence élevée, un débit accru et des vitesses de token plus rapides.

via NVIDIA

Nous abordons maintenant la situation de NVIDIA, qui a une fois de plus pris les devants en battant des records avec ses dernières GPU Blackwell B200. Le rack GB200 NVL72, avec 72 puces B200, a atteint un débit 30 fois supérieur au benchmark Llama 3.1 405B de la génération précédente, l’H200. Ce modèle a également vu une performance triplée sur le benchmark Llama 70B, en comparant un système B200 à huit GPU contre un système H200 de même configuration.

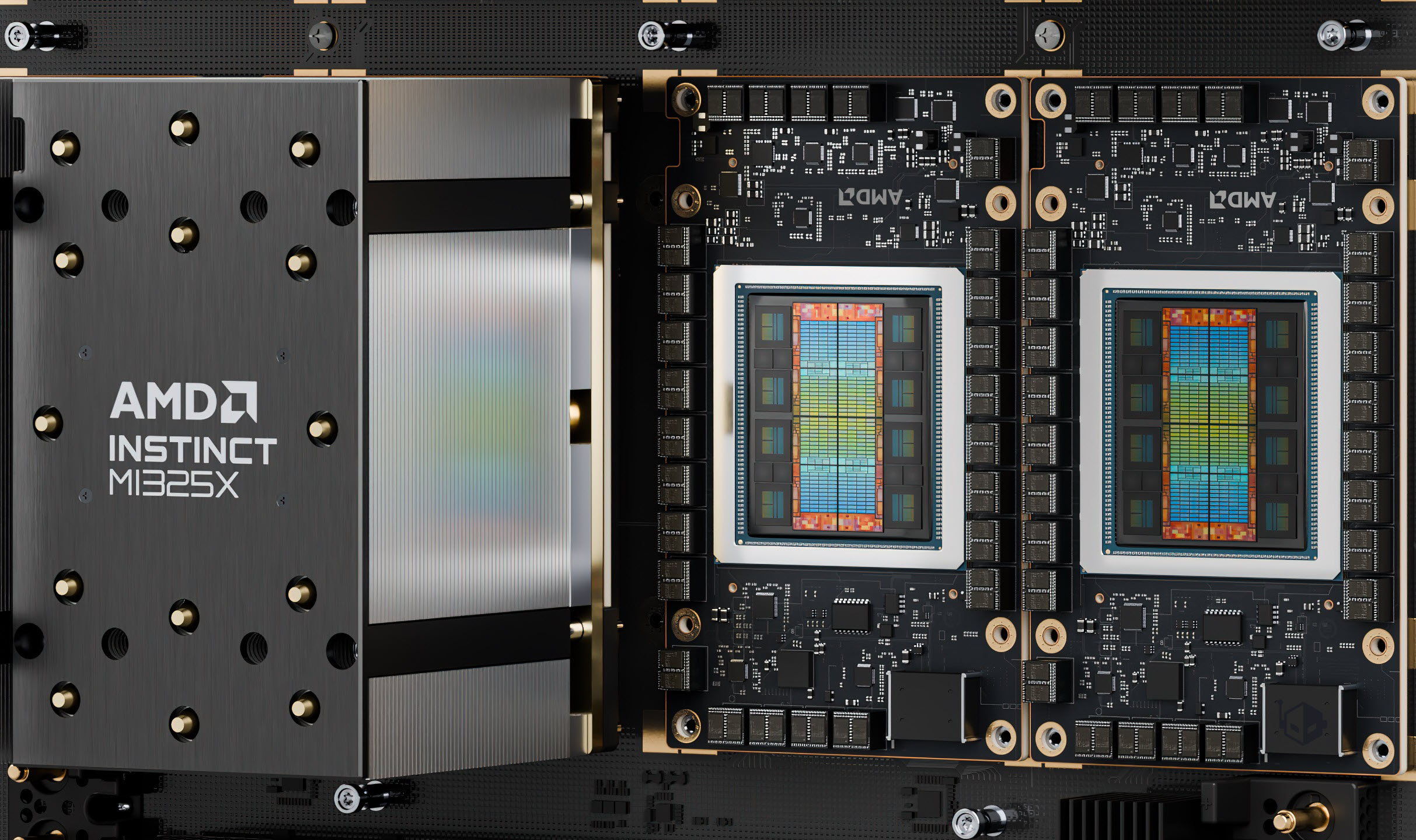

AMD a également présenté son nouveau modèle Instinct MI325X avec 256 Go de mémoire, en configuration x8. Les résultats montrent qu’il se situe au niveau du système H200, bien que sa plus grande capacité mémoire soit un atout pour gérer les très grands modèles de langage, même s’il reste derrière le B200 de NVIDIA. L’Ultra platform avec le B300 devrait arriver prochainement, et AMD devra maintenir son rythme sur les segments hardware et logiciel, notamment avec la série Instinct MI350.

Des benchmarks pour la série Hopper H200 montrent également une optimisation continue. Comparé à l’année dernière, les performances d’inférence ont été augmentées de 50 %, ce qui est significatif pour les entreprises dépendant de ces plateformes.