AMD et Qualcomm se penchent actuellement sur l’intégration de SOCAMM dans leurs produits d’intelligence artificielle, car les applications d’IA nécessitent désormais des systèmes de mémoire plus performants.

Le SOCAMM, Initialement Exclusif à NVIDIA, Attire l’Attention des Concurrents

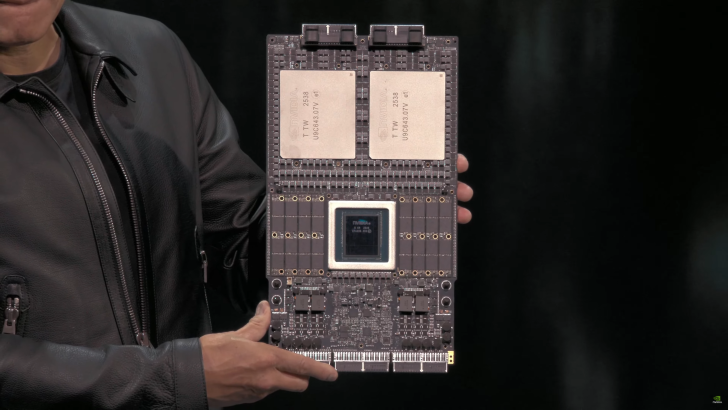

SOCAMM est une norme de mémoire conçue au départ pour NVIDIA, qui a été l’un des premiers à l’adopter. Il repose sur la technologie LPDDR DRAM, typiquement utilisée dans les appareils mobiles et à faible consommation. Contrairement à des solutions comme HBM et LPDDR5X, le SOCAMM peut être mis à jour. Il n’est pas soudé à la carte mère, ce qui permet de l’utiliser avec HBM pour des tâches gourmandes en mémoire. Selon un communiqué de Hankyung, NVIDIA, Qualcomm et AMD envisagent d’intégrer les modules SOCAMM dans leurs prochaines racks AI.

AMD et Qualcomm examinent une approche différente de celle de NVIDIA, en formant un module « carré » avec deux DRAM disposées en deux rangées. Cela devrait permettre un contrôle de l’alimentation (via le PMIC) directement sur le module, facilitant une régulation efficace et garantissant que le SOCAMM fonctionne à des vitesses élevées. En déplaçant le PMIC sur le module, AMD et Qualcomm souhaitent également simplifier la fabrication de la carte mère en éliminant les circuits de puissance.

Au fur et à mesure que l’adoption du SOCAMM s’étend, les chiffres d’utilisation de cette mémoire devraient augmenter. Avec l’IA agentique, disposer d’un stockage temporaire à côté de HBM devient indispensable. Le SOCAMM permet d’atteindre des To de mémoire par CPU, offrant ainsi aux agents la capacité d’activer des millions de tokens en mémoire. Bien que son débit soit plus lent par rapport à HBM, le SOCAMM demeure une option viable et respectueuse de l’énergie.

NVIDIA prévoit de proposer le SOCAMM 2 avec les clusters AI Vera Rubin, et puisque AMD et Qualcomm explorent cette solution, il est probable que cette mémoire soit présente dans leurs prochains clusters AI de nouvelle génération.